Services on Demand

Journal

Article

Indicators

-

Cited by SciELO

Cited by SciELO -

Access statistics

Access statistics

Related links

-

Cited by Google

Cited by Google -

Similars in

SciELO

Similars in

SciELO -

Similars in Google

Similars in Google

Share

TecnoLógicas

Print version ISSN 0123-7799On-line version ISSN 2256-5337

TecnoL. no.27 Medellín July/Dec. 2011

Artículo de Investigación/Research Article

Incidencia de la Segmentación en la Obtención de Región de Interés en Imágenes de Palma de la Mano

Maribel Arroyave-Giraldo1, Alejandro Restrepo-Martínez2, Francisco Vargas-Bonilla3

1Grupo de Investigación en Sistemas Inteligentes, Institución Universitaria de Envigado, Envigado-Colombia, maribel.arrgi@gmail.com

2Grupo de Investigación en Automática y Electrónica, Instituto Tecnológico Metropolitano, Medellín-Colombia, alejandrorestrepo@itm.edu.co

3Grupo de Electrónica de Potencia Automática y Robótica, Universidad de Antioquia, Medellín-Colombia, jfvargas@udea.edu.co

Fecha de recepción: 05 de mayo de 2011 / Fecha de aceptación: 29 de septiembre de 2011

Resumen

Una de las mayores dificultades en el reconocimiento de patrones y en particular en sistemas biométricos basados en la palma de la mano, es obtener en el preprocesamiento un adecuado cálculo de la región de interés (Region Of Interest, ROI), debido a que ésta influye directamente en los resultados finales del sistema de identificación. Este artículo presenta una comparación entre imágenes que contienen la región de interés de la palma de la mano, obtenidas mediante el uso de técnicas de umbralización, Otsu y Huang para la base de datos PolyU y Otsu e Isodata para la base de datos CASIA. También se realizaron pruebas con dos métodos para la ubicación del cuadrado correspondiente a la ROI, utilizando como medidas de similitud: la correlación, la información mutua, el error cuadrático medio, la relación de uniformidad de la imagen y el área común entre las imágenes, Todo esto, para determinar qué tan similares o diferentes son las imágenes generadas por diferentes métodos de ubicación de ROI y por distintos métodos de umbralización. Esta investigación demostró que efectivamente el cambio de los métodos de umbralización generan cambios en la ROI de la palma de la mano ya que la localización de los puntos valle cambia según el método utilizado. Se concluye finalmente que al variar el método de umbralización, las imágenes generadas por cada método son diferentes y al variar el método de obtención de la ROI la variación es mayor.

Palabras clave: Región de interés, biometría, palma de la mano, tratamiento de imágenes, medidas de similitud.

Abstract

One of the greatest difficulties in pattern recognition and in particular biometric systems based on palmprint, is to obtain at preprocessing stage the adequate calculation of the target region (Region Of Interest, ROI), due to it directly influences the final results of the identification system. This paper presents a comparison among images that contain the region of interest of palmprints. ROIs are extracted using two different segmentation techniques for each database. Otsu and Hang methods are used for the PolyU database, while Otsu and ISODATA methods are used for the CASIA database. To determine the similarity between the ROI extracted from each segmentation method, a comparison test is conducted using the following similarity measures: correlation, mutual information, mean square error, ratio image uniformity and common area between images. This research showed that indeed the change of the segmentation methods generate changes in the ROI of the palmprint, as the location of the valley points change depending on the method. Finally, it concludes that when vary the threshold method, the images generated by each method are different and vary the method of obtaining of the ROI variation is greater.

Keywords: Region of interest, biometrics, palmprint, image processing, similarity measures.

1. Introducción

En los sistemas biométricos basados en el tratamiento de imágenes se pueden presentar diversos problemas y/o variaciones en los resultados finales, debido a los procesamientos sucesivos y las técnicas utilizadas para modificar la imagen. Una de las mayores dificultades en los sistemas de reconocimiento de patrones y en particular en sistemas biométricos basados en la palma de la mano, es la alta confiabilidad requerida y la variabilidad encontrada en la literatura a la hora de calcular la Región de Interés (Yuea et al., 2009; Chen et al., 2010).

En los sistemas de seguridad, el reconocimiento automático de personas puede generar consecuencias delicadas y de alto riesgo si no se cuenta con un sistema biométrico adecuado, comenzando por un buen preprocesamiento debido a que es en éste, donde se pierde información relevante que afecta la caracterización. Así se cuente con una buena técnica de caracterización y un adecuado clasificador, si desde el comienzo hay problemas en el tratamiento inicial de las imágenes, los resultados se evidencian en la salida final del sistema. La mayoría de los estudios (Han et al., 2002; 2003; Zhang et al., 2003; Lin et al., 2005; Toro & Correa, 2009; Chen et al., 2010) se han enfocado en encontrar una técnica de caracterización, pretendiendo la eliminación del error en la clasificación de patrones para identificación o autenticación, sin comparar técnicas de segmentación o variar la ubicación de la ROI.

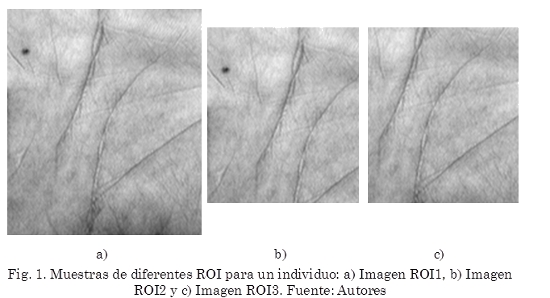

Como ilustración del problema de la incidencia de la región de interés en un sistema biométrico y para visualizar la diferencia existente al utilizar diferentes ROI’s con ubicación de centro aleatorio. En la Fig. 1 se muestran tres ROI’s diferentes, que representan imágenes pertenecientes a un individuo. La Fig. 1a, es un cuadrado de 180x180 pixeles, la Fig. 1b es un cuadrado de 140x140 pixeles, y la Fig. 1c se tomó de un cuadrado 140x140 pixeles, pero en ésta última el centro de la ROI es diferente al del cuadrado anterior. En las figuras se aprecia claramente los cambios en las imágenes obtenidas al variar la ubicación de la ROI.

Si al variar la ROI se obtienen imágenes diferentes, ¿Qué sucede si al binarizar la imagen, se varía el método de selección de umbral? ¿Se afectará la ROI obtenida? En este artículo se realiza un análisis previo de la incidencia en la imagen final, al cambiar de método de selección de umbral, centrándose en la binarización de la palma de la mano, debido que este es un paso decisivo para posteriormente ubicar los puntos a partir de los cuales se extrae la región de interés. Además se analizan dos métodos planteados en la literatura para ubicar los puntos del cuadrado que define la ROI.

2. Metodología

2.1 Bases de datos

Se utilizaron dos bases de datos públicas. La primer base de datos PolyU Palmprint Database, es la segunda versión de la Universidad Politécnica de Hong Kong generada en el Centro de Investigación biométrica (UGC / CRC) y contiene 7752 de imágenes en escala de grises correspondiente a 386 diferentes palmas en formato BMP (384x284 pixeles, 96 dpi). La segunda base de datos CASIA Palmprint Database, contiene 5239 imágenes de palma de la mano en escala de grises (640x480 pixeles, 72 dpi) recogidos de 301 individuos en formato JPG. La diferencia entre estas dos bases de datos, es que las imágenes de CASIA contienen mayores distorsiones, desenfoques y cambios de posición ya que estas fueron tomadas con menores límites físicos, en cambio en PolyU las imágenes son tomadas con plantillas y sólo contienen el inicio de los dedos, además esta plantilla no deja visualizar el punto valle formado por el dedo medio y el dedo anular, mientras en las imágenes de CASIA, si contienen los dedos y no son tomadas con ningún tipo de plantilla.

Las anteriores bases de datos son utilizadas en artículos donde Shang & Li (2009); Yuea et al. (2009) y Zhang et al. (2003) trabajan con la base de datos de PolyU palmprint y Chen et al. (2010) utilizan PolyU palmprint y CASIA.

Para evitar problemas en el procesamiento de los datos y obtener imágenes que faciliten el tratamiento y disminuyan posibles causas de error, es adecuado establecer condiciones iniciales constantes de iluminación, contraste y apertura de la mano. Además en ambas bases de datos se evidencian sombras alrededor de los dedos, las cuales para algunos casos de binarización pueden ser un problema al momento de encontrar un umbral adecuado que no afecte el contorno.

2.2 Segmentación por umbralización

En el tratamiento de imágenes de la palma de la mano, se comienza por la imagen en escala de grises, el primer paso es binarizar esta imagen. El proceso de binarización es una técnica de segmentación que se emplea cuando existe una gran diferencia entre el objeto de análisis y el fondo de la imagen, evaluando la similitud y las diferencias entre los pixeles en escalas de grises, consiste entonces, en establecer un umbral óptimo que permita la mejor separación del objeto. El proceso de binarización finaliza comparando las intensidades con el umbral seleccionado, si es mayor la intensidad del pixel que la del umbral se le asigna blanco y de lo contrario se le asigna negro.

En la selección del umbral pueden presentarse problemas como: sombras generadas por la ubicación del objeto con respecto a la fuente de iluminación, ruido en la imagen, rugosidades en los bordes, eliminación de áreas por zonas de baja iluminación. Todos estos problemas pueden causar cambios en los bordes lo que ocasiona modificaciones en los puntos de ubicación de la ROI, que posiblemente alteren los resultados finales en un sistema de clasificación.

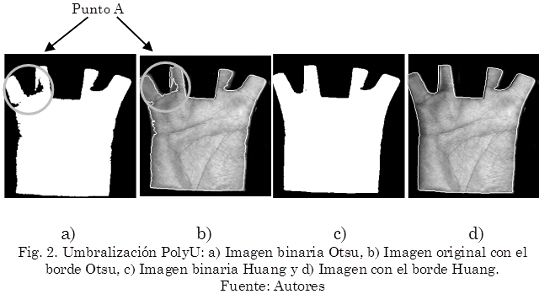

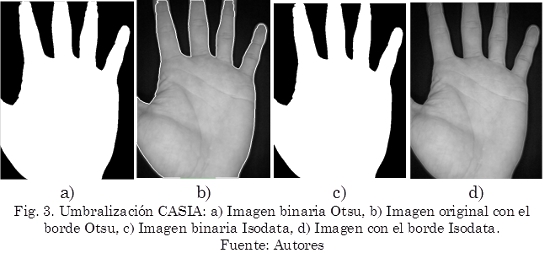

Existen diversas técnicas para obtener un umbral que están agrupadas en diferentes categorías basadas en: histograma, agrupación, entropía, atributos de los objeto, probabilidades de distribución y correlación, y métodos locales adaptativos (Sezgin, 2004). Para este trabajo se escogió el método Otsu (Otsu, 1979) de la categoría de agrupación, por ser ampliamente utilizado en la mayoría de trabajos reportados en la literatura; éste se compara con los métodos isodata, propuesto en Ridler (1978) y el planteado por Huang propuesto en (Huang & Wang, 1995). Estos dos últimos se seleccionaron debido a que se realizaron varias pruebas con varios métodos de umbralización y para la base de datos de PolyU, se observaron mejores resultados al comparar el borde generado por el método Huang sobre la imagen original (ver Fig. 2), mientras que, para la base de datos de CASIA el contorno que mejor bordeaba la imagen fue el obtenido con el método Isodata (ver Fig. 3). Los métodos de umbral evaluados fueron los siguientes: Intermodes, Li, Máxima entropía, Mínimo error, Momentos, Percentile, Shanbhag y Triangle propuesto en Zack (1977). A continuación se describen los métodos utilizados en el análisis en este documento.

El método Otsu se encuentra dentro de las técnicas de umbralización más utilizadas en la literatura, (Suárez 2007), y selecciona el máximo valor umbral de la varianza entre clases del histograma. El algoritmo consiste en buscar automáticamente un umbral global, para esto recorre todo el rango de niveles de grises tomando valores de umbral desde 0 a 255 y selecciona el valor de umbral que genere una menor varianza ponderada (Arámbula, 2008).

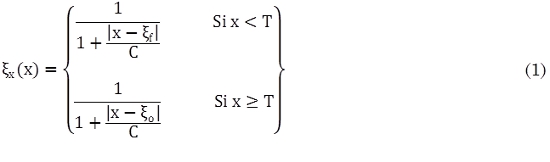

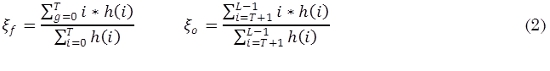

El método de Huang es una técnica basada en lógica difusa (Huang & Wang, 1995). La función de pertenencia en este método de umbralización se utiliza para indicar la relación entre un pixel y su región de pertenencia (el objeto y el fondo). Dado un valor de umbral, la función de membrecía de un pixel es definida por la diferencia absoluta entre el nivel de gris y el promedio del nivel de grises de la región de pertenencia. Cuanto mayor sea la diferencia absoluta, menor será la pertenencia. La función de pertenencia que asigna un valor de probabilidad a un pixel está dada por (1) y (2)

donde ξx(x) es la función de membrecía del conjunto difuso x, C es el contraste de la imagen, h(i) denota el número de ocurrencias del niveli en la imagen, T el valor umbral, ξf el promedio de niveles de gris en el fondo y ξo en el objeto. La estimación de similitud se hace seleccionando el valor de T que minimice E(t) (3)

donde N y M representan las dimensiones de la imagen y Hf representa la entropía del fondo.

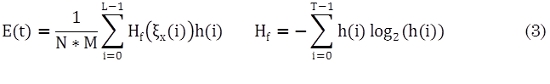

El método Isodata es una técnica iterativa que se utiliza para la obtención del umbral (Ridler, 1978). El histograma de la imagen se segmenta en dos partes utilizando un umbral inicial, el valor del umbral inicial corresponde a la mitad del máximo valor de intensidad, luego se calcula la media de cada segmento del histograma, m1, m2. Utilizando esos valores se calcula un nuevo valor de umbral mediante (4):

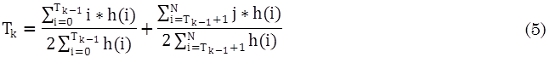

El proceso continúa hasta que en dos pasos consecutivos el valor umbral calculado no cambie. La ecuación genérica que calcula el umbral utilizando el histograma mediante este método es (5)

Donde Tk es el valor del umbral en la iteración k.

Al aplicar el algoritmo del método Otsu, se obtuvo un valor umbral de 85 para una imagen correspondiente a la base de datos de PolyU, consiguiendo los resultados mostrados en la Fig. 2a y al ubicar el borde generado de la imagen binaria y sobreponerlo sobre la imagen original, los resultados son los apreciados en la Fig. 2b Para el método desarrollado por Huang se obtuvo un valor umbral de 42 para una imagen correspondiente a la base de datos de PolyU, Fig. 2c y Fig. 2d. En la base de datos de CASIA para el método Otsu, se obtuvo un valor umbral de 84 Fig. 3a y 3b y para el método Isodata se obtuvo un valor umbral de 83 Fig. 3c y 3d. El punto A marcado en la Fig. 2 muestra claramente como las sombras en las imágenes causan problemas para algunos casos de umbralización y muestra como al obtener el umbral Otsu el contorno de la imagen se daña y en otros casos inclusive se desaparecen los dedos y la imagen binaria obtenida no es la adecuada.

Al evaluar este tipo de situaciones, se decidió trabajar con Huang para la base de datos de PolyU y con Isodata para CASIA. Los métodos Isodata y Otsu muestran un desempeño muy similar Fig. 3, no obstante, al evaluar con todas las imágenes de la base de datos el mejor desempeño fue obtenido con Isodata, debido a que son menos las imágenes que hay que eliminar porque generaban un borde inadecuado y por lo tanto una mala ubicación de la ROI, es decir, dejando zonas de fondo (pixeles en negro) que salen del área de la mano. Esta evaluación se efectuó cualitativamente y se realizaron 2 experimentos para cada una de las imágenes de ambas bases de datos (7752 imágenes y 5239 imágenes), en los que se determinaron el número de imágenes que fueron bien bordeadas en cada método, para definir qué tipo de método de umbralización era el mejor.

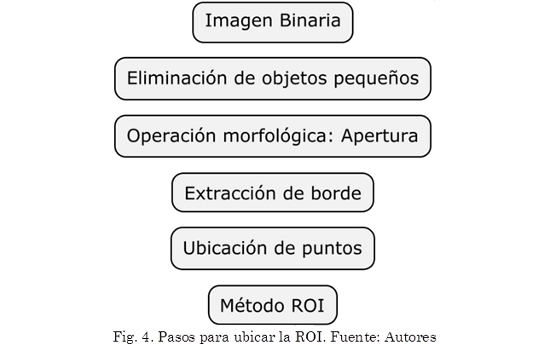

2.3 Ubicación de la región de interés

Los pasos que se realiza con cada una de las imágenes (Fig. 4), partiendo de la imagen binaria son: eliminación de objetos pequeños, operación morfológica de apertura, extracción de borde, ubicación de puntos y método ROI. Luego de obtener la imagen binaria se procede a eliminar los objetos pequeños o ruido que pueda contener la imagen, para ello se etiquetan los objetos que se encuentran en la imagen, se calcula el área de los objetos y son eliminados los que tengan un área menor de 10000 pixeles, con esto se asegura que el único objeto presente en la imagen es la mano, después de esto y con el fin de mejorar y suavizar los bordes de la imagen de la mano se recurre a un proceso morfológico de apertura, que es usualmente utilizado para suavizar el contorno del objeto y que consiste en eliminar los pixeles que se salen un poco del borde y los que forman pequeñas uniones, esto se consigue mediante una erosión (cambian los pixeles por cero si los vecinos están en cero) seguida de una dilatación (cambiar de cero al valor mayor si alguno de sus vecinos está en el máximo).

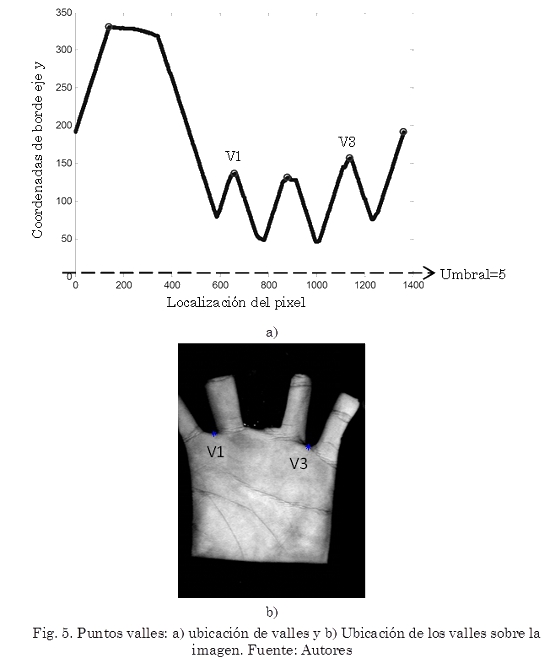

La detección del contorno para las imágenes comienza con las coordenadas del extremo inferior derecho de la imagen binaria, es decir “x” máxima (284 en el caso de PolyU y 480 para CASIA) y “y” máxima (384 para PolyU y 640 para CASIA), se recorre todo el borde de la palma y se almacenan en dos vectores las coordenadas pertenecientes a las filas y las columnas de borde. Obtenido el contorno se procede con la localización de los puntos, encontrando los mínimos o valles (Fig. 5b) formados por los dedos, esto se realiza a partir del vector del contorno definiendo un umbral (5 para PolyU y 20 para CASIA) hallado empíricamente en el eje y para identificar lo que se considera valle de lo que no lo es (Fig. 5a), el algoritmo se basa en el cálculo de la derivada para encontrar los cambios de sentido y finalmente se ubican los puntos que definen el cuadrado que compone la región de interés.

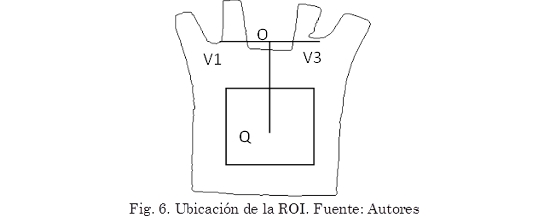

La ubicación de la región de interés delimitada en un cuadrado será determinada por dos procedimientos; en este artículo se denominará método 1 a la técnica basada en la propuesta de Toro & Correa (2009) donde el punto medio Q del lado superior del cuadrado, es aquel punto sobre la mediatriz del segmento V1V3 tal que OQ es igual a V1V3 ⁄2, donde O es el punto medio de V1V3 (Fig. 5a). Y se denominará método 2 a la técnica presentada en Zhang et al. (2003), Yuea et al. (2009) y Chen et al. (2010), donde el punto central de la ROI se ubica sobre la mediatriz del segmento V1V3 a una distancia predefinida tal que, OQ es diferente a V1V3 ⁄2 (Fig. 6). La variación presentada entre estos dos métodos es sólo una pequeña diferencia en la distancia del punto central.

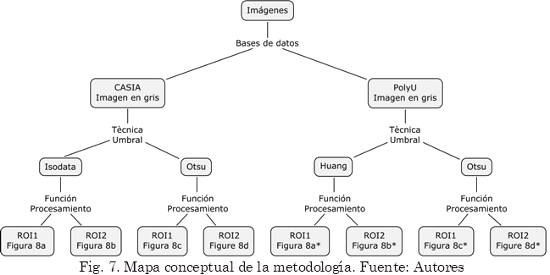

Resumiendo la metodología en la Fig. 7 se observan todos los pasos hasta la obtención de las imágenes de la ROI.

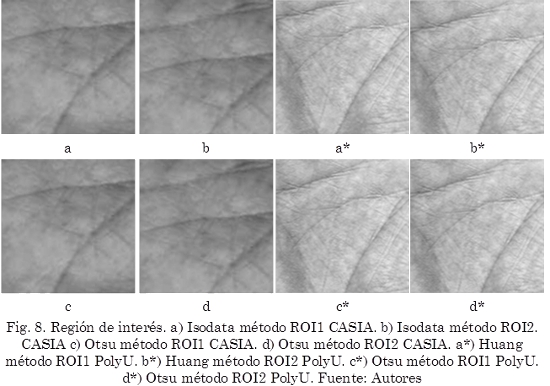

Al implementar los dos métodos de obtención de la ROI y los dos métodos umbral para cada una de las bases de datos, se obtienen las imágenes de la Fig. 8. Las figuras correspondientes a la base de datos de CASIA fueron mejoradas para la visualización.

En la Fig. 8 es evidente la variación que presentan las imágenes al cambiar el método ROI, esto se ve al comparar Fig. 8a con Fig. 8b y Fig. 8c con Fig. 8d. Para la variación de umbral comparando el método Otsu con Isodata no es notoria la diferencia, mientras que con Otsu y Huang si se presenta una variación apreciable.

2.4 Métricas de comparación de imágenes

Para analizar y comparar las imágenes generadas mediante el uso de las dos técnicas de umbralización y los dos métodos de ubicación de la ROI, se utilizan métricas como la correlación, el error medio cuadrático, la relación de uniformidad de la imagen, la información mutua y el área común.

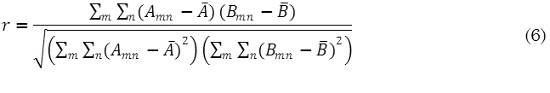

2.4.1 Correlación

La Correlación (Neto et al., 2007) describe el grado de dependencia lineal que existe entre las imágenes. El coeficiente de correlación oscila entre –1 y +1, encontrándose en medio el valor 0 que indica que no existe asociación lineal entre las dos imágenes en estudio, esta métrica está definida por (6)

Donde A y B representan las imágenes de la ROI que se comparan, A y B son las medias de las imágenes, n es el número de filas de la imagen y m es el número de columnas.

2.4.2 Error medio cuadrático

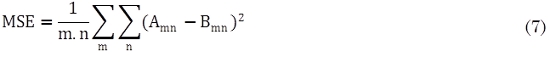

El error cuadrático medio (MSE) (Hernández et al., 2011) es utilizado usualmente como criterio objetivo de calidad para encontrar la diferencia entre una imagen original y una procesada o reconstruida. Cuando las imágenes tienen gran similitud el error cuadrático medio es pequeño. Se calcula con (7)

Donde m es el número de filas, n es el número de columnas.

2.4.3 Información mutua

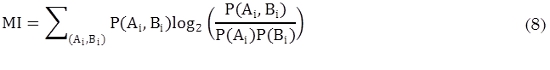

La información mutua (MI) es la cantidad que mide la dependencia equitativa de dos variables, para el caso particular mide la dependencia entre las imágenes (Holden, 2000). La información mutua de dos variables discretas Ai y Bi ecuación (8)

Donde P(Ai) es la probabilidad de la imagen A, P(Bi) la probabilidad de la imagen B y P(Ai, Bi) la probabilidad conjunta entre las distribuciones de las dos imágenes.

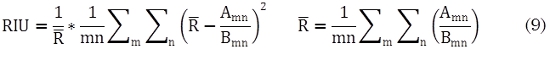

2.4.4 Relación de uniformidad de la imagen

La relación de uniformidad de la imagen (RIU), es también conocida como relación de variación de intensidad. Para cada estimación de transformación, se calcula la relación R de la imagen para dividir cada pixel en A por cada pixel en B, la uniformidad de R se determina para calcular la desviación estándar de R normalizada. (Holden, 2000; Sonka, 2004). La relación de uniformidad está dada por (9)

2.4.5 Área común

El área común (AC) es una medida propuesta en este documento para relacionar la cantidad de pixeles en común que tienen las dos imágenes. Se representa con (10)

donde A y B representan las dos imágenes y (x, y) la ubicación de los pixeles.

3. Resultados

Para cada base de datos se procede a realizar comparaciones de las ROI’s obtenidas variando el umbral y los métodos de ubicación de la ROI. Para la base de datos CASIA se emplean los métodos de umbralización Isodata y Otsu, mientras que para la base de datos PolyU se emplean Huang y Otsu. Debido a que con Isodata se obtuvo un mejor desempeño al generar el contorno de la mano para las imágenes de CASIA y con Huang se obtuvo un mejor contorno para las de PolyU.

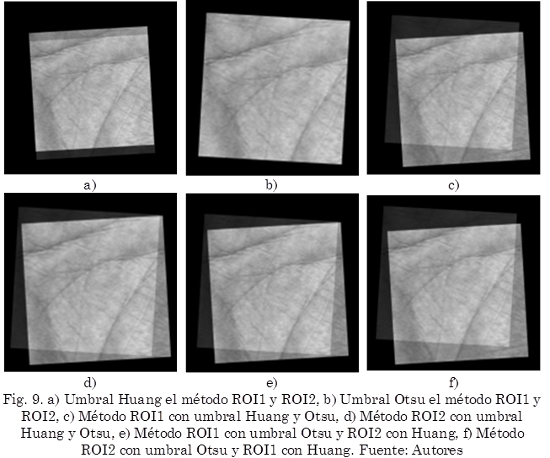

Para realizar la comparación entre las ROI’s, inicialmente se rota cada ROI al espacio de la imagen original. Para ello se coloca una de las imágenes sobre un fondo negro y luego sobreponer la otra imagen, desplazándola hasta donde exista la mayor coincidencia entre el valor de intensidad de los pixeles, es decir, donde las imágenes coinciden espacialmente. En las regiones donde no coinciden, se toma la imagen en negro para poder utilizar las métricas de comparación. En la Fig. 9a y 9b se muestra el ajuste obtenido utilizando el umbral Huang y umbral Otsu para los dos métodos de ubicación de la ROI respectivamente. En la Fig. 9c y 9d se muestra el ajuste obtenido utilizando los métodos de ubicación de la ROI1 y ROI2 para los métodos de umbralización Huang y Otsu. En la Fig. 9e se muestra el ajuste obtenido utilizando el método de ubicación de la ROI1 con umbral Otsu y la ROI2 con umbral Huang. Mientras que en la Fig. 9f se muestra el ajuste obtenido utilizando el método de ubicación de la ROI2 con umbral Otsu y la ROI1 con umbral Huang.

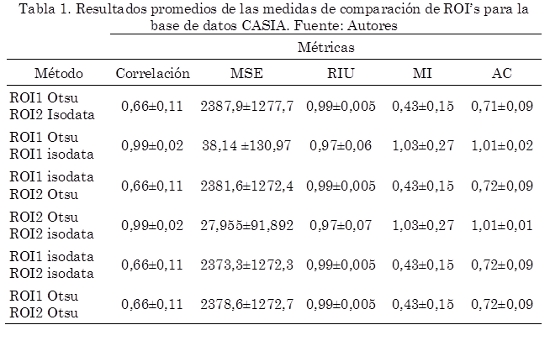

En la Tabla 1 se presentan los promedios y las desviaciones estándar de cada medida de comparación sobre la base de datos CASIA con 2694 imágenes. De la Tabla 1 se puede observar que sobre un solo método de ubicación de la ROI, (ROI1 o ROI2) sin importar el método de umbral (Otsu o Isodata) que se utilice, se obtiene la mayor similitud en la información contenida por ambas imágenes (ROI1 Otsu - ROI1 isodata y ROI2 Otsu - ROI2 Isodata) obteniendo en ambos casos una correlación de 0,99, una información mutua de 1,03 y 1,01 de área común, estos son los máximos valores de cada métrica presentados en la tabla. Además, la información anterior es confirmada por los valores de los errores cuadráticos medios que para el caso de la ROI1 es de 38,14 y para la ROI2 es de 27,955 y para la combinación de las ROI’s, el menor valor es 2373,3, que al compararlo con los errores anteriores es mucho mayor. Si lo que se varía es el método de ubicación de la ROI y se deja constante el método umbral se obtiene una correlación de 0,66.

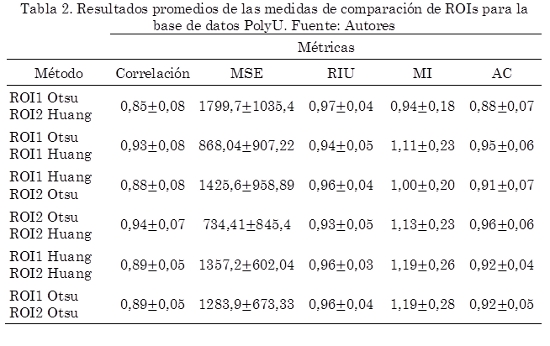

En la Tabla 2 se presentan los promedios y las desviaciones estándar de cada medida de comparación sobre la base de datos PolyU con 7749 imágenes.

De la Tabla 2 al igual que en la Tabla 1, se observa que sobre un solo método de ubicación de la ROI (ROI1 o ROI2) sin importar el método de umbral que se utilice (isodata y Otsu), se obtiene la mayor similitud en la información contenida por ambas ROI’s. A diferencia de la base de datos CASIA, las muestras de PolyU son registradas utilizando una plantilla para poner las manos, en consecuencia se reduce la variabilidad espacial de las imágenes.

El coeficiente de correlación no es suficiente para saber si las dos imágenes están correlacionadas o no, debido a que éste asume una relación lineal entre éstas. Sin embargo, al tomarlo como una métrica de similitud en todos los casos de PolyU se obtuvieron valores altos de correlación (cercanos a uno) y en el caso de CASIA se obtuvieron valores de 0,99 sólo en los casos donde el método de la ROI no variaba.

La relación entre las diferentes métricas es apreciable (Tabla 2) y consecuente, ya que en los casos donde se presenta mayor correlación (93,94) hay mayor área común (95,96) y además el error cuadrático medio (868,04; 734,41) y la relación de uniformidad de la imagen (94,93) disminuyen. Esta coherencia entre los métodos también aplica para la base de datos de CASIA (Tabla 1).

4. Conclusiones

Este análisis demostró que efectivamente el cambio de los métodos de umbralización genera cambios en la ROI de la palma de la mano, debido a que la localización de los puntos valle cambia según el método utilizado, tanto para la base de datos de CASIA como para la base de datos de PolyU.

La información contenida por cada método de obtención de la ROI es diferente y depende de las condiciones en que se capturaron o registraron las muestras de la base de datos, esto se debe a que no es lo mismo contar con imágenes que fueron tomadas bajo condiciones controladas (iluminación, contraste y apertura de mano) a las que no lo fueron, porque esto afecta la extracción del borde y por lo tanto la ubicación de la ROI.

Referencias

Arámbula, F., (2008); Automatic initialization of an active shape model of the prostate. Medical Image Analysis, 12(4), 469-483. [ Links ]

Chen, J., Moon, Y.-S., Wong, M.-F., & Su, G., (2010); Palmprint authentication using a symbolic representation of images. Image and Vision Computing. [ Links ]

Han, C.-C., Cheng, H.-L., & Fan, K.-C., (2002); Personal Authentication Using Palm Print Features. The 5th Asian Conference on Computer Vision. Melbourne, Australia. [ Links ]

Han, C.-C., Cheng, H.-L., Lin, C.-L., & Fan, K.-C., (2003); Personal authentication using palm-print features. Pattern Recognition. [ Links ]

Hernández, J. M., Sanz, G. P., & Guijarro, M., (2011); Técnicas de procesamiento de imágenes estereoscópicas, Revista del CES Felipe II. [ Links ]

Holden, D. L., (2000); Voxel Similarity Measures for 3-D Serial MR Brain Image Registration. IEEE Transactions On Medical Imaging, 94-102. [ Links ]

Huang L-K. & Wang., M-J. J., (1995); Image Thresholding by Minimizing the Measures of Fuzziness, Pattern Recognition, 341-347. [ Links ]

Lin, C.-L., C. Chuang, T., & Fan, K.-C., (2005); Palmprint verification using hierarchical decomposition. Pattern Recognition. [ Links ]

Neto, A. M., Rittner, L., Leite, N., & Zampieri, D., (2007); Pearson's correlation coefficient for discarding redundant information real time autonomous navigation system. Ieee International conference, 426-431. [ Links ]

Otsu, N., (1979); A threshold selection method from gray level histograms. Systems, Man and Cybernetics, IEEE Transactions on, 62-79. [ Links ]

Ridler, T., (1978); Picture thresholding using an iterative selection method. IEEE Transactions on Systems, Man and Cybernetics, 8: 630-632. [ Links ]

Sezgin, M., (2004); Survey over image thresholding techniques. Journal of Electronic Imaging, 13(1), 146-165. [ Links ]

Shang, P., & Li, T., (2009); Multifractal characteristics of palmprint and its extracted algorithm. Applied Mathematical Modelling. [ Links ]

Sonka, M., (2004); Handbook of Medical Imaging: Medical image processing and analysis. Bellingham Washington: The international society for optical engineering. [ Links ]

Suárez, R. F., (2008); Autentificación de Personas a partir de la Biometría de las Venas de la parte Posterior de la Mano. Revista Colombiana de Tecnologías de Avanzada, 2, 62-68. [ Links ]

Toro, Ó. F., & Correa, H. L., (2009); Identificación biométrica utilizando imágenes infrarrojas de la red vascular de la cara dorsal de la mano. Revista ingeniería e investigación, 90-100. [ Links ]

Yuea, F., Zuo, W., Zhang, D., & Wang, K., (2009); Orientation selection using modified FCM for competitive code-based palmprint. Pattern Recognition. [ Links ]

Zack GW, R. W., (1977); Automatic measurement of sister chromatid exchange frequency. J. Histochem. Cytochem, 25 (7): 741-53. [ Links ]

Zhang, D., Kong, W.-K., You, J., & Wong, M., (2003); Online Palmprint Identification. IEEE Transactions on pattern analysis and machine intelligence. [ Links ]