Introducción

La inteligencia artificial (IA) puede ser empleada en la conducción de conflictos armados, bien sea como un medio o como un método. Como medio, puede emplearse en la forma de una herramienta o arma sinérgicamente adaptada con la robótica para los enfrentamientos durante el conflicto. Como método, puede apoyar la toma de decisiones y la forma en que se adelantan las hostilidades. En este caso, los países que cuenten con un desarrollo importante en IA tendrían una ventaja desde el punto vista estratégico, táctico u operacional, al disminuir o anular la polaridad del adversario, en el sentido definido por Clausewitz (2017): “La fuerza impulsiva inherente a la polaridad de intereses puede ser anulada por la diferencia existente entre la fuerza del ataque y la de la defensa, y dejar así de tener eficacia” (p. 43).

Actualmente, es importante aprovechar el desarrollo tecnológico en busca de aumentar la polaridad y la ventaja militar. Por ello, De la Fuente (2017) plantea lo siguiente: “Es preciso que las capacidades militares se vean transformadas aplicando procesos de datos, conectividad, robótica, autonomía, inteligencia artificial (IA) y aprendizaje automático (ML)” (p. 81). Esto ha llevado a que diferentes ejércitos del mundo inviertan en investigación y desarrollo para la aplicación de todo lo concerniente a robótica, IA y aprendizaje automático en actuales y eventuales conflictos armados.

Aunado a lo anterior, la IA, junto con los avances en robótica, están generando una nueva revolución: “La revolución robótica ha sido descrita como la siguiente gran revolución en cuestiones militares, de importancia equivalente a la introducción de la pólvora y las bombas nucleares” (Singer, como se citó en Organización de las Naciones Unidas [ONU], 2013, p. 6). Por consiguiente, al igual que sucedió con la pólvora y las bombas nucleares, los Estados deben ajustar sus políticas de seguridad y defensa, teniendo en cuenta las ventajas y los riesgos que supone el uso de robots o armas autónomas con IA en el ambiente operacional y el teatro de operaciones militares.

En este sentido, la presente investigación se pregunta cuáles son los usos que se pueden dar a la IA como medio o como método en la conducción de un conflicto armado. El objetivo es determinar los principales empleos y usos como método y como medio de esta tecnología en estrategia militar. Para esto se plantearon seis hipótesis de posibles usos (para efectos prácticos, las primeras dos hipótesis se deben entender como una sinergia entre IA y robótica):

Hipótesis 1. Fortalecimiento de la IA donde la máquina decide atacar, pero antes solicita la aprobación del humano (IAAH).

Hipótesis 2. Fortalecimiento de la IA donde la máquina actúa y decide por sí misma (IAA).

Hipótesis 3. Fortalecimiento de la IA en las operaciones militares psicológicas (IAOMP).

Hipótesis 4. El derecho internacional y la ética no permiten el uso de la IA en la conducción de la guerra (ni como medio ni como método) (DI DIH).

Hipótesis 5. La IA se utiliza como un factor disuasivo frente al contrincante para anular su polaridad (IAPD).

Hipótesis 6. La IA se utiliza como un método y un medio disruptivo en los conflictos híbridos (IACH).

Si bien el concepto de inteligencia artificial se escucha frecuentemente, es importante no solo definirla conceptualmente, sino también exponer sus modelos existentes, con el fin de comprender a qué se refiere cada una de estas hipótesis. Así, Ponce et al. (2014) definen la IA de la siguiente forma:

Es un área de la ciencia de gran interés por ser un área multidisciplinaria donde se realizan sistemas que tratan de hacer tareas y resolver problemas como lo hace un humano, así mismo se trata de simular de manera artificial las formas del pensamiento y cómo trabaja el cerebro para tomar decisiones. (p. 11)

Este aporte a la toma de decisiones se puede ver en diferentes aspectos, como la toma de decisiones empresariales:

La IA y otras tecnologías inteligentes pueden ayudar a los tomadores de decisiones humanos con análisis predictivos, generando ideas frescas a través de enfoques de inferencia estadística, basada en datos y probabilidades, como también identificar relaciones entre los diferentes factores, lo que permite que estos puedan recopilar de manera más efectiva y actuar sobre nuevos conjuntos de información. Una de las funciones principales del análisis predictivo es generar nueva información y predicciones. (Diestra et al., 2019, p. 57)

Los análisis predictivos son los más aptos para utilizarse en la toma de decisiones en el ámbito militar, dado que la IA en este entorno hace diferentes tipos de análisis, con base en los datos proporcionados en el ambiente operacional. La única diferencia entre la toma de decisiones empresariales y militares es el tipo de datos a analizar y el fin o utilización de dicho análisis.

Por otra parte, es importante comprender los modelos de IA. Como Ponce et al. (2014) explican, estos modelos se basan en el objetivo y la forma en que trabaja el sistema. Esta clasificación inicialmente concebía modelos independientes; en la actualidad, los sistemas mezclan características y se diferencian en cuatro modelos (Figura 1).

Fuente: Elaboración propia con base en Ponce et al. (2014)

Figura 1. Modelos de inteligencia artificial.

El primer modelo (sistemas que piensan como humanos) refleja el funcionamiento de la mente humana. Este modelo intenta elaborar una teoría sobre el funcionamiento de la mente a partir de la cual se establezcan los modelos computacionales.

El segundo modelo (sistemas que actúan como humanos) lo constituye el ser humano. Cuenta con capacidades de procesamiento de lenguaje natural, representación del conocimiento, razonamiento y aprendizaje.

El tercer modelo (sistemas que piensan racionalmente) se basa en las leyes del pensamiento racional, que se fundamentan en la lógica (silogismos de Aristóteles). En este modelo, la lógica formal está en la base de los programas inteligentes (logicismo).

El cuarto modelo (sistemas actuantes racionales), generalmente aplicado a la robótica, percibe y actúa según el entorno y tiene capacidades de percepción, procesamiento de lenguaje natural, representación del conocimiento, razonamiento, aprendizaje automático, visión de la actuación general y no centrada en el modelo humano.

Es importante resaltar que, si bien estos modelos de IA se pueden adherir a sistemas robóticos -como lo explica el modelo del sistema de actuantes racionales-, no es una regla que todos los robots cuenten con algún modelo de IA o que la inteligencia sea usada solo en los robots. Este es un error frecuente al que nos lleva la falsa creencia de que el uno es dependiente del otro.

Por consiguiente, al explicar el uso de la IA como medio, se hará referencia a sistemas de armas autónomos, por lo general ajustados al modelo de sistemas de actuantes racionales, donde hay una sinergia entre la IA y la robótica. De igual manera, cuando se explique el uso de la IA como método, se hará referencia a su uso sin necesidad de una sinergia con la robótica.

Inteligencia artificial como un medio

El uso de la IA como medio, en sinergia con la robótica, que conforma un sistema de armas autónomas letales o robots autónomos letales, ha generado un debate de importancia en la agenda internacional desde el punto visto ético y del derecho internacional. Al respecto, la ONU (2013) manifiesta:

Los robots autónomos letales son sistemas de armas que, una vez activados, pueden seleccionar y atacar objetivos sin necesidad de intervención humana. Dan lugar a graves cuestiones relacionadas con la protección de la vida en tiempos tanto de guerra como de paz, a saber, entre otras, la medida en que se pueden programar para cumplir las prescripciones del derecho internacional humanitario y las normas del derecho internacional de los derechos humanos relativas a la protección de la vida. Por otra parte, su despliegue puede ser inaceptable porque no es posible establecer un sistema adecuado de responsabilidad jurídica y porque los robots no deben tener el poder de decidir sobre la vida y la muerte de seres humanos. (p. 1)

Debido a lo anterior, tanto organismos internacionales como organizaciones no gubernamentales han expresado igualmente sus reparos, como Amnistía Internacional (2018):

El uso de armas totalmente autónomas, sin control humano efectivo y significativo, sería incompatible con el derecho internacional de los derechos humanos y podría dar lugar a muertes y lesiones causadas de manera ilegítima y a otras violaciones de derechos humanos. (párr. 11)

Ante las diferentes preocupaciones sobre la compatibilidad de estas armas con el derecho internacional y el derecho internacional humanitario, en 2017 se realizó la primera reunión de expertos gubernamentales sobre sistemas de armas autónomas letales. Allí, el Comité Internacional de la Cruz Roja (CICR, 2017) expuso lo siguiente:

Desde el punto de vista del derecho internacional humanitario, está claro que las normas sobre la conducción de hostilidades están destinadas a quienes planifican, deciden y llevan a cabo un ataque. Esas normas, que se aplican a todos los ataques independientemente de los medios o métodos que se empleen y no se pueden transferir a una máquina, a un programa informático o a un sistema de armas. (párr. 7)

Al hablar de la IA como medio, lo que más destaca es cuando hace una sinergia con la robótica, ya que la responsabilidad en un ataque de un robot sin IA, es decir, sin autonomía en la decisión de atacar, jurídicamente recae sobre la persona encargada. En este sentido, los debates se centran en los robots con IA que puedan llegar a tener una autonomía total respecto a la decisión de ejecutar una maniobra ofensiva.

Puesto que la responsabilidad moral de las decisiones de matar y destruir no se puede delegar en máquinas, el control humano significativo, efectivo o apropiado -desde el punto de vista ético- sería el tipo y grado de control que mantiene la acción y la responsabilidad humanas en estas decisiones. (CICR, 2017, párr. 10)

De igual forma, en la reanudación de la labor del Grupo de Expertos Gubernamentales después de la pandemia, el CICR (2021) expuso lo siguiente sobre las armas letales autónomas:

Desde el punto de vista jurídico, afecta la capacidad de las personas que deben aplicar las normas del derecho internacional humanitario durante la planificación, la decisión y la ejecución de los ataques de cumplir sus obligaciones. Desde el punto de vista ético, el proceso de funcionamiento de los sistemas de armas autónomos implica el riesgo de reemplazar efectivamente la decisión humana sobre la vida y la muerte por procesos controlados por sensores, software y máquinas. (párrs. 5-6)

Esto muestra una debilidad del derecho internacional respecto al uso de este tipo de armamento, ya que, por lo general, el derecho tiende a ser correctivo y legislar después de ocurrido el hecho victimizante. Así, al ser un arma autónoma el posible victimario que tomó la decisión de atacar, aumenta el debate en las instancias internacionales donde se determina la responsabilidad jurídica ante una violación del derecho internacional.

Como lo reitera el Parlamento Europeo (2021), la toma autónoma de decisiones no debe eximir a los seres humanos de su responsabilidad; las personas siempre son responsables en última instancia de los procesos de toma de decisiones, de modo que debe identificarse quien ha sido responsable de una decisión. De igual modo, para la Oficina de Asuntos de Desarme de las Naciones Unidas (2022), “toda decisión sobre el uso de la fuerza debe ser responsabilidad de un ser humano en todo momento, de conformidad con el derecho internacional aplicable” (p. 2).

Según lo expuesto, la responsabilidad de las decisiones de las armas autónomas debe recaer sobre un ser humano; sin embargo, no se indica explícitamente quién debe ser el responsable, entendido como quien planifica, decide, toma decisión de usarlas, las programa, etc. En este caso, son varias las personas potencialmente responsables, pero no hay consenso sobre en quién específicamente debe recaer la responsabilidad.

Por ello se han celebrado seis conferencias de revisión de los Estados parte de la Convención de las Naciones Unidas sobre Ciertas Armas Convencionales. Respecto a la última, realizada en Ginebra en diciembre de 2021, Amoroso y Tamburrini manifiestan lo siguiente (2022):

Los observadores coinciden en que el fracaso de la sexta conferencia de revisión, así como las dificultades en los trabajos del Grupo de Expertos Gubernamentales, se deben en última instancia a las acciones de un pequeño grupo de potencias militares. Lideradas por Estados Unidos y Rusia, estas potencias utilizan el método del consenso, que caracteriza el proceso de toma de decisiones de la Convención de las Naciones Unidas sobre Ciertas Armas Convencionales, para bloquear cualquier avance en el debate. Esta oposición a la regulación multilateral se explica por el temor a que un requisito excesivamente restrictivo de control humano conduzca a una prohibición indiscriminada de todas las armas autónomas, a pesar de los beneficios militares esperados. (párr. 4)

En consecuencia, prima el desarrollo militar para escalar en la carrera armamentista o neutralizar la polaridad del adversario, dado que este es uno de los principales beneficios esperados del desarrollo armas autónomas. Un ejemplo de esto lo explica Adán (2021):

El secretario de Defensa norteamericano, Chuck Haguel, anunció importantes inversiones en proyectos tecnológicos de primer orden para conseguir la superioridad tecnológica con sus principales rivales estratégicos: China y Rusia. Estos avances tecnológicos se deberían llevar a cabo en áreas como la robótica, sistemas autónomos [...], etc. De inmediato, ciertos centros de pensamiento e instituciones vieron en estas declaraciones el inicio de una tercera estrategia de compensación, entendiendo como tal, la inversión tecnológica, en el ámbito de la defensa, que permita el desarrollo de nuevos armamentos y capacidades para distanciarse de aquellos rivales estratégicos que se han acercado peligrosamente. (p. 3)

Esta misma opinión es la de países que se han opuesto a una regulación multilateral fuerte, que ven a Estados Unidos como un rival militar que hay que alcanzar o superar, lo que implica aumentar la inversión en tecnología para la defensa nacional y su defensa en los organismos internacionales, por lo cual limitan los avances en materia de regulación desde el derecho internacional.

En este sentido, la principal alarma desde el punto de vista del derecho internacional, más que el uso de la IA como método, es su uso como medio, ya que delegar la decisión de atacar o no en un arma autónoma, sin necesidad de la aprobación del Estado Mayor o de un comandante, puede derivar en atentados contra personal civil o infraestructuras protegidas por los convenios internacionales con tal de cumplir una misión para la cual ha sido programada. Pero, pese a la preocupación frente a estos sistemas autónomos, su avance ya es una realidad. Según Reyes (2021):

Actualmente, países como Estados Unidos, Israel, Reino Unido, China, Corea del Sur y Rusia son pioneros en el uso de armas totalmente autónomas. Estos países están invirtiendo fuertemente en aplicaciones militares de inteligencia artificial y computacional con el objetivo de obtener una ventaja tecnológica en la autonomía de la próxima generación de conflictos armados. (p. 15)

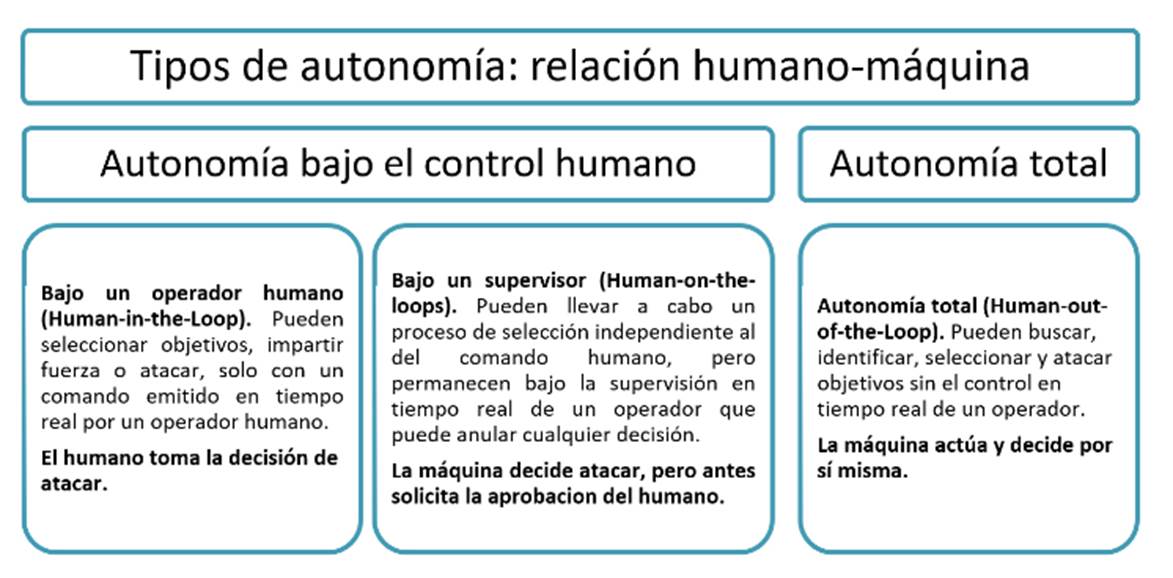

Con el propósito de entender esto, es importante especificar las categorías de autonomía utilizadas en los diferentes tipos de medios manejados en el teatro de operaciones (Figura 2). Se pueden dividir en dos grandes categorías: sin control humano y bajo control humano, y esta se divide en dos subcategorías.

Fuente: Elaboración propia basada en Shkurti (2019) y Human Rights Watch (2012, como se citó en Reyes, 2021)

Figura 2. Tipos de autonomía en armamento.

En los conflictos armados de las últimas décadas, pese al desarrollo tecnológico, no se han aplicado los tres tipos de medios anteriormente descritos. Como lo explica Shkurti (2019), en el campo militar “se puede hablar de la aplicación del primer y segundo caso (autonomía bajo el control humano), es decir, drones y guías de precisión de misiles, mientras que la aplicación de la IA no alcanzó el tercer nivel de plena autonomía” (p. 10; traducción propia).

Por lo tanto, actualmente no hay armas autónomas que estén realizando operaciones en algún conflicto armado, pero sí se están utilizando los vehículos aéreos no tripulados como un medio en el uso de la fuerza letal. Pese a que estos vehículos están dotados con IA, la decisión de atacar depende del Estado Mayor, quien da la orden, y el operario del vehículo la ejecuta, como se ha visto en la guerra de Irak. Si bien por el momento la decisión de atacar con estos vehículos aéreos no tripulados con IA continúa bajo el control de un supervisor, el desarrollo de armas letales autónomas continúa avanzando en la industria armamentística y se espera probarlas en el teatro de operaciones. De ahí la importancia de lo descrito por Fojón (2019):

La forma de hacer la guerra evoluciona con los avances tecnológicos y los recursos disponibles de cada sociedad. Los planificadores militares diseñan conceptos operativos que aprovechan la tecnología disponible para aplicarla de la forma más eficaz posible en los distintos dominios donde actúan. (párr. 2)

Existen varios ejemplos de uso de tecnología y recursos disponibles en conflictos armados que han implicado grandes avances tecnológicos y en ingeniería de materiales a lo largo de la historia. Así sucedió en la Primera Guerra Mundial, como lo explica Losada (2017): “la artillería alcanzó sus cotas más altas de desarrollo tecnológico, llegándose a fabricar piezas que podían lanzar proyectiles a 130 kilómetros de distancia. Lo posibilitó un nuevo desarrollo de la metalurgia” (p. 30).

Al finalizar la Gran Guerra se hicieron diferentes análisis para determinar cuáles fueron las fallas y los puntos críticos durante las operaciones en este conflicto armado internacional. Esto llevó a buscar medios y métodos para mejorar estratégica, táctica y operativamente la conducción de los conflictos. Por esa razón:

Tras la Primera Guerra Mundial todas las potencias crearon departamentos de investigación bajo supervisión gubernamental, con lo que la carrera armamentística también se convirtió en científica y tecnológica, implicando a miles de hombres de ciencia. Uno de los primeros avances que se dio en este periodo entreguerras fue el radar, que fue perfeccionándose rápidamente. Lo mismo sucedió con las transmisiones de radio, que permitieron una coordinación entre unidades y armas nunca vista. Otra innovación revolucionaria que cambió la naturaleza de las batallas navales y de las mismas guerras, permitiendo mantener los choques a grandes distancias desde las bases de partida, fue la aparición de los portaaviones que se demostrarían decisivos. (Losada, 2017, p. 31)

Uno de los factores más importantes en la carrera armamentista se dio en el periodo entre la finalización de la Primera Guerra Mundial y el comienzo de la Segunda, cuando se emprendió la carrera y se determinó la participación decisiva de la ciencia, o mejor, de la comunidad científica, que aportaría desde sus laboratorios para fortalecer el desarrollo tecnológico de los medios y métodos utilizados en los conflictos armados.

Por ello, en la Segunda Guerra Mundial se presentó un avance tecnológico importante. Entre otras cosas, se creó el espectro disperso, que consistía en un sistema de comunicaciones capaz de saltar entre frecuencias para transmitir información, utilizado para construir torpedos teledirigidos por radio que no pudieran detectar los enemigos (González, 2018). Por otra parte, se crearon máquinas como el Enigma, utilizada por la armada alemana tanto para cifrar como para descifrar mensajes a través de rotores. También se desarrollaron combustibles sintéticos y cabinas presurizadas. También se destaca Colossus, considerado por muchos como uno de los primeros computadores, entre otros desarrollos no menos importantes.

Estos son algunos ejemplos de cómo el desarrollo tecnológico ha sido utilizado por actores militares en los conflictos armados, en un periodo de creación e innovación tecnológica de tan solo treinta años (entre el comienzo de la Primera Guerra Mundial y el final de la Segunda). Ahora ya han pasado más de setenta años de estos avances, y la tecnología ha avanzado de forma exponencial, pasando por la creación de helicópteros, submarinos nucleares, satélites, internet, drones, entre otros métodos y medios aprovechados por los planificadores militares.

Son estos mismos planificadores militares quienes han visto la importancia de desarrollar sistemas de armas autónomos, ante el hecho de que el papel de los seres humanos en el teatro de operaciones habrá disminuido notoriamente en menos de treinta años, como lo advierte la Fuerza Aérea de Estados Unidos (2010):

Las capacidades humanas naturales se están volviendo cada vez más incompatibles con los enormes volúmenes de datos, capacidades de procesamiento y velocidades de decisión que las tecnologías ofrecen o demandan. Aunque los humanos hoy son más útiles o capaces que las máquinas para diferentes tareas, para 2030 las capacidades de las máquinas habrán aumentado hasta el punto de que los humanos se habrán convertido en el componente más débil de una amplia gama de sistemas y procesos. (p. 106; traducción propia)

Por ello, diferentes Estados han incluido armas autónomas dentro de sus simulacros militares, como lo explica el Ministerio de Defensa de la Federación Rusa (2021):

Los sistemas robóticos de reconocimiento y apoyo con fuego “Urán-9” eliminaban la fuerza viva y el material blindado del enemigo convencional a distancias entre 3 y 5 mil metros por los sistemas de misiles “Ataka”, los lanzallamas de infantería RPO PDM-A, los cañones automáticos de 30 mm y las ametralladoras PKTM. Para realizar el reconocimiento y prestar el apoyo a las pequeñas unidades avanzadas, ha sido utilizado el robot de combate “Nerejta”, dotado de la ametralladora “Kord” de 12,7 mm y del lanzagranadas AG-30M de 30 mm. El robot de combate “Nerejta” sirve para realizar el reconocimiento, reglar el fuego sobre posiciones hostiles, suministrar municiones y pertrechos. En dependencia del módulo instalado, el robot puede utilizarse con varios fines. (párrs. 3-5)

Esto indica las limitaciones humanas y cómo la IA las está superando fácilmente, en especial la velocidad de análisis, interpretación y respuesta a una gran cantidad de datos en poco tiempo, que a la vez disminuye la probabilidad de error humano casi a cero (0). Por esta razón ya se están utilizando armas autónomas en simulacros militares, que aprenden a través del reconocimiento de diferentes patrones, hacen predicciones y, a partir de estas, toman decisiones sin requerir el factor humano.

Finalmente, la proyección de las armas autónomas genera una ventaja estratégica desde el punto de vista militar, como en épocas anteriores lo hicieron las armas nucleares. En todo caso, la limitación para su implementación no es su desarrollo ni el avance tecnológico, ya sea para su construcción o adquisición por parte de los Estados, sino únicamente su uso ético y en concordancia con el derecho internacional, como quedó explícito en el Tratado sobre la Prohibición de las Armas Nucleares o la Convención sobre las Armas Químicas.

Inteligencia artificial como un método

La IA es mayormente utilizada en el contexto militar como método, debido a su aporte en la toma de decisiones del Estado Mayor y los comandantes, que constituye la principal diferencia con el uso de la IA como medio. Así pues, como método, el comandante es quien toma la decisión a través de los resultados arrojados del análisis de datos realizado por la IA. Como se ha dicho, esto no genera debates desde la ética y el derecho internacional, ya que hay un ser humano responsable de la operación armada. En este caso, el debate surge ante su uso para el análisis de datos.

En concordancia con lo expuesto, Barragán (2019) manifiesta:

Se considera al comandante como el centro de la operación. Sin embargo, debe estar interconectado con toda la red tanto para nutrirse de información como para guiar estratégicamente a las distintas fuerzas bajo su mando. Para ello, la creación de un nuevo sistema basado en datos enriquecería la COP [common operational picture, imagen operacional común], ya que mejoraría las distintas etapas clave del proceso de mando: la recopilación e integración de información, la planificación, preparación y ejecución y la evaluación continua. Asimismo, el flujo de datos desde sus originadores a los consumidores de la información sería facilitado por este sistema. De esta forma, el propio sistema haría llegar a los subordinados una visión global e informaría a los distintos miembros del escalafón de cómo sus acciones contribuyen al progreso de la operación. (p. 47)

Gracias a esto, la IA aporta información sobre todas las fases del ambiente operacional, teniendo en cuenta las operaciones ofensivas o defensivas, lo cual ayuda a reducir el nivel de incertidumbre en el teatro de operaciones. Por consiguiente, la IA puede analizar diferentes variables en función de la conducción de la guerra. Según el Ejército Nacional de Colombia (EJC, 2017), “los comandantes emplean estas seis funciones de conducción de la guerra para proporcionar dirección a los subordinados” (Figura 3).

La IA aporta en todos los factores de conducción de la guerra, lo cual brinda al Estado Mayor o al comandante la mejor estrategia y táctica para escalar el conflicto. Por esta razón, Mohino (2019) resalta lo siguiente:

En el campo de batalla pueden ser utilizados diversos sensores registrando información de la posición, el estado físico, emocional y mental, así como las capacidades de un soldado en tiempo real para hacer frente a diferentes situaciones. Con respecto al enemigo pueden reconocer sus armas, estrategias y estudiar su ejecución para contraatacar o defender de un modo más eficiente. La información proporcionada por los diferentes sensores puede ser utilizada de manera individual o combinada con los datos proporcionados por otros sensores, de modo que se pueden crear sistemas con una inteligencia y capacidad muy superior a la humana. (p. 19)

En este caso, el soldado, además de ser un actor que participa en la línea de fuego, también es un agente estadístico, que aporta información en tiempo real a los comandantes gracias a diferentes sensores, y brinda sugerencias que aportan a escalar en el conflicto. Por otra parte, la IA también ayuda al soldado a tomar sus propias decisiones, al monitorear constantemente su cuerpo a través de sus signos vitales y fisiológicos, lo que permite corregir decisiones tomadas en momentos de enajenación mental.

Asimismo, según los datos recolectados, es capaz de presentar al comandante una serie de recomendaciones para llevar de forma precisa y efectiva la conducción de la guerra, teniendo en cuenta los medios y métodos utilizados por los adversarios.

Esto demuestra que un factor estratégico no es solamente tener mayor información en el teatro de operaciones, sino también la velocidad y capacidad de análisis de esta información, pues esto fortalece la toma de decisiones por parte del Estado Mayor o los comandantes. Por esta razón, diferentes países están invirtiendo cada vez más en desarrollo tecnológico de IA no armamentística que genere mejores diagnósticos, teniendo en cuenta no solo lo que ocurre en el teatro de operaciones, sino también factores y variables que inciden en el proceso militar para la toma de decisiones. Díaz-Jaimes et al. (2019) definen estos factores así:

Todos los factores que puedan afectar directa o indirectamente la ejecución de esta, en cualquier misión que se designe mediante análisis de un acrónimo METTTC (misión, enemigo, terreno y clima, tropas y apoyo disponible, tiempo disponible y consideraciones civiles) y las variables del entorno PENSITIM (política, económica, militar, social, información, tiempo, infraestructura y medio ambiente físico). (p. 99)

Por lo anterior, se puede concluir que en la conducción de la guerra no solo hay que tener en cuenta la variable militar, ya que esta no basta por sí sola para determinar la victoria en un conflicto armado. Hay múltiples factores y variables que merecen ser considerados, lo cual se traduce en una cierta cantidad de personal analizando cada factor o variable, que alimente con esta información los desarrollos en IA, para analizar y determinar la mejor estrategia.

Inteligencia artificial como medio y método (híbrido)

La guerra ha evolucionado desde el punto de vista táctico y estratégico, lo que ha significado transformaciones constantes. Por ello, “uno de los elementos esenciales de la estrategia militar ha sido siempre el comprender más deprisa que el adversario las transformaciones de la guerra” (Beaufre, como se citó en Fernández-Montesinos, 2015, p. 6). La actual transformación se refiere a las guerras híbridas, que requieren igualmente métodos y medios híbridos para contrarrestar la acción del adversario. Para entender esto, es necesario comprender las cuatro generaciones de la guerra y sus trasformaciones primordiales.

Las generaciones de las guerras se definen y distinguen a partir de cambios primordiales en los métodos o medios utilizados respecto a la generación anterior. Por esto, la principal diferencia entre las guerras de primera generación (guerras independistas) y las de segunda generación es, según Álvarez et al. (2018), “la capacidad de movilización y el uso de maquinaria bélica con un mayor poder de fuego” (p. 159). Por su parte, la diferencia entre esta y la tercera generación ha sido, como explica Haro (2019), “el mando tipo misión, disminuir la dependencia logística centralizada, mayor énfasis en la maniobra y abatir al enemigo emocionalmente”. Finalmente, el principal cambio de las guerras de cuarta generación respecto a las anteriores es que se deja de hablar de guerras entre Estados para hablar de guerras entre Estados y diferentes actores no estatales. Con relación a esto, Henso (2018) afirma: “Las guerras de cuarta generación constituyen formas actualizadas de guerra de desgaste, guerra total o irrestricta [...], donde recurren a los medios que tienen a su disposición para alcanzar sus fines” (p. 44).

Es importante resaltar que un fin primordial de las guerras de tercera generación se centraba en el factor psicológico, esto es, cómo se puede afectar emocionalmente al adversario. Este factor ganó mayor importancia y ha sido bastante utilizado en las estrategias de las guerras de cuarta generación para desgastar al adversario. Por ello, actualmente las operaciones militares no solo tienen en cuenta el factor armamentístico, sino también el factor psicológico, lo que conduce al desarrollo de operaciones militares psicológicas, utilizadas como método y medio, y que también aprovechan los avances en IA para la aproximación y el desarrollo operacional.

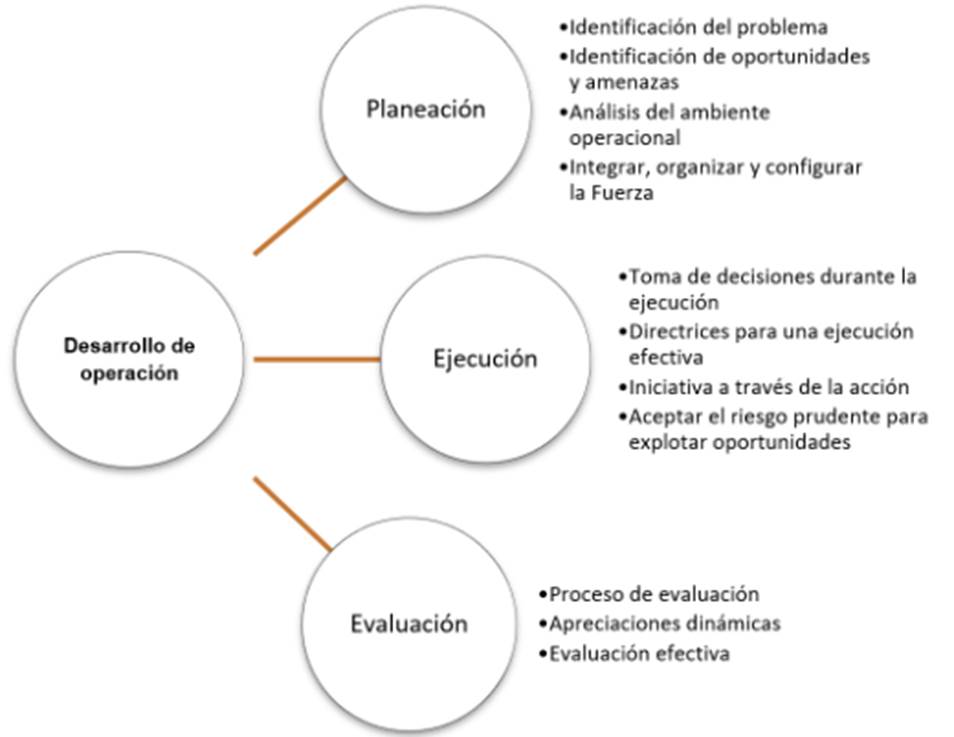

Para comprender cómo la IA puede aportar en las operaciones psicológicas militares en el teatro de operaciones, es importante conocer cómo se establece el desarrollo de una próxima operación, que, según Arancibia (2017):

Es cómo el comandante visualiza que la operación transformará las condiciones existentes al estado final deseado al término de la operación. Al identificar los elementos del medioambiente operacional que deben cambiar para alcanzar el estado final deseado, es más sencillo poder establecer qué acciones son requeridas para lograr estos cambios, lo que a su vez facilita comprender, visualizar y dirigir los esfuerzos hacia cómo resolver el problema; el producto de este proceso permite facilitar el inicio de la fase de análisis de la misión en el proceso de planificación operacional. (p. 52)

Con base en lo expuesto, se deben tener en cuenta diferentes factores en la construcción del desarrollo operacional distinguiendo actividades de planeación, de ejecución y de evaluación, cada una con diferentes subfactores (Figura 4).

Fuente: Elaboración propia con base en Arancibia (2017) y EJC (2017)

Figura 4. Síntesis de desarrollo de operación.

En el desarrollo operacional, la IA bajo supervisión humana como método juega un papel importante en los tres grandes factores. Si bien no puede tomar decisiones, la IA sí puede aconsejar o replantear una estrategia considerando todos los subfactores, a excepción de los relacionados con la iniciativa a través de la acción y la aceptación de un riesgo prudente para explotar oportunidades. En cuanto al primer subfactor, la iniciativa, entendida como las capacidades de imaginar e idear, se trata de una característica con la que no cuenta la IA; en cuanto al segundo, aceptar el riesgo prudente, la jurisprudencia actual no concibe a una máquina como un sujeto de derecho.

Una vez planteados los factores del desarrollo operacional e identificados cuáles no se podrían involucrar en la IA, el desarrollo operacional permite usar diferentes estrategias armadas, como las operaciones militares psicológicas.

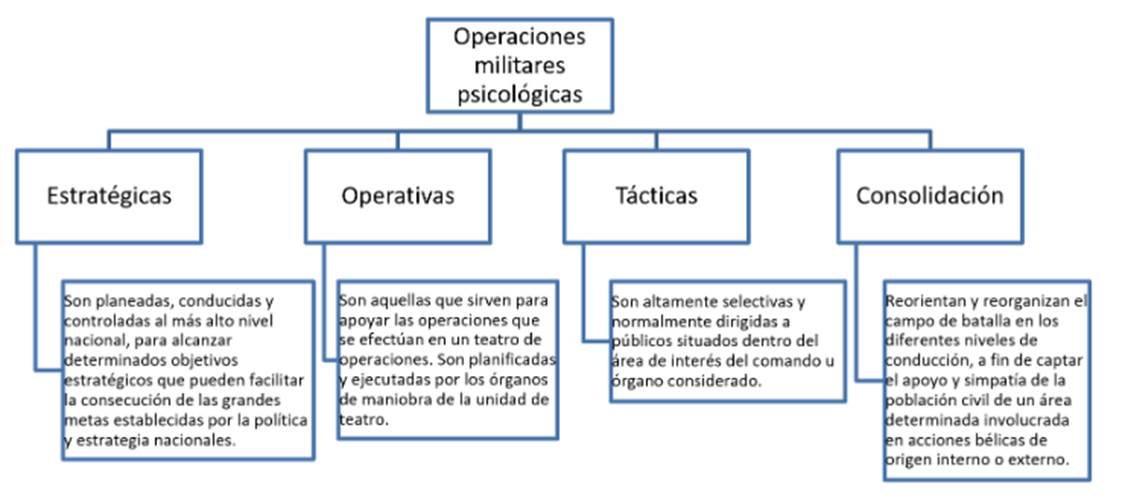

Operaciones militares psicológicas

Las operaciones militares psicológicas son definidas como:

El esfuerzo que se realiza para hacer uso y explotación planificada y sistemática de la mente de un grupo-objetivo determinado, a través de la comunicación de ideas orientadas a influir en las emociones, actitud, comportamiento y opiniones de los integrantes de dicho grupo [...] de una manera que sea favorable y conveniente para apoyar el logro de los objetivos propios. (Olmos, como se citó en Fort, 2012, p. 259)

Estas operaciones son ejecutadas, según Fort (2012), “para llevar información seleccionada y direccionada a un grupo-objetivo definido, tales como son: gobiernos, organizaciones, grupos e individuos, cuya finalidad es la de influir en sus emociones, actitudes, motivos, percepciones, razonamientos y, principalmente, en su conducta” (p. 259).

Es importante entender que la efectividad de las operaciones militares psicológicas dentro del desarrollo operacional no se evidencia en el corto plazo, como sí lo hacen las operaciones militares bélicas. No obstante, tienden a ser más efectivas, ya que buscan en su consolidación captar el apoyo y la simpatía de la población civil, lo cual puede reducir significativamente las represalias por parte del adversario debido al desacuerdo de la población civil con los líderes. Por ello, entre las ventajas de las operaciones psicológicas militares están las siguientes:

[Son] eficaces para (i) debilitar la voluntad de las audiencias objetivo (potencialmente) adversarias, (ii) reforzar el compromiso de aquellas amigas y (iii) obtener el apoyo de las indecisas. A nivel estratégico, las operaciones psicológicas ofrecen adicionalmente una mejor comprensión del entorno operativo y ayudan a definir objetivos políticos razonables, basados en una comprensión sólida de las amenazas. Tienen la capacidad para transformar éxitos militares en victorias políticas a través de, por ejemplo, tratados de paz y comerciales en todos los niveles, las operaciones psicológicas ofrecen resultados en el ámbito de la contrapropaganda, aunque a menudo esta se limita a la Protección de la Fuerza. (Prats & Guillaume, 2019, pp. 9-10)

Tradicionalmente se entiende por reducir la polaridad en términos militares un logro que se obtiene exclusivamente mediante el uso de las armas en confrontación directa o indirecta, o en menor medida mediante la disuasión como estrategia (a través de juegos de guerra o desfiles militares, donde se exhiben las armas que se utilizarían en un momento de conflicto). Pero la polaridad también se puede reducir de forma discreta mediante operaciones militares psicológicas. Así, sin una confrontación armada directa, estas operaciones pueden llegar a tener un impacto importante en el escalamiento o desescalamiento del conflicto, lo que limita significativamente gastos de munición, a la vez que reduce el número de muertos y heridos.

El impacto de estas operaciones radica en disuadir a los adversarios de realizar acciones bélicas contra su oponente, influyendo no solo en la población militar, sino también en la población civil. Esto puede contribuir a desescalar el conflicto por parte del adversario, de acuerdo con lo descrito por la teoría de la disuasión durante la Guerra Fría, según la cual se evita un ataque entre dos actores enfrentados a causa del temor a las represalias que podría conllevar (Chinchilla, 2018). Teniendo en cuenta ello, el principal objetivo de las operaciones militares psicológicas, según el EJC (2009), es “disminuir la moral y eficiencia de combate del enemigo” (p. 12)

Esto permite contemplar los factores que deben incidir en el desarrollo operacional de las operaciones militares psicológicas, donde la planeación es lo más importante, ya que, además de identificar el problema, permite proponer una estrategia según su nivel de empleo (Figura 5).

Fuente: Elaboración propia con base en Fuerzas Armadas del Ecuador (s. f.).

Figura 5. Nivel de empleo de operaciones militares psicológicas.

Al contemplar el nivel de empleo de las operaciones psicológicas militares, se evidencian los mismos factores que tiene una operación militar bélica, donde la IA, ya sea con autonomía bajo control humano o autonomía total, puede usarse sin ocasionar ninguna violación al derecho internacional ni al derecho internacional humanitario.

Operaciones militares psicológicas y guerras híbridas

Las operaciones militares psicológicas cobran mayor relevancia en la actualidad, cuando se habla de guerras híbridas para explicar los nuevos conflictos armados internacionales o no internacionales. Polyakova y Boulegue (2018) definen la guerra híbrida como “una guerra de espectro completo, que despliega una combinación de medios convencionales y no convencionales destinados a afectar sobre el terreno los cambios en el objetivo mientras busca evitar la confrontación militar directa” (p. 2; traducción propia). Otra definición es la de la Presidencia de Gobierno de España (2017):

Acciones combinadas que pueden incluir, junto al uso de métodos militares tradicionales, ciberataques, operaciones de manipulación de la información, o elementos de presión económica, que se han manifestado especialmente en procesos electorales. La finalidad última que se persigue es la desestabilización, el fomento de movimientos subversivos y la polarización de la opinión pública. (p. 18)

Como puede verse, los conflictos híbridos “pretenden, en última instancia, dificultar, retrasar e impedir la oportuna toma de decisiones y socavar la capacidad de una nación o de una alianza para responder a dicha amenaza de forma rápida, firme y eficaz” (Marín, 2020, p. 74). En este contexto, las operaciones militares psicológicas que utilizan IA son métodos militares no convencionales ajustados a la definición de los conflictos híbridos, como operaciones de manipulación mediática para ejercer diferentes tipos de presión o disuasión que tengan un impacto importante en la toma de decisiones, no solo en el gobierno de un Estado, sino también en su población.

Esto ha llevado a que las políticas de defensa de algunos países consideren este tipo de conflictos híbridos como un desafío que amenaza sus intereses nacionales. La Secretaría de Estado de los Estados Unidos los cataloga en cuatro tipos:

Tradicionales: aquellos planteados por Estados que, en forma de conflictos militares, emplean capacidades y fuerzas militares reconocidas como tales. Irregulares: proceden de aquellos grupos y/o Estados que utilizan métodos “no convencionales” para contrarrestar las ventajas tradicionales de los adversarios más fuertes. Catastróficos: incluyen la obtención, posesión y empleo de armas de destrucción masiva o de métodos que produzcan efectos similares a dichas armas. Disruptivos: pueden proceder de adversarios que desarrollan y utilizan tecnologías novedosas. (como se citó en Hoffman, 2007, pp. 25-26; traducción propia)

Además, también se afirma que, en el futuro, los oponentes más capaces pueden tratar de combinar una capacidad verdaderamente disruptiva con formas de guerra tradicional, irregular o catastrófica. En este orden de ideas, el uso de IA en operaciones militares psicológicas puede ser una amenaza relevante con capacidad de escalar el conflicto mediante el aprovechamiento de otros avances tecnológicos, la accesibilidad a través de diferentes tecnologías de información y comunicación, y la facilidad de compartir mensajes en diferentes medios de comunicación, ya sea por medios tradicionales como la televisión y la radio, o por medios no tradicionales como las redes sociales.

Metodología

Además de realizar un análisis de fuentes primarias y secundarias, que incluyeron artículos científicos, manuales fundamentales de diferentes ejércitos, informes de organismos internacionales y de prospectiva en seguridad y defensa sobre uso de la IA en la conducción de los conflictos armados, también se aplicó el método Delphi. Este método:

Permite estructurar un proceso comunicativo de diversos expertos organizados en grupo-panel con miras a aportar luz en torno a un problema de investigación. Su desarrollo tiene que garantizar el anonimato, establecer un proceso iterativo a través del feedback y se orienta hacia una medida estadística de la respuesta de grupo. (López Gómez, 2018, p. 21)

Se ajustó el método Delphi a las necesidades de la investigación, no como una metodología prospectiva, sino perspectiva, de modo que se dio el mismo peso a la población de expertos, que contaban con los siguientes perfiles: oficiales del Ejército Nacional de Colombia, de las armas de Infantería, Caballería, Inteligencia y Comunicaciones; oficiales en uso de buen retiro del Ejército, en las mismas armas; oficiales de la Fuerza Área Colombiana, y abogados con Maestría en Derechos Humanos y Derecho Internacional Humanitario.

Se establecieron seis hipótesis para el proceso de investigación (para efectos prácticos, la primera y segunda hipótesis deben entenderse como una sinergia entre la IA y la robótica):

Hipótesis 1. Fortalecimiento de la IA donde la máquina decide atacar, pero antes solicita la aprobación del humano. (IAAH)

Hipótesis 2. Fortalecimiento de la IA donde la máquina actúa y decide por sí misma. (IAA)

Hipótesis 3. Fortalecimiento de la IA en las operaciones militares psicológicas. (IAOMP)

Hipótesis 4. El derecho internacional y la ética no permiten el uso de la IA en la conducción de la guerra (ni como medio ni como método) (DI DIH)

Hipótesis 5. La IA se utiliza como un factor disuasivo para persuadir al contrincante y anular su polaridad. (IAPD)

Hipótesis 6. La IA se utiliza como un método y un medio disruptivo en los conflictos híbridos. (IACH)

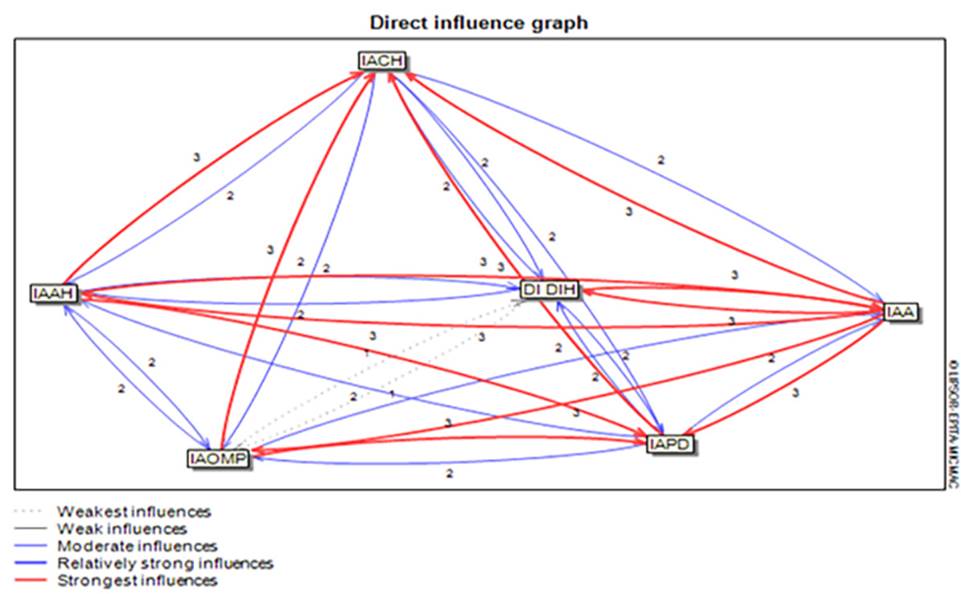

Estas hipótesis se analizaron a través de la identificación de variables de análisis estructurales, mediante cálculos de matrices directas a través del método MIC MAC.

Resultados

La Figura 6 hace referencia al nivel de influencia y dependencia de las variables analizadas, catalogándolas en el cuadrante superior izquierdo, de alta influencia y baja dependencia; en el superior derecho, de alta influencia y dependencia; en el inferior izquierdo, de baja influencia y dependencia; y en el inferior derecho, de baja influencia y alta dependencia.

La hipótesis del fortalecimiento de la IA donde la máquina decide atacar, pero antes solicita la aprobación del humano (IAAH), es en la actualidad la más influyente, debido a que es la más utilizada en el teatro de operaciones, por lo cual se convierte en el punto de partida. Por ende, influye directamente en las hipótesis del fortalecimiento de la IA donde la máquina actúa y decide por sí misma (IAA); del fortalecimiento de la IA en operaciones militares psicológicas (IAOMP); de la IA usada como factor disuasivo para persuadir al contrincante y anular su polaridad (IAPD), y de la IA utilizada como un método y un medio disruptivo en los conflictos híbridos (IACH). Esto se explica por los resultados demostrados en las operaciones militares desde el conflicto armado internacional de Irak en 2003.

Respecto a la hipótesis del fortalecimiento de la IA en las operaciones militares psicológicas (IAOMP), influenciada, como se ha dicho, por la hipótesis IAAH, no cuenta con influencia media, lo que se explica porque este tipo de operaciones, por lo general, son de consolidación y proyectadas a mediano y largo plazo.

La hipótesis de que el derecho internacional y la ética no permiten usar IA en la conducción de la guerra (ni como medio ni como método) (DI DIH) es la que refleja una menor influencia y dependencia. La menor influencia se debe a que el uso de IA en los conflictos armados no está prohibido como medio o método, como sí lo están el uso de armas nucleares, las armas de destrucción masiva químicas o nucleares y todo tipo de minas. Por su parte, la menor dependencia se debe a que los entes encargados de las acciones bélicas legítimas del Estado tiene una participación mínima o nula (dependiendo del Estado) en la toma de decisiones relacionadas con la prohibición de métodos y medios en un conflicto armado.

A diferencia de la anterior, la hipótesis del fortalecimiento de la IA donde la máquina actúa y decide por sí misma (IAA) es la que más influencia y dependencia tiene. Por un lado, es la influencia disuasiva más importante en un conflicto armado. Por otro lado, depende de dos factores importantes para su uso en el teatro de operaciones: el desarrollo tecnológico, no solo en cuanto a los algoritmos de toma de decisiones, sino también en cuanto a software de seguridad que evite hackeos o ataques remotos; y el nivel de preparación de las organizaciones internacionales que aportan al derecho internacional frente a la prohibición del uso de esta hipótesis, donde la IA de forma autónoma procede a recolectar, analizar y evaluar la situación para finalmente tomar o no la decisión de atacar por sí misma.

En cuanto a la hipótesis del uso de la IA como factor disuasivo para persuadir al contrincante y anular su polaridad (IAPD), si bien no tiene una influencia fuerte ante las otras hipótesis, sí cuenta con una alta dependencia de estas, debido a que el desarrollo y uso de la IA fortalece la capacidad de disuasión, no solo desde el punto de vista operacional físico, sino desde el psicológico.

En consecuencia con lo expuesto, la hipótesis de la IA utilizada como un método y un medio disruptivo en los conflictos híbridos (IACH) es la de menor influencia, debido a que no influye en ninguna de las hipótesis anteriores, pero sí depende de todas, ya que estas fortalecen de forma directa las estrategias y tácticas utilizadas en este tipo de conflictos (Figura 7).

Respecto a las influencias más fuertes, encontramos que, en las hipótesis de IAAH, IAA y IAOMP, la IA se utiliza como un factor disuasivo (IAPD); asimismo, influyen directamente en la hipótesis de la IA como método y medio en los conflictos híbridos (IACH), dado que son un aporte que fortalece y aumenta la polaridad de quienes las utilizan en este tipo de conflictos.

Adicionalmente, la hipótesis de la IA como factor disuasivo (IAPD) es la segunda que recibe más influencias de las demás hipótesis, debido a que en estas, al igual que la anterior, se utilizan los medios de conducción de conflictos como estrategias y tácticas para el desarrollo de las operaciones.

Cabe resaltar la influencia que tiene la hipótesis IAA sobre la hipótesis del derecho internacional y la ética DI DIH y viceversa. Por consiguiente, el derecho internacional no hará una prohibición o regulación de las armas autónomas hasta que estas no sean utilizadas en el teatro de operaciones y las armas autónomas desarrollarán medios y métodos que cumplan las prohibiciones y regulaciones que disponga el derecho internacional.

Conclusiones

De acuerdo con el precepto de Beaufre antes citado, para comprender las transformaciones de la guerra es vital contar con una estrategia que vaya más allá de la capacidad de análisis y reacción humana, debido a la cantidad y velocidad de datos que se necesitan analizar. Esto es más esencial hoy en día por el desarrollo de las guerras híbridas, donde las estrategias de conducción de la guerra han tenido que modificarse según las nuevas tecnologías desarrolladas y utilizadas por los adversarios, y los ejércitos y sus armas deben cambiar según las nuevas tendencias y dinámicas de los conflictos tanto nacionales como internacionales.

Esto ha hecho que los ejércitos de los países desarrollados y algunos en vía de desarrollo vayan a la vanguardia en el uso de la IA. También lleva a repensar el fin de los soldados en un conflicto, bien como un factor disuasivo, como en las guerras de primera a cuarta generación, o como simples recolectores de información para fortalecer la minería de datos, que serán analizados por una IA que brinde la mejor estrategia a seguir, teniendo en cuenta diferentes variables, no solo la variable ofensiva armada, sino también las variables PEMSITIM o de consolidación, como en las operaciones militares psicológicas.

El uso de la IA como fin o como medio también lleva a repensar el uso de los soldados y la especialización de las armas tradicionales de los ejércitos, como la artillería, la infantería, la caballería, la ingeniería (civil por lo general), entre otras. Es necesario definir si se deben seguir fortaleciendo o si deben desaparecer, ya que, por ejemplo, las capacidades de los soldados serían incompatibles con las armas letales autónomas. También se deben crear nuevas de especializaciones de las armas, como la ingeniería de sistemas, la ingeniería mecatrónica o la estadística en los ejércitos.

Pero la creación de estas nuevas especialidades debe venir de la mano con análisis prospectivos, pues si bien se debe tener en cuenta el pasado, estas transformaciones no deben basarse solo en lo que fue la conducción de conflictos armados de antaño, ya que para los conflictos actuales y futuros se han creado nuevos métodos y medios en la conducción de un conflicto armado que eran inimaginables hace veinte años.

Para esto, el Estado Mayor de las Fuerzas Armadas debe incluir en sus ejercicios a nivel operativo, táctico y estratégico herramientas metodológicas disruptivas, incluso metodologías de creación de ideas y prototipado, que aporten al desarrollo de métodos y medios para conducir conflictos armados a partir de estudios de caso, retos y ejercicios de cocreación, hackathones, design thinking, entre otras. Pero para ello es importante romper parámetros y moldes tanto de la mentalidad como de los ejercicios tradicionalistas en las Fuerzas Armadas.

Por otra parte, las especializaciones de armas de nivel tecnológico ayudarían a crear y fortalecer la implementación de la IA como medio y como método para buscar una forma más eficiente de conducción de la guerra dentro de conflictos híbridos, ya sea como factor disuasivo o como factor de confrontación directa.

Paralelamente a la modernización de los métodos y medios de guerra, también se debe pensar en el fortalecimiento del derecho internacional en cuanto a la prohibición o las limitaciones de uso de la IA como medio en los sistemas de armamento autónomo y en los conflictos armados. No se debe esperar a que estos medios entren en uso para justificar por qué no deben utilizarse y de quién debe ser la responsabilidad jurídica frente a su operación y sus daños colaterales. Es importante el discurso moral y ético que se está generando en la actualidad, pero no va a la par del pensamiento y el crecimiento del desarrollo armamentístico actual.

De este modo, el avance tecnológico da paso a la modernización de los conflictos. En este sentido, el uso de la IA como método y como medio cambiará la forma de conducir la guerra y su estudio desde el punto de vista polemológico, lo que obliga a replantear un sistema de derecho internacional que regule el uso de las tecnologías emergentes. Por otra parte, es importante realizar estudios prospectivos de las capacidades con las que debe contar el personal integrante de las Fuerzas Armadas, ya que no serán un actor primario en el ambiente operacional en los conflictos armados del futuro ni un actor determinante en el teatro de operaciones, lo que también se traduce en una posible reducción en la incorporación de miembros a las fuerzas, dado que las necesidades del servicio serán otras.

Por último, es importante que los centros de investigación militar se fortalezcan en infraestructura y personal científicamente calificado, para afrontar los retos que traen los conflictos armados del futuro. El objeto de estudio ahora debe ir más allá de los análisis de los conflictos, las lecciones aprendidas y la conducción de operaciones militares tradicionales, y deben convertirse en actores innovadores, que generen, gracias a la experiencia y experticia de los soldados, nuevos desarrollos tecnológicos, sociojurídicos y militares.