Serviços Personalizados

Journal

Artigo

Indicadores

-

Citado por SciELO

Citado por SciELO -

Acessos

Acessos

Links relacionados

-

Citado por Google

Citado por Google -

Similares em

SciELO

Similares em

SciELO -

Similares em Google

Similares em Google

Compartilhar

Acta Agronómica

versão impressa ISSN 0120-2812

Acta Agron. vol.64 no.3 Palmira jul./set. 2015

https://doi.org/10.15446/acag.v64n3.42657

http://dx.doi.org/10.15446/acag.v64n3.42657

Procesamiento de imágenes para reconocimiento de daños causados por plagas en el cultivo de Begonia semperflorens Link & Otto (flor de azúcar)

Methodology for pest damage recognition in Begonia semperflorens link & Otto (sugar flower) crop through image processing

Camilo Andrés Cáceres Flórez*, Darío Amaya Hurtado, Olga Lucía Ramos Sandoval

Facultad de Ingeniería. Grupo GAV. Universidad Militar Nueva Granada, Bogotá, Colombia. *Autor para correspondencia: u1801466@unimilitar.edu.co

Rec.: 17.03.2014 Acep.: 06.06.2014

Resumen

En este trabajo se presentan los resultados obtenidos en el reconocimiento de plagas utilizando la visión de máquina por computador como elemento de diagnóstico. La captura de las imágenes se realizó por medio de un agente robótico aéreo (drone) equipado con una cámara, lo que permitió capturar las imágenes del estado de las hojas de un cultivo de la planta conocida como ‘flor de azúcar’ (Begonia semperflorens). Estas imágenes fueron procesadas utilizando técnicas de visión de máquina con el fin de identificar el posible ataque de plagas en el cultivo. Las técnicas utilizadas corresponden a filtros morfológicos, difuminado gaussiano y filtrado HSL. Como resultado principal de este trabajo se detectaron perforaciones de hojas ocasionadas por el ataque de plagas, específicamente babosas, caracoles, arañas rojas y minadoras.

Palabras claves: Procesamiento de imágenes, detección de plagas, monitoreo de cultivos, filtros morfológicos, difuminado gaussiano.

Abstract

Nowadays, an important element in farming, is the use of technology, based on the analysis of the different factors that affect the succesfull development of the crops. The results are presented in the recognition of pests, in this work a computer machine vision, as a diagnostic was used. The images capturing were doing with a robotic air agent, equipped with a camera, capturing images of the state of a crop of a plant called ‘Flor de azúcar’ (Begonia semperflorens). These images are processed using machine vision techniques to identify the possible attack of pests on the crop. The techniques used are morphological filters, Gaussian blur filter and HSL. The main result of this work was accomplished, perform the detection of the perforation of the leaves as a result of pest attack, specifically slugs, snails, spider mites and leafminers.

Key words: Image processing, pest detection, farming monitoring, morphological filters, Gaussian Blur.

Introducción

El procesamiento digital de imágenes es una herramienta ampliamente utilizada en la automatización de procesos industriales, debido a que presenta confiabilidad, eficacia y rapidez en el procesamiento. La industria agrícola ha comenzado a utilizar este tipo de tecnología para monitorear aspectos relevantes de los cultivos (Yan et al., 2009; Noda et al., 2006; y Husin et al., 2012). En el presente trabajo las observaciones se hicieron en el cultivo Begonia semperflorens conocida como ‘flor de azúcar’, una planta de carácter ornamental, que típicamente se cultiva en zonas de clima cálido y húmedo.

Según Fonterlz (2013) y Grbíc (2011) esta planta es atacada por babosas, caracoles, arañas rojas y minadoras de hojas. El daño causado puede ser detectado visualmente, debido a los orificios que dejan en las hojas de las plantas, razón por la cual es posible utilizar la visión de máquina para verificar el nivel de daño. Específicamente, para el procesamiento digital de las imágenes pueden ser utilizados filtros de segmentación de imagen, entre ellos los filtros morfológicos. Estos filtros se basan en las formas presentes en las imágenes y tienden a simplificar los datos de éstas, preservando sus formas características esenciales y eliminando las que sean irrelevantes (Barata y Pina, 2003; Najman et al., 2010). La técnica de dilatación es una trasformación morfológica la cual utiliza un vector de adición para la combinación de dos conjuntos de elementos (Shih, 2009; Najman el al. 2010).

El difuminado gaussiano es otro algoritmo utilizado, el cual tiene como objetivo difuminar o suavizar una imagen con una función Gaussiana. Se usa generalmente para reducir el ruido digital y los detalles en las imágenes. Muchas veces esta técnica se utiliza como paso inicial en el procesamiento de imágenes obtenidas por visión de máquina, ya que permite eliminar el ruido digital evitando perder información importante de la imagen (Nixon y Aguado, 2002; Gedraite y Hadad, 2011).

Un método adicional es el filtro de imágenes Hue Saturación Luminace (HSL). Este se basa en una representación del color en coordenadas polares, lo cual es más natural que la representación RGB, ya que se acerca en gran medida a la percepción fisiológica del color que tiene el ojo humano (Etxeberria, 2010). Este modelo define el espacio de color en tres características: tono (Hue), saturación (Saturation) y luminosidad (Luminance). La principal ventaja de un filtrado HSL en el procesamiento de una imagen es la robustez que presenta ante los cambios de iluminación (Jin-liang et al. 2008; Wesolkowski, 1999).

En el procesamiento de imágenes con fines de reconocimiento de plagas y morfología de las plantas, existen trabajos como los de Yan et al (2009) quienes proponen un nuevo método para la detección de plagas y el suministro automático de plaguicidas en cultivos en invernaderos. La diferencia de color entre hojas de plantas afectadas y sanas es determinada por medio de segmentación de imagen para identificar posibles plagas. Los resultados son utilizados por un robot que recorre el invernadero suministrando plaguicida donde la identificación de plagas lo indique. Este método se basa en triangulación y visión binocular que permite calcular la posición 3D de la planta. Los trabajos de Noda et al. (2006) tienen como propósito controlar dispositivos periféricos, con base en las características extraídas de las imágenes adquiridas por un servidor de campo utilizado en aplicaciones industriales; estos investigadores pudieron detectar el grado de marchitez de la planta usando métodos de procesamiento de imagen. Husin et al. (2012) propusieron la detección temprana de plagas que afectan la planta de ají a través de la inspección de las características de las hojas o el tallo, utilizando procesamiento de imágenes con el modelo de color RGB, que permite extraer las imágenes capturadas y las secciones correspondientes a las hojas de ají para identificar, por medio de agrupación de colores, aquellas hojas que presentan signos de enfermedad o son atacadas por plagas.

Este trabajo tuvo como objetivo la implementación de un sistema para el reconocimiento de plagas en el cultivo de la planta ‘flor de azúcar’ (Begonia semperflorens) a través del procesamiento de imágenes. Esta planta fue elegida principalmente por la facilidad de adquirir imágenes y para recorrer el cultivo con un robot tipo Drone. El aporte de este trabajo reside en el análisis cuantitativo del daño que producen las plagas en una planta y el uso de un robot aéreo no tripulado para la captura de fotografías.

Materiales y métodos

Localización del cultivo y toma de fotografías

Para el desarrollo de este trabajo inicialmente se realizó una captura de imágenes en la primera semana de junio de 2013 en la ciudad de Bogotá, más exactamente en las coordenadas 4° 40’ 59.07” N, 74° 2’ 30.94” O, en un pequeño cultivo de flores ornamentales de B. semperflorens. La captura de las fotos se hizo entre 9 y 11 a.m., con una temperatura aproximada de 17.7 °C, en un día soleado y sin presencia de nubosidad. Las fotografías fueron tomadas utilizando un robot aéreo (RA) de tipo ‘Quadcopter’, de referencia AR Drone 2.0 (Desarrollado por Parrot, modelo 2.0) el cual posee una cámara frontal con características de alta definición (HD), de 720 pixeles y 30 fotogramas por segundo. Además, de la cámara frontal, el RA cuenta con una cámara inferior la cual tiene una resolución de 640 x 480 pixeles que fue utilizada para capturar fotos complementarias del cultivo.

Para el trabajo fueron tomadas 200 fotografías en distintas posiciones. Con la cámara frontal fueron capturadas 100 fotografías y con la cámara inferior un número similar. Se capturaron 10 fotografías cada 5 cm, iniciando en 5 cm y terminando en 55 cm. Las primeras 100 fotografías fueron tomadas con la cámara inferior de manera perpendicular al suelo. Las 100 fotografías tomadas con la cámara frontal tienen un ángulo de inclinación de 30° entre el suelo y el RA.

Toma y procesamiento de imágenes

Las imágenes fueron sometidas a un procesamiento ‘off-line’, en un software desarrollado en la plataforma Visual Express C#2010, utilizando la librería AForge.net de código abierto, debido a que dicha librería facilita en el tratamiento de imágenes y técnicas de inteligencia artificial. El software desarrollado es totalmente automatizado, toma todas las fotos del RA y las analiza de manera serial. Los resultados del análisis se pueden ver en el software mientras se analiza cada imagen, además guarda un registro en tablas de datos de Excel con el nombre de la fotografía analizada y el respectivo resultado del análisis.

El procedimiento consistió en aplicar diferentes tipos de filtros a las imágenes obtenidas. La aplicación de dichos filtros se hizo con el fin de observar las partes deterioradas de la hoja y cuantificarlas de manera computacional según el porcentaje de daño. En la Figura 1 aparecen una imagen del AR Drone 2.0 de Parrot y una foto tomada por el RA a una distancia aproximada de 30 cm de la planta.

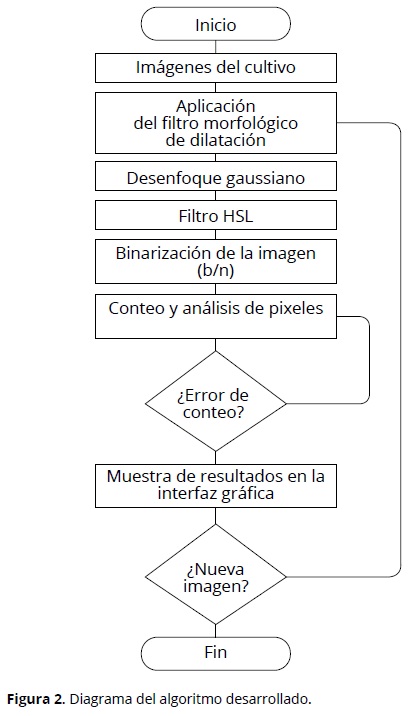

El requerimiento básico del algoritmo es el reconocimiento de patrones que se reflejan en agujeros de las hojas de la planta. Debido al pequeño tamaño de estos agujeros, se buscó, inicialmente, utilizar algún tipo de morfología matemática para resaltar dichas características. Posteriormente, se realizó una suavización de la imagen para disminuir el ruido y aumentar la precisión del algoritmo. Además, se aplicó un filtro HSL, que es muy robusto en tareas de separación de color, y se hizo una umbralización; por último se analizó la ubicación de los agujeros respecto a la hoja por medio de arreglos binarios multidimensionales. En la Figura 2 se incluye un diagrama del algoritmo desarrollado.

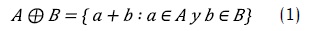

Aplicación del filtro morfológico de dilatación

Inicialmente se buscó un algoritmo que permitiera resaltar las características de los pequeños agujeros que se pretenden reconocer en la imagen. Este objetivo se puede alcanzar a través de un tipo de morfología matemática denominada ‘dilatación’, la cual se describe como un crecimiento de pixeles. Esto permite el aumento de un pixel alrededor de la circunferencia de cada región y de esta forma poder incrementar las dimensiones. Este mismo método fue utilizado en los trabajos de Barata y Pina (2003). La función utilizada está predeterminada en la librería AForge.net y la dilatación está dada por las Ecuaciones 1 y 2. Lo que significa que el conjunto de todos los posibles vectores es la suma de pares de elementos, uno perteneciente a A y el otro a B.

donde, A y B son estructuras geométricas de espacio continuo o discreto.

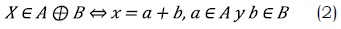

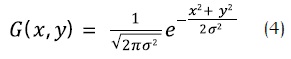

Aplicación de desenfoque gaussiano

Después de la aplicación de la dilatación se observó que en la imagen permanecía algún tipo de ruido y algún otro puede ser generado por el filtro morfológico (Hendriks et al., 2013). Esto hace necesario suavizar la imagen a través del proceso de filtrado: En este caso se utilizó el ‘Gaussian Blur’ o desenfoque Gausianno, el cual se encuentra asociado con la ecuación 3 siguiente, la cual corresponde a una función gaussiana que representa una distribución normal en una dimensión, aunque en este caso específico se requiere una distribución normal en dos dimensiones que es el producto de dos ecuaciones gaussianas unidimensionales (Sun, 2012). En la ecuación 4 se muestra el resultado.

La ecuación 4, que correspondiente al Gaussian blur en dos dimensiones, depende de un valor sigma (), que es la desviación estándar de la distribución gussiana. En el presente caso, después de analizar distintos valores, tomó el valor 1.5 para disminuir el ruido de la imagen (Perkins, 2009). Además, los valores y y x hacen referencia a la posición de los pixeles analizados. En la Figura 3 se muestra la aplicación del Gaussian Blur a la imagen resultante después de aplicar la dilatación.

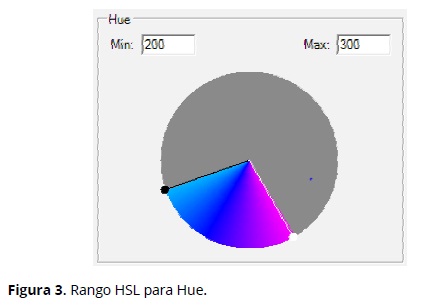

Aplicación del filtro HSL

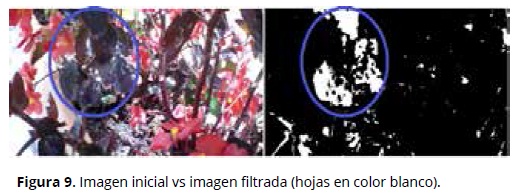

Con la imagen suavizada de la figura 4 se realiza el filtrado, con el fin de obtener únicamente las hojas de la planta, para posteriormente, calcular el porcentaje de la hoja que se encuentra en mal estado. Se utiliza un filtro HSL, debido que es muy robusto y más flexible que los filtros RGB, además de filtra los colores sin tantos problemas de luz o brillo, como presenta el filtro RGB (Bovik, 2005). Para el filtro se utilizan valores determinados por el promedio de valores de las hojas analizadas. Los valores utilizados de saturación se tomaron entre 0.1 y 0.35, la luminosidad entre 0.15 y 0.4 y el tono entre 200 y 300, como se muestra en la Figura 9 más adelante resultante de aplicar el filtro HSL a la Figura 5.

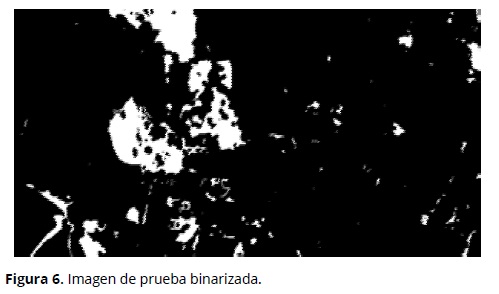

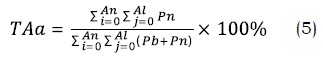

Aplicación de binarización, toma y análisis de datos

Finalmente se aplicó una binarización (Bovik, 2005) con el valor más bajo de umbral, para obtener una imagen blanco y negro (Figura 6) y procesarla en arreglos multidimensionales.

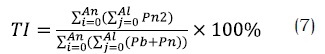

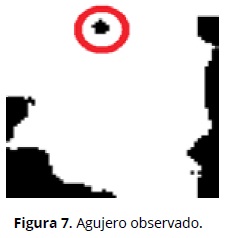

A continuación, se procede a pasar la imagen a un arreglo multidimensional (matriz), con valores de 1 (blanco) y 0 (negro), con el fin de realzar una búsqueda de las zonas blancas (las hojas) en las cuales se buscan pixeles negros, aislados o contiguos. Los pixeles negros aislados en un sector blanco se asocian con un agujero debido a una plaga. Si el sector negro no está aislado se asocia con una probabilidad de agujero ya que puede ser la forma de la hoja, una sombra o un potencial agujero, lo cual es una incertidumbre y por tanto se indica el valor probabilidad de agujero.

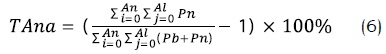

Una vez se recorre toda la imagen y se determina qué área de las zonas blancas, en pixeles, corresponde al total de las hojas presentes en la imagen con el objeto de obtener el área de la hoja (en blanco) sin perforaciones. Posteriormente, se obtiene el área de pixeles negros, dentro de las zonas blancas, que tengan mínimo cuatro pixeles fronterizos blancos. Se calcula la media aritmética del total de pixeles negros en el área blanca según las especificaciones, la cual representa el porcentaje de la hoja con agujeros y restando la misma de 100%, se obtiene el porcentaje de la hoja libre de agujeros. Representaciones que se pueden ver en las ecuaciones 5 y 6, respectivamente.

donde, TAa es el porcentaje del total del área afectada, TAan es el porcentaje total del área no afectada, An es el ancho de la imagen, Al es el alto de la imagen, Pn es el número de pixeles negros con mínimo cuatro vecinos blancos en un área de 3 x 3 pixeles alrededor, Pb es el número pixeles blancos, i y j son números que hacen parte del recorrido de la imagen por el arreglo multidimensional a que corresponden, a es el número de pixeles que posee la imagen. Estas ecuaciones 5 y 6 son generales para análisis de cualquier tamaño de imagen.

Por otro lado, el porcentaje de hoja probablemente infectado por plaga se toma de la razón entre pixeles negros con tres o cuatro vecinos blancos, debido a que no se posible determinar si los bordes de la hoja se encuentran en buenas condiciones, por tanto, se deja esta incertidumbre que no es factible de calcular por medio de los algoritmos escogidos. Se puede ver el modelo aplicado en la ecuación 7.

donde, TI es el porcentaje de la incertidumbre total sobre el área de las hojas, Pn2 es el número de pixeles negros con tres o cuatro vecinos blancos en un área de 3 x 3 pixeles alrededor; las demás variables son las mismas de las ecuaciones 5 y 6.

La Figura 7 corresponde a un ejemplo de lo que sería una hoja (sección blanca) con un agujero (parte negra, encerrada por un círculo rojo) que muestra gráficamente lo que se quiere expresar en las ecuaciones 5 y 6. La Figura 8 muestra un ejemplo de lo que sería una hoja (sección blanca) con probabilidad de agujero (parte negra, encerrada por un círculo rojo), que muestra gráficamente lo que se quiere expresar en la ecuación 7. Finalmente, La Figura 9 muestra un ejemplo de cómo se lograron separar las hojas de toda la imagen (en blanco), sin perder la información de los agujeros que tiene la hoja.

Los umbrales de los algoritmos fueron hallados por medio de una red neuronal multicapa supervisada, la cual se usó para hallar los parámetros óptimos para los diferentes algoritmos utilizados. El uso de dicha red después de su comprobación con el 60% de las fotografías tomadas, fue altamente limitado por el tiempo de procesamiento que requirió analizar cada imagen. El análisis de precisión se basó en comparar los resultados óptimos hallados por la red neuronal, utilizados en el presente software, y los parámetros hallados para cada imagen en particular, los cuales son más precisos para cada imagen individual pero no para el grupo total de imágenes. La media de error entre los parámetros hallados de la red neuronal y los individuales de cada foto fue de 9.8%, por lo tanto, el porcentaje de acierto fue de 90.2%

Resultados y discusión

El principal problema en el desarrollo del proyecto fue la determinación de los umbrales correctos para cada algoritmo utilizado, la solución consistió en optimizar los parámetros de los algoritmos por medio de una red neuronal multicapa supervisada. Dicha red se utilizó como base para el análisis del software, su confiabilidad y los análisis correspondientes aparecen en las Tablas 1 y 2. El uso de dicha red, después de su comprobación con el 60% de las fotografías tomadas, fue altamente limitado por el tiempo de procesamiento que requería el análisis de cada imagen lo cual es debido al alto número de capas utilizadas, por tanto se tomó únicamente como referente. En las Tablas 1 y 2 se incluye la efectividad con base en la razón entre el resultado del método propuesto y un valor obtenido de un análisis detallado de cada fotografía, que se realiza con el mismo método, pero con una optimización de los parámetros mediante el ajuste de aquellos correspondientes a cada una de las fotografías.

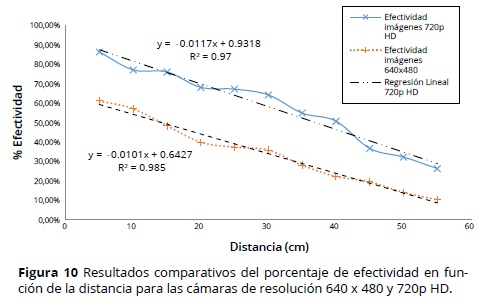

En la Figura 10 se comparan los valores promedios de efectividad para cada resolución de imagen en función de la distancia y la línea de tendencia que representa el comportamiento aproximado de la distancia vs. la efectividad. Esta línea corresponde a una regresión lineal que satisface el comportamiento de los datos obtenidos (R2 = 0.97 y R2 = 0.985, respectivamente) y muestra que el tipo de comportamiento se puede aproximar a una función lineal donde X es la distancia y Y el porcentaje de efectividad.

Con base en los resultados obtenidos se puede deducir que la resolución de cámara 720p HD proporciona los mejores resultados para esta aplicación debido a que su efectividad es superior que la de 640 x 480 (ver Figura 10).

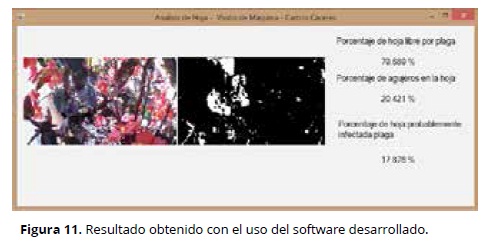

En la Figura 11 se presenta el resultado del software desarrollado, donde se observa el análisis de una de las imágenes de prueba, en este caso una imagen a 5 cm del cultivo, tomada con la cámara de resolución 720p HD.

Beneficios económicos

Un Drone como el utilizado en este estudio tiene una velocidad crucero de 5 m/s, mientras que el ser humano camina, en promedio, 1 m/s, lo cual es una diferencia significativa ya que al final de 1 día de jornada laboral (8 h) el Drone recorre 14.4 km más que el trabajador, lo cual es un beneficio económico y social. Aunque la batería con mayor capacidad para el RA tiene un tiempo de uso máximo de 30 min y un tiempo de carga total de 4 h. El costo del ARDrone 2.0 es aproximadamente de US$500, cada batería de larga duración cuesta US$20 y su módulo GPS cuesta US$150.

Conclusiones

- El uso de métodos de reconocimiento facilita el análisis de plagas en áreas extensas de cultivos de manera rápida y acertada.

- Las ventajas de tipo económico y social de este método se ven reflejadas en el ahorro de tiempo de los trabajadores en labores de revisión de cultivos, lo cual implica disminuir el esfuerzo físico y de esta manera mejorar su calidad de vida.

- La detección de plagas mediante técnicas de procesamiento de imágenes es un procedimiento rápido y con ventajas económicas, especialmente para asistir al sector de la agricultura en el monitoreo de grandes áreas de plantación.

- En el futuro sería posible mejorar algunos algoritmos y adecuar técnicas como filtros adaptativos para aumentar la precisión de dichos algoritmos y reducir la dependencia de factores externos.

Referencias

Barata, T.; y Pina, P. 2003. Morphological recognition of olive grove patterns. En: Perales F. J.; Campilho A. J.; Perez, N.; y Sanfeliu, A. Pattern recognition and image analysis. Mallorca. p. 89 - 96. Editorial Springer. [ Links ]

Bovik, A. C. 2005. Handbook of image and video processing, 2th. ed. Londres. Elsevier Academic Press.1384 p. [ Links ]

Etxeberria, J. A. 2010. Algoritmo de reconocimiento de forma y color para una plataforma robótica. Tesis de Master. Universidad del País Vasco. Departamento de Ciencia de la Computación e Inteligencia Artificial. En: http://www.ccia-kzaa.ehu.es/s0140-con/es/contenidos/informacion/tesis_master/es_t_master/adjuntos /10jaristondo.pdf. Consulta: Julio de 2013. [ Links ]

Fonterlz, J. O. 2013. Begonia semperflorens, Flor de Azúcar, Begonia siempre Florida. En: Plantas Villor, http://plantasvillor.es/begonia-semperflorens-flor-de-azucar-begonia-siempre-florida/#.UhVWQJI9-zt; consulta: Julio de 2013. [ Links ]

Gedraite, E. S. y Hadad, M. 2011. Investigation on the effect of a Gaussian Blur in image filtering and segmentation. ELMAR Proceedings. p. 393 - 396. [ Links ]

Grbić, M.; Van Leeuwen, T.; Clark, R. M.; Rombauts, S.; Rouzé, P.; Grbić, V.; Osborne, E. J.; y Dermauw, W. 2011. The genome of Tetranychus urticae reveals herbivorous pest adaptations. Nature 479(7374):487 - 492. [ Links ]

Hendriks, L.; Cris, L.; Borgefors, G.; Strand. R. 2013. 11th International Symposium, ISMM 2013, Uppsala, Sweden, May. p. 27 - 29. [ Links ]

Husin, Z. B.; Shakaff, A.; Aziz, A.; Farook, R. 2012. Feasibility study on plant chili disease detection using image processing techniques. Third Int. Conf. Intelligent Syst.. Modelling and Simulation (ISMS). p. 291 - 296. [ Links ]

Yan, L.; Chunlei, X.; y JangMyung, L. 2009. Vision-based pest detection and automatic spray of greenhouse plant. IEEE International Symposium on Industrial Electronics. p. 920 - 925. [ Links ]

Jin-liang, Y.; Yi-bo, G.; Liang-jun, M.; y Yi-Ping, Y. 2008. Scene text extraction based on HSL. International Symposium on Computer Science and Computational Technology. 2. p. 315 - 319. [ Links ]

Nixon, M. S. y Aguado, A. S. 2002. Feature extraction and image processing. 1th Ed. Londres. Newnes. [ Links ]

Noda, K.; Ezaki, N.; Takizawa, H.; Mizuno, S.; y Yamamoto, S. 2006. Detection of plant saplessness with image processing. International Joint Conference SICE-ICASE. p. 4856 - 4860. [ Links ]

Najman, L. y Talbot, H. 2010. Mathematical morphology: from theory to applications. ISTE-Wiley. 520 p. [ Links ]

Perkins, C. 2009. The blur & sharpen effects. En: the after effects illusionist. Boston. Focal Press. p. 43 - 84. [ Links ]

Shih, F. 2009. Image processing and mathematical morphology. CRC Press. p. 55 - 87. [ Links ]

Sun, D. W. 2012. Computer vision technology in the food and beverage industries. Elsevier. 208 p. [ Links ]

Wesolkowski, S.; Dony, R. D.; y Jernigan, M. E. 1999. Global color image segmentation strategies: Euclidean distance vs. vector angle. Neural Networks for Signal Processing. Proceedings of the IEEE Signal Processing Society Workshop. p. 419 - 428. [ Links ]