Services on Demand

Journal

Article

Indicators

-

Cited by SciELO

Cited by SciELO -

Access statistics

Access statistics

Related links

-

Cited by Google

Cited by Google -

Similars in

SciELO

Similars in

SciELO -

Similars in Google

Similars in Google

Share

Revista Colombiana de Educación

Print version ISSN 0120-3916

Rev. colomb. educ. no.66 Bogotá Jan./June 2014

Hacia una educación basada en la evidencia

Towards An Education Based On Evidence

Rumo A Uma Educação Baseada Na Evidência

Christian Hederich Martínez*

Jorge Martínez Bernal**

Lida Rincón Camacho***

*Profesor de la Universidad Pedagógica Nacional, Bogotá Colombia. Correo electrónico: christian.ederich@gmail.com

**Profesor de la Fundación Universitaria Sanitas. Bogotá Colombia. Correo electrónico: jorgemartinezbernal@gmail.com

***Profesora de la Universidad Pedagógica Nacional, Bogotá Colombia. Correo electrónico: lidita_la@hotmail.com

Recibido: 06/02/2014-Evaluado: 18/02/2014-14/03/2014

Resumen

La enseñanza, como otras profesiones, ha tenido que enfrentar dificultades que surgen como producto de la brecha que se crea entre la práctica diaria y la investigación. Plantear soluciones que permitan cambiar esta condición ha sido el objetivo del enfoque conocido como Educación Basada en la Evidencia (EBE). Este artículo presenta, en primer lugar, los orígenes del enfoque en la medicina, sus desarrollos y sus principales limitaciones. En segundo lugar, explica la relación entre la medicina y la educación, como prácticas profesionales basadas en la evidencia, con el fin de examinar los principales aportes de la primera para la construcción de una EBE. En tercer lugar, presenta un pequeño estudio bibliométrico a fin de examinar el desarrollo del tema en publicaciones científicas. Finalmente, se analizan aspectos como la contribución de la investigación cualitativa a la evidencia en educación, los desarrollos del enfoque a través de las revisiones sistemáticas y el vínculo entre práctica profesional del maestro y la investigación educativa.

Palabras Clave: Educación basada en la evidencia, evidencia, investigación educativa, práctica educativa, institucionalización, revisiones sistemáticas.

Abstract

Teaching, as any other profession, has faced difficulties that arise from the gap between daily practice and research. Suggesting solutions that lead to close this gap has been the goal of the research approach called Evidence Based Education (EBE). This paper presents and discusses the EBE approach by means of the following topics. First; the origins of this approach in the Medical research practice, its development and main limitations are presented. Second, a comparison between Medicine and Education, as professional practices based on evidence, is made; in order to identify the main contributions of the former to the construction of an EBE. Third, a short bibliometric study that examines the development of this subject in scientific publications is presented. Finally, factors such as the contribution of qualitative data to evidence in educational research, the development of this approach through systematic reviews and the link between teacher's professional practice and educational research are analysed.

Keywords: Evidence based education, evidence, educational research, educational practice, institutionalization, systematic reviews.

Resumo

O ensino, como outras profissões, tem tido que afrontar dificuldades que surgem produto do desfecho existente entre a prática diária e a pesquisa. Propor soluções que permitam mudar esta condição tem sido o objetivo do enfoque de Educação Baseada na Evidência (EBE). O presente artigo apresenta em primeiro lugar, as origens deste enfoque na medicina, seu desenvolvimento e suas principais limitações. Em segundo lugar, explica a relação entre a medicina e a educação como praticas profissionais baseadas na evidência, com o fim de examinar os principais aportes da primeira para a construção de uma EBE. Em terceiro lugar, apresenta-se um estudo bibliométrico, com o objetivo de examinar o desenvolvimento da temática em publicações científicas. Finalmente, analisam-se aspetos como a contribuição das pesquisas qualitativas à evidêencia em educação, o desenvolvimento do enfoque através das revisões sistemáticas e o vínculo entre prática profissional do professor e pesquisa em educação.

Palavras chave: Educação baseada na evidência, evidência, pesquisa educativa, prática educativa, institucionalização, revisões sistemáticas.

"La enseñanza no es, en el presente, una profesión basada en la investigación". Así iniciaba, en 1996, David Hargreaves, la conferencia anual de The Teacher Training Agency1, titulada Teaching as a Research-Based Profession: Possibilities and Prospects" (La enseñanza como una profesión basada en la investigación: posibilidades y prospectiva). Esta frase, pronunciada en el Reino Unido hace ya casi veinte años, sigue conservando hoy en día toda su vigencia y mantiene implicaciones que resultan profundamente preocupantes.

En efecto, cuando una profesión no se fundamenta en resultados de investigación, y por tanto ignora el conocimiento sistemáticamente producido acerca de sus medios y sus métodos, poco a poco se convierte en algo menos que una profesión: se convierte en una práctica de naturaleza artesanal, cimentada en la perpetua repetición de las acciones que la experiencia, o la tradición, han señalado como adecuadas para cada caso. Este estado de cosas impide el progreso y la transformación. Es retrógrado, poco constructivo y claramente inconveniente.

La enseñanza no ha sido la única práctica profesional que ha enfrentado este tipo de dificultades. Un breve rastreo de la literatura sobre el tema señala que este fenómeno ha estado presente en otras profesiones. Por ejemplo la medicina o la enfermería han sido profesiones que, por épocas, han abandonado las bases científicas que las soportan. Por esta razón, al planteamiento inicial de Hargreaves le seguía el establecimiento de un paralelismo entre la medicina y la enseñanza, en la búsqueda de elementos comunes y diferentes que pudieran aclarar la situación de una educación que lograra, de alguna manera, basarse en la investigación, en referencia a una medicina que, en los últimos tiempos, ha avanzado de forma sig nificativa en ese sentido.

Siguiendo las líneas marcadas por Hargreaves (1996), en este trabajo rastrearemos primero la historia de la profesión médica hasta el actual movimiento de la medicina basada en la evidencia. Hecho esto, haremos un recuento histórico del desarrollo de las ideas que proponen una educación basada en la evidencia; a partir de la conferencia de Hargreaves (1996), las reacciones al planteamiento y la institucionalización del enfoque. Posteriormente, podremos ya definir estrictamente el enfoque y el método. Para describir su desarrollo, se expondrá un breve análisis bibliométrico de las publicaciones sobre el tema. Finalmente, la discusión y conclusiones pretenden aportar una visión general del estado del tema y de las principales precisiones logradas.

Antecedentes: la medicina basada en evidencia

Podría decirse que la preocupación por respaldar las intervenciones médicas con información científica surge a finales de los años setenta, cuando algunos investigadores se esforzaron por ligar las actuaciones médicas cotidianas con las investigaciones clínicas existentes (Sackett,Rosenberg, Gray, Haynes y Richardson, 1996). Más adelante en Canadá esta preocupación se tradujo en esfuerzos por analizar, de forma integrada y crítica, los estudios que se publicaban en las revistas científicas sobre algún tema específico (Guyatt, 2008).

Como tal, el concepto de la medicina basada en la evidencia (MBE) nace en la Universidad de McMaster, cuando G. Guyatt, encargado de enseñar a los residentes de medicina a apreciar críticamente la información científica disponible sobre temas específicos, acuña la expresión, la cual aparece publicada por primera vez en el American College of Physicians' Journal Club, en el año 1991 (Guyatt, 2008).

Desde ese primer momento se planteó que el método del enfoque MBE podría consistir en la elaboración de una buena pregunta, bien formulada y delimitada, la búsqueda exhaustiva de estudios científicos al respecto y el análisis sistemático y conjunto de la evidencia publicada sobre la pregunta en cuestión.

Formalmente, se entiende por medicina basada en la evidencia:

"[…] la aplicación de los mejores resultados de la investigación biomédica al proceso de toma de decisiones respecto a los cuidados de la salud de un ser humano, poniendo especial atención a las preferencias y acciones del paciente y las de su familia o de los adultos responsables de un niño si tal es el caso. (Rivera, 2004).

Un evento trascendente en la evolución de esta corriente fue la fundación, en 1993, en Oxford, de la Colaboración Cochrane, nombrada así en honor al epidemiólogo británico Archie Cochrane (1909-1988). En su momento, el doctor Cochrane llamó la atención sobre la poca fiabilidad de la mayoría de las decisiones médicas y participó activamente en la organización del servicio británico de salud, sosteniendo el postulado de que los médicos deberían tener acceso gratuito a la información disponible sobre los mejores tratamientos para el bien de sus pacientes. Desde su inicio, la Colaboración Cochrane, se propuso auspiciar el desarrollo de estudios de revisión sistemática sobre los temas más relevantes de la medicina y facilitar el acceso a la información de mayor calidad por parte de los médicos.

En general, una revisión sistemática consiste en una investigación secundaria, en la que se realiza una revisión de investigaciones primarias, elegidas a partir de una pregunta específica. Lo anterior con el propósito de identificar, seleccionar, sintetizar y evaluar toda la evidencia relevante de alta calidad que permita responder la pregunta. La elaboración de estas revisiones sistemáticas son el aspecto medular del método (Higgins y Green, 2011).

En la actualidad, la Colaboración Cochrane hace presencia en más de 120 países. Además de impulsar la realización de revisiones sistemáticas de los trabajos publicados, promueve que los protocolos de investigación sean registrados, desde su fase de elaboración, con el objetivo de impedir sesgos en su realización, evitar la duplicidad de trabajos y la pérdida de esfuerzos y mantener actualizadas las revisiones existentes (The PLoS Medicine Editors, 2011).

Durante el desarrollo de la MBE, la idea de que la evidencia disponible en las publicaciones científicas debía ser analizada sistemáticamente, introdujo una dificultad importante relacionada con que no todo estudio aporta evidencia del mismo valor. En efecto, los estudios podían diferir entre sí en aspectos del método utilizado, por ejemplo, en los procedimientos de selección y tamaño de la muestra, en el tipo de diseño, en los indicadores elegidos para dar cuenta de las variables estudiadas, o en la cantidad y calidad de los controles experimentales, entre otros. Esto señalaba la necesidad de jerarquizar los diferentes tipos de evidencia para otorgar mayor importancia a aquellos trabajos que muestren mayor solidez metodológica y técnica, de acuerdo con algún conjunto de criterios previamente establecidos. La jerarquización de la evidencia pasaría más adelante a constituirse en uno de los puntos más importantes y más debatidos del método; como lo demuestra el hecho de que actualmente se conocen en medicina casi 100 sistemas diferentes para estratificar los niveles de evidencia de los estudios de investigación (West et ál., 2002). Claramente esto, en vez de ayudar a utilizar de forma ágil los resultados de los estudios, se convierte, en sí mismo, en un distractor adicional.

Entre los distintos sistemas de categorización de los estudios según su calidad, pueden mencionarse los siguientes, por su practicidad y por su frecuencia de uso (Manterola y Zavando, 2009):

- Canadian Task Force on Preventive Health Care (CTFPHC). Una propuesta bipolar, que solo asigna dos valores: sí se recomienda, o no se recomienda.

- Clasificación de la Evidencia según Sackett, con niveles de 1 al 5, donde 1 es la mejor evidencia y 5 la peor. Define cuatro grados de recomendación (A-D).

- Oxford Centre for Evidence- Based Medicine (OCEBM). Retoma la misma clasificación de Sackett pero adiciona el área temática y el tipo de estudio.

- Scottish Intercollegiate Guidelines Network (SIGN). Similar a OCEMB pero da más valor a las revisiones sistemáticas y a la reducción del error sistemático.

En la guía para usuarios de la literatura médica, Guyatt propone dos principios fundamentales de la medicina basada en la evidencia: primero, un sistema genérico de jerarquización de la información para la toma de decisiones; segundo, la recomendación de no tomar decisiones basadas solo en la evidencia (Guyatt, 2008). A continuación se muestra el resumen del sistema de jerarquización de los estudios:

- Ensayos clínicos aleatorizados

- Revisiones sistemáticas de ensayos clínicos aleatorizados

- Ensayos aleatorizados simples

- Revisión sistemática de estudios observacionales

- Estudios observacionales individuales

- Estudios fisiológicos

- Observaciones clínicas no sistemáticas.

Respecto del segundo de los principios mencionados, un punto que resulta crucial dentro del enfoque de la MBE es que, aunque la evidencia científica es fundamental, nunca se considera suficiente, por sí misma, para tomar una decisión o implementar un tratamiento. Así, para la toma de las decisiones médicas, Guyatt (2008) propone un modelo triádico en el que se combinan la evidencia científica obtenida en estudios de investigación, la experiencia clínica del médico y las preferencias y valores de los pacientes. Solo a partir de la integración de estos tres componentes se pueden tomar decisiones médicas que convengan realmente a cada quien (Guyatt, 2008; Rivera, 2004).

La enseñanza basada en la evidencia

El planteamiento inicial

Sin lugar a dudas, se identifica la conferencia de D. Hargreaves (1996), con la que iniciábamos el artículo, como el evento fundacional de lo que más adelante pasaría a llamarse una "enseñanza basada en la evidencia".

Como se mencionó, inicia Hargreaves (1996) su conferencia con la idea de que la enseñanza no es, en este momento, una profesión basada en la investigación, lo cual explica muchas de las dificultades que enfrenta. De acuerdo con el autor, para llegar a serlo deben darse cambios profundos; por un lado, en el tipo de investigación que se hace en educación, y por otro, en los modos en los que esta investigación se organiza y se disemina.

De acuerdo con Hargreaves (1996), pese a que la medicina y la educación son profesiones muy semejantes en su práctica -puesto que están centradas en las personas-, los desarrollos científicos en los dos campos han tenido impactos muy diferentes en cada profesión por la clase de ciencia y de investigación que se maneja en cada una. Por una parte, en el campo de la medicina, las investigaciones han permitido crear un lenguaje técnico compartido que utilizan los médicos en su práctica; en la enseñanza tal lenguaje técnico no existe. Aquí, a lo que puntualmente se refiere el autor es a que las disciplinas que fundamentan la enseñanza, tales como la psicología, la filosofía, la historia y la sociología, entre otras, a pesar de que proporcionan un conocimiento específico, este no se refleja directamente en las prácticas del profesor. "Pareciera que los profesores son capaces de ser efectivos en su trabajo en una casi total ignorancia de esta infraestructura" (Hargreaves, 1996: p. 2).

Otra gran diferencia entre las dos profesiones es que en la medicina, así como en las ciencias naturales, la investigación tiene un carácter acumulativo, mientras que en la educación es totalmente al contrario. Esto, en parte, porque muy pocos investigadores en educación buscan crear un cuerpo de conocimiento que luego pueda ser probado, extendido o remplazado de modo sistemático. Más bien, un gran número de estudios educativos quedan inconclusos y no son replicados, lo cual resulta problemático, en la medida en que las réplicas son necesarias, dadas las variaciones contextuales y culturales que afectan las situaciones sociales.

Una diferencia importante, al decir de Hargreaves (1996), entre estas profesiones, es la identidad de las personas que hacen investigación. En medicina, a pesar de que gran parte de la investigación básica es desarrollada por expertos y científicos en el área, la investigación aplicada es desarrollada por los practicantes de los hospitales, y así lo atestiguan el amplio número de publicaciones en las revistas científicas. Por el contrario, la investigación que es publicada en el campo educativo es desarrollada por académicos expertos que, si bien se dedican a la investigación, no tienen experiencia en la enseñanza en el contexto escolar. Por lo general, las investigaciones desarrolladas por los practicantes no son redactadas como artículos y menos publicadas en revistas educativas.

Los medios de difusión de las investigaciones es otra gran diferencia entre las dos profesiones. Mientras que en medicina se cuenta con revistas importantes que favorecen la circulación de los avances científicos (aproximadamente 25.000 en PubMed en 2013), en educación aún falta un mayor desarrollo para el acceso a los resultados de las investigaciones. Esto puede estar relacionado, también, con las fuentes de financiación privada que están presentes en el campo de la medicina, los laboratorios farmacéuticos, por ejemplo, y que no tienen similares en el campo de la educación.

Otra diferencia fundamental entre estos dos campos está relacionada con la naturaleza de la evidencia que señala la efectividad de una intervención. Mientras que en el caso de la medicina la evidencia -compuesta por signos clínicos y pruebas de laboratorio- es clara, precisa, objetiva e incontrovertible, en el caso de la intervención educativa esto no es así. Por el contrario, con demasiada frecuencia la evidencia disponible es inestable, imprecisa y de naturaleza subjetiva, tal como lo puede ser la impresión que obtiene un profesor sobre la satisfacción que experimentan sus alumnos o, en el mejor de los casos, los resultados frente a un examen que el mismo profesor ha confeccionado. Esto, aunado al hecho de que el avance logrado por un profesor depende en gran medida de los niveles iniciales de sus alumnos, dificulta consolidar evidencia sobre los efectos y la efectividad de lo que hacen los profesores en un salón de clase, lo que no ha favorecido la creación de un corpus de conocimiento estable sobre la efectividad de las prácticas educativas.

Por último, vale la pena subrayar un argumento que diferencia de forma tajante el estado actual de estas dos profesiones: mientras los médicos piden y desarrollan investigaciones basadas en la evidencia, esto es, se constituyen en productores y usuarios activos de la misma, los profesores aún no perciben la falta de investigación como un problema que debe ser remediado, por lo que la producción de conocimiento educativo es lenta y su difusión es limitada.

Replicas y contrarréplicas

La primera respuesta frente a los planteamientos de Hargreaves (1996) no se hizo esperar, y llegó pocos meses después, en 1997, en forma de un extenso artículo publicado en el British Educational Research Journal, escrito por un profesor de la Open University llamado M. Hammersley.

En su artículo, Hammersley (1997) inicia su crítica sobre la afirmación de que la enseñanza no está basada en la evidencia preguntándose: ¿qué se considera evidencia y qué no? Según este autor, las afirmaciones que Hargreaves (1996) hace a este respecto parecen comprometerse con una perspectiva metodológica, que la mayoría de investigadores en educación estimarían como positivista. Si bien para Hammersley, esta estimación es un error, se requerirían especificaciones y justificaciones acerca del modelo de investigación necesario para que la investigación educativa esté basada en la evidencia.

Al respecto de la naturaleza práctica de la enseñanza, Hammersley señala la dificultad dada por el hecho de que la actividad educativa se orienta por una extrema multiplicidad de metas, lo que dificulta en gran medida su operacionalización. Esto es básicamente cierto: las expectativas generadas por la educación son enormes, en la medida en que, como resultado del proceso educativo se espera, no solo aprendices mejor informados, más conscientes, con mejores capacidades de aprendizaje y adaptación al cambio, sino también ciudadanos conscientes, trabajadores con capacidades para desempeñarse en equipo, demócratas comprometidos, sujetos con altas capacidades de pensamiento crítico, ciudadanos honestos y plenos de valores morales, etc, etc. En esa dirección, centrarse en la efectividad de la pedagogía, tal y como lo plantea Hargreaves, significaría darle una importancia exagerada a los resultados y a sus mediciones, sin tomar en cuenta que las medidas que se utilizan, desde la perspectiva de la efectividad de la escuela, nunca son suficientes para medir todos los resultados.

Otro problema asociado con la crítica de Hargreaves (1996) tiene que ver con el carácter poco acumulativo de la investigación educativa. Frente a esto, Hammersley (1997) argumenta que en la historia de la investigación educativa existen datos de estudios dedicados a la investigación científica de la enseñanza efectiva cuyo trabajo fracasó al intentar producir resultados concluyentes y acumulativos. Por esta razón, la investigación en educación comenzó a privilegiar otro tipo de aproximaciones al conocimiento, y muy específicamente los métodos de carácter cualitativo y del tipo de la investigación acción. A pesar de esta precisión, el autor manifiesta su acuerdo frente al hecho de que los investigadores en educación, por lo general, establecen un compromiso exclusivo con estudios únicos, lo que señala como un defecto común en la investigación educativa y, en general, en las ciencias sociales. Así, se acepta que se requiere avanzar hacia la construcción de investigaciones que tengan bases más efectivas en investigaciones previas, al tiempo que se necesita prestar más atención a la manera como se prueban e interpretan los datos, tanto a nivel descriptivo como explicativo. En esa dirección es claro que se requieren réplicas, aunque éstas no deben tomar la misma forma que las hechas en investigaciones experimentales.

Como era de esperar, a la réplica de Hammersley le siguió, de forma por demás rápida, una contrarréplica de Hargreaves publicada en este mismo año de 1997. En ella, el autor elabora sobre los alcances y los límites de los paralelismos entre la educación y la medicina y, más específicamente, sobre tres aspectos del paralelismo: 1) las diferencias entre maestros y médicos, 2) la naturaleza de la investigación en las dos profesiones y 3) las relaciones entre la investigación y la práctica profesional en cada caso.

De acuerdo con Hargraves (1997) las similitudes entre las dos profesiones son mucho mayores de lo que pudiera pensarse a simple vista. Tanto los médicos practicantes como los profesores son profesionales aplicados, personas prácticas haciendo intervenciones en las vidas de los clientes con el fin de promover, ya sea la salud o el aprendizaje. La práctica profesional de ambos está centrada en la toma de decisiones basadas en juicios (énfasis práctico), más que a partir del seguimiento de reglas (énfasis técnico). No obstante, la diferencia está en que muchos médicos se basan en la investigación sobre los efectos de su práctica para informar y mejorar sus decisiones, mientras que la mayoría de los maestros no lo hacen.

En relación con la naturaleza del conocimiento, también Hargreaves (1997) subraya las similitudes entre las dos disciplinas, defendiendo la idea de que la medicina tiene una base de conocimiento complejo que integra tres niveles: el nivel de las ciencias naturales, especialmente de la biología; el nivel de las ciencias médicas y clínicas y el nivel de los estudios de lo que funciona en las prácticas clínicas. Por esta razón, tanto las decisiones médicas, como la práctica clínica están lejos de ser una mera aplicación directa de las leyes universales características de las ciencias naturales o del paradigma positivista. En ese sentido, la decisión de un médico debe establecer un balance entre lo que se sabe en las ciencias naturales, en las ciencias de la medicina, en la tradición, en lo que le fue enseñado y en su experiencia personal. Sin embargo, mientras se establece el balance entre estos elementos, el médico debe usar la investigación científica para contribuir a mejorar la calidad del juicio final sobre un paciente o un caso clínico específico.

En esta dirección, Hargreaves (1997) define que lo que hace que la medicina sea una profesión basada en la evidencia, es que la investigación en la práctica se convierte en un componente explícito adicional en los juicios clínicos para mejorar las habilidades involucradas, no para reemplazarlas. Esta misma idea podría resultar útil en el desarrollo de las prácticas docentes y en la toma de decisiones de esta profesión, aunque hasta el momento no funcione de esta forma.

Lo que para Hargreaves se denomina sabiduría práctica, entendida como el conocimiento de lo que funciona y lo que no para la toma de decisiones, es algo que sin duda está presente tanto en la medicina como en la enseñanza. Por el lado de la medicina, parece haber una profunda base científica en el conocimiento desarrollado por los médicos, que es fortalecido con la sabiduría práctica, que también entra en juego en la toma de una decisión. Por el lado de la educación, los profesores también adquieren este tipo de sabiduría, sin embargo, en comparación con los médicos, tienen una base de conocimiento menos rica, es decir, tienen menos conocimiento científico que puedan involucrar en la toma de decisiones. Esta situación podría atribuirse a dos grandes razones. En principio, a una pobre infraestructura de la base de conocimiento en la enseñanza, que de alguna manera podría y debería ser remediado en la medida en que los conocimientos proporcionados por las investigaciones en otras disciplinas como la psicología y la sociología, fueran aplicados al fenómeno educativo. En segundo lugar, para el campo de la enseñanza parece haber menos evidencia acerca de lo que funciona o no, y la que existe no está disponible de tal forma que pueda ser considerada como un recurso de fácil acceso para los profesores.

Finalmente, Hargreaves (1997) reconoce la crítica de Hammersely (1997) acerca de haber ignorado la investigación acción en su primera conferencia, siendo esta el enfoque que más desarrollo ha tenido en la educación. Hargreaves rectifica su omisión y honra los aportes de Kurt Lewin -conocido como el padre de la investigación acción, y al tiempo padre de la psicología social experimental-al rescatar sus propuestas relacionadas con las funciones de la investigación: producir ciencia social de alta calidad y generar aplicaciones para el mejoramiento humano (Lewin, 1946). En ese sentido, es probable que la idea de una investigación educativa inspirada en la medicina basada en la evidencia pudiera estar más cerca de los principios explicados por Lewin. Concluye Hargreaves que generar la infraestructura científica necesaria en la investigación educativa y producir mejores aplicaciones en la práctica profesional no dependerá de una sola metodología en particular.

La institucionalización de la educación basada en la evidencia

Uno de los momentos de mayor importancia en el movimiento de la educación basada en la evidencia (EBE) es la fundación en Londres, en el año de 1999, de la llamada Colaboración Campbell (Campbell Collaboration). Esta organización fue fundada por ochenta personas provenientes de cuatro países, muchas de ellas vinculadas a la Colaboración Cochrane, que se había mencionado para el caso de la medicina.

La Colaboración Campbell toma su nombre del psicólogo Donald Campbell (1916-1996), miembro de la Academia Nacional de Ciencias de los Estados Unidos, quien defendía la idea de que las reformas en la política pueden ser vistas como experimentos sociales en los que las reglas de la evidencia científica son aplicables. Esta organización es una red internacional de investigación que produce revisiones sistemáticas de los efectos de las intervenciones sociales y prepara, mantiene y disemina revisiones sistemáticas en educación, justicia, bienestar social y desarrollo internacional.

La Colaboración Campbell toma los principios y métodos de elaboración de revisiones de la Colaboración Cochrane. Actualmente tiene su secretaría radicada en Oslo (Noruega) y cuenta con seis grupos activos, entre los que se cuenta el de educación. Si se cuentan solo las revisiones sistemáticas elaboradas directamente por el grupo de educación y publicadas en su página web, entre el año 2002 y 2013 este grupo ha realizado y publicado un total de 17 revisiones sistemáticas. Sin embargo, si se considera el total de revisiones hechas sobre temas que atañen a la educación en colaboración con otros grupos, la cifra asciende a 91 revisiones sistemáticas publicadas, sobre temas tan diversos como la importancia del involucramiento de las familias en el logro académico de los estudiantes (Nye, Schwartz y Turner, 2006; Spier et al., 2013), o la efectividad de los programas de intervención sobre el acoso escolar (Farrington y Ttofi, 2009; Ttofi, Loeber, Lösel, y Farrington, 2012), la violencia (Petrosino, Guckenburg, y Fronius, 2013) o el abuso sexual (Zwi et al., 2007), entre otras. Muchas de las revisiones tratan sobre temas en extremo específicos, como pueden ser la efectividad de los programas educativos para la reducción de la prevalencia de la mutilación genital femenina en países africanos (Berg y Denison, 2012), o de los programas para disminuir el embarazo en adolescentes (Scher, Maynard, y Stagner, 2006) o de los programas de bolsa de empleo para personas con desórdenes del espectro autista (Westbrook, Fong, Nye, Williams, Wendt y Cortopassi, 2013).

Desde el año 2001, la Colaboración Campbell organiza un coloquio internacional por año que atrae investigadores y formuladores de política de todo el mundo con el propósito de promover las revisiones sistemáticas de evidencia investigativa en sus áreas de interés. En su página web (http://www.campbellcollaboration.org) dispone de una buena base de material bibliográfico y de video para la capacitación en su metodología sobre la elaboración de revisiones sistemáticas.

Elementos definitorios de la EBE

Como ya se ha dicho, el elemento definitorio, por excelencia, de una práctica profesional basada en la evidencia es la pretensión de que las decisiones profesionales cotidianas, sean estas la prescripción de una medicina, la recomendación de una intervención psicológica o la formulación de un programa pedagógico, estén efectivamente apoyadas en los resultados aportados al respecto por la investigación científica. Debe observarse acá que no estamos indicando que la investigación científica sea la única fuente de información para la toma de estas decisiones; simplemente, se señala la importancia de que esta fuente de conocimiento se le considere explícitamente como válida, y no se le ignore de forma rampante como ocurre hoy, con demasiada frecuencia.

Para que una práctica profesional pueda tomar base en la evidencia, se requiere que los resultados de la investigación acerca de los diferentes aspectos de una profesión sean accesibles y se mantengan disponibles al profesional que debe aplicarlos. Por su parte, el profesional deberá mantenerse actualizado sobre cada uno de los temas que resultan críticos en el ejercicio de su disciplina.

Estos puntos se resuelven en parte si aseguramos que los resultados de la investigación científica sean efectivamente publicados en revistas especializadas y reconocidas y que estas resulten accesibles al profesional. Este es el origen de los diferentes sistemas de indexación de publicaciones y de las actuales redes y bases de datos de publicaciones científicas. Suponiendo que el profesional tenga acceso a estas bases de datos, lo cual no está para nada garantizado, tendrá este la posibilidad de examinar los artículos científicos vinculados con su especialización, lo cual le aseguraría un buen grado de actualización.

Lamentablemente, las posibilidades que tiene un profesional para mantenerse actualizado sobre los avances de su especialidad a partir de las publicaciones especializadas son muy escasas si consideramos el tiempo y esfuerzo que entrañaría hacerlo con los volúmenes actuales de producción científica. En el caso de la medicina, por ejemplo, las dificultades son apreciables si se tiene en cuenta que, de forma constante, desde 1978 el número de artículos publicados en revistas indexadas y agrupadas en la red MedLine ha crecido, año tras año, a un tasa cercanaal 46% (Druss, 2005). Con esta tasa de crecimiento es imposible, para cualquier profesional, mantenerse mínimamente informado acerca de los avances de su especialidad en su profesión.

Por esta razón, las organizaciones que promueven una práctica profesional basada en la evidencia insisten en la necesidad de elaborar revisiones sistemáticas de la información científica disponible. Si se cuenta con este tipo de revisiones, y estas resultan completas y confiables, es muy fácil para el profesional estar actualizado sobre los principales avances de su especialidad, sin tener que leer la gran cantidad de información científica que, año tras año, sale publicada en las revistas especializadas.

Ahora, para que estas revisiones sistemáticas sean completas y confiables, deben elaborarse de acuerdo con una estrategia de búsqueda y análisis predefinida, explícita y sistemática, con la cual se intenta limitar al máximo el sesgo del investigador, generalmente por medio de meta-buscadores que cuentan con acceso a varias bases de datos (Colaboración Cochrane, 2013; Letelier y Moore, 2003;). El procedimiento para hacerlo se explicará en la siguiente sección.

Revisiones sistemáticas y meta-análisis

Ante la gran cantidad de información científica con que se cuenta en la actualidad y la alta velocidad con que crecen las publicaciones y los artículos en las bases de datos, las diferentes organizaciones que promueven el uso de la información científica para la toma de decisiones profesionales y políticas plantean la importancia de identificar, evaluar y sintetizar la evidencia que se obtiene de la investigación y presentarla a los usuarios en formatos claros y accesibles. A esto se le denomina revisiones sistemáticas: estudios que pretenden recopilar toda la evidencia empírica de acuerdo con criterios de selección definidos de forma previa y precisa para dar respuesta a preguntas de investigación específicas.

Para la elaboración de revisiones sistemáticas, diferentes organizaciones e investigadores han propuesto metodologías explícitas y sistemáticas que se proponen disminuir al máximo los sesgos y producir resultados más fiables a partir de los cuales se alcancen mejores conclusiones y se tomen decisiones mejor fundamentadas para individuos o comunidades (Higgins y Green, 2011). En este punto pueden aparecer amplias y muy significativas diferencias entre las revisiones sistemáticas según son propuestas por las organizaciones dedicadas al área de la salud, tales como la Colaboración Cochrane, o aquellas organizaciones o investigadores dedicados a la investigación social. Con el fin de dar cuenta de manera amplia de las diferentes perspectivas, iniciaremos con la visión de lo que puede ser llamado una revisión de la literatura en el campo de la educación, para finalmente presentar cómo estas son entendidas en el ámbito de la salud.

En general, los investigadores parecen estar de acuerdo con la importancia de distinguir las revisiones narrativas de literatura, de las revisiones sistemáticas. Una revisión narrativa tiene como propósito esencial identificar el número de escritos producto de investigaciones sobre un objeto de conocimiento o un tema en particular. En este tipo de revisiones no hay necesariamente una estrategia de búsqueda especificada, ni criterios definidos para la selección de publicaciones. El interés es revisar el tipo de metodología utilizada, las muestras o poblaciones sobre las cuales se trabajó y los tipos de resultados o hallazgos obtenidos. Es preciso aclarar que este tipo de revisiones no tiene pretensiones de buscar generalizaciones o conocimiento acumulado, sino más bien, identificar la cantidad de literatura disponible sobre determinado tema. A partir de estas revisiones se pueden localizar vacíos de conocimiento con el fin de proponer estudios futuros que los aborden directamente (Davies, 2000; Beltran, 2005).

En contraste con las revisiones narrativas, las revisiones sistemáticas parten de preguntas específicas de investigación, y consideran estrategias de búsqueda de la información claramente especificadas con criterios de selección de las publicaciones especificados con anterioridad. Por lo general, este tipo de revisiones hacen estrictos controles para reducir la influencia de diferentes sesgos. El análisis de la información en las revisiones sistemáticas puede ser de dos tipos: cualitativo, o cuantitativo –este último mejor conocido como "meta-análisis"-.

El término de meta-análisis fue introducido por Glass en 1976, y se refiere al uso de métodos estadísticos sofisticados que permiten la combinación y análisis de los resultados obtenidos por diferentes estudios que examinan la misma pregunta, con el objeto de integrar los diferentes hallazgos. Aunque este término aparece con frecuencia ligado a la elaboración de revisiones sistemáticas, debe señalarse que son conceptos diferentes e independientes: una revisión sistemática puede incluir un meta-análisis, o no hacerlo. Ahora, cuando ello es posible se puede ganar mucho; al combinar la información de varios estudios pertinentes al tema de interés, se logra alcanzar estimaciones más precisas de los efectos que tendría implementar una intervención, que las logradas con la revisión de un solo estudio de investigación (Higgins y Green, 2011).

A pesar de la potencia de un meta-análisis es importante señalar algunas fuentes de error que suelen limitar, de forma importante, su alcance. En primer lugar, debe mencionarse el llamado sesgo de publicación, referido a que, en general, no existen, o son muy escasas, las publicaciones que reportan resultados negativos. En segundo lugar se debe indicar el sesgo de selección, que tiene lugar cuando el autor no define con precisión los criterios de inclusión o de exclusión, lo que lo lleva a cambiar los criterios de los estudios que son tenidos en cuenta. En tercer lugar, puede hablarse de los problemas de validez interna de los estudios; como se entiende, un meta-análisis no soluciona los problemas de calidad de los estudios primarios. Por último, deben anotarse los problemas derivados con la inadecuada selección de técnicas de análisis o de combinación de medidas (Marín, Sánchez, Huedo y Fernández, 2007). Con el propósito de disminuir los sesgos que afectan la calidad de los meta análisis se han propuesto varias estrategias, entre las que vale la pena mencionar la declaración Quorum (Quality of Reporting of Meta-Analyses) con sus 18 ítems, o la declaración PRISMA (Preferred Reported Items for Systematic Reviews and Meta-Analyses) con 27 ítems (Urrutia y Bonfill, 2010).

Hasta este punto, la distinción entre una revisión narrativa y una sistemática es clara. Sin embargo, una revisión de la literatura muestra que las posibilidades no se agotan en el planteamiento de esta dicotomía, sino que entre estos dos polos parecen existir varios tipos de revisiones de literatura que gradúan de forma mucho más fina el espectro de estudios. Específicamente, además de los dos anteriores, Davies (2000) señala tres nuevos tipos de revisión: 1) la revisión de conteo de votos, 2) la síntesis de la mejor evidencia, y 3) la llamada meta etnografía.

La revisión de conteo de votos puede ser un poco más sistemática que la narrativa, propone un método de síntesis un poco más sofisticado. El objetivo principal del método de conteo de votos es acumular los resultados que resulten estadísticamente significativos dentro un conjunto de estudios. En otros términos, se revisan los resultados que demuestren efectos, ya sean positivos, negativos o neutrales (Cook et ál., 1992). Así, la categoría que tenga el mayor número de votos se asume como aquella que representa los descubrimientos modales o típicos, con el fin de identificar cuál es la intervención más efectiva. Con relación a este tipo de revisiones se señalan dos dificultades. La primera se refiere a que el conteo de votos no podría predecir la posibilidad de que un tratamiento tuviese consecuencias diferentes en contextos o condiciones diferentes. La segunda es que pareciera que no se toma en cuenta la superioridad de unos estudios sobre otros, en términos de su diseño metodológico, lo cual los lleva a ignorar que algunos hallazgos podrían tener más peso que otros.

Por su parte, la síntesis de la mejor evidencia se diferencia de la anterior en la medida en que propone un criterio previo de inclusión de los estudios a revisar; criterio que se caracteriza por su claridad, consistencia y justificación. El interés por establecer criterios a priori está relacionado con el hecho de evitar sesgos por parte del revisor. En este orden de ideas se proponen algunas recomendaciones para la elaboración de este tipo de revisiones, entre las cuales está la importancia de considerar aquellos estudios cuyo objeto sea pertinente al propósito que ocupa la revisión, que su diseño metodológico minimice los posibles sesgos y que posean validez externa (Slavin, 1986). Este tipo de revisiones ya podrían ser consideradas, propiamente, revisiones sistemáticas.

Por último, debemos mencionar la meta-etnografía, que se propone resumir los descubrimientos de los estudios cualitativos, y especialmente de aquellos cuyo enfoque es etnográfico e interpretativo. Su método se encuentra fundamentado en la construcción de interpretaciones que permitan dilucidar analogías entre las diferentes explicaciones dadas acerca de un fenómeno social. Al respecto, Davies (2000) señala que este método podría estar muy cerca a las revisiones narrativas por el tipo de objetivo que persigue. Una de las limitaciones que se reconocen del método es la dificultad para establecer criterios de inclusión o exclusión de estudios, esto, debido, no solo a la amplitud y diversidad de preguntas y tópicos existentes en la investigación cualitativa, sino por la multiplicidad de las perspectivas teóricas desde las cuales se abordan tales preguntas.

Para terminar, y a fin de ilustrar el nivel de sistematicidad y rigor al que puede llegar una revisión sistemática vale la pena que examinemos el proceso definido para la elaboración de una revisión sistemática por la Colaboración Cochrane, en la medida en que puede ser el más detallado y riguroso del que tengamos noticia. En términos muy generales, este proceso puede ser esquematizado por medio de una metodología secuencial por pasos de la siguiente manera:

En primer lugar se debe formular el protocolo. Este es el plan, o serie de pasos, que deberán darse para desarrollar la revisión sistemática. En este protocolo se describe con precisión el propósito de la revisión, el tema sobre el cual trata la revisión y la estrategia que los autores usarán para llevar a cabo la revisión. El protocolo detalla también la forma en que se tratarán, seleccionarán y evaluarán críticamente los estudios, y la forma en que se recopilarán y analizarán los datos de los estudios incluidos. En la Colaboración Cochrane los protocolos deben registrarse y publicarse para que los interesados puedan conocerlos y comentarlos antes de que la revisión se lleve a cabo. De esta manera se reduce el impacto de sesgos de los autores, se fomenta la transparencia de los métodos y los procesos planteados, se disminuye la posibilidad de duplicación de estudios y se permite la revisión por pares de los métodos planificados (Higgins y Green, 2011).

Con el propósito de ayudar a los lectores a entender el estudio, guiar a los autores durante el recorrido y facilitar la publicación por vía electrónica se ha establecido un esquema de desarrollo que enumera los elementos que definen el protocolo para ser publicado en la base de datos de Cochrane.

Una vez publicado el protocolo no recomiendan modificarlo, pero si esto es imperativo se debe registrar cada cambio en la base de datos con el procedimiento de enmiendas establecido.

Hecho el protocolo inicia el proceso de elaboración de la revisión sistemática. De acuerdo con el modelo desarrollado por la Colaboración Cochrane, que resulta ser el más estructurado y de mayor tradición, aunque es de aplicación específica para las ciencias de la salud, estos pasos son:

- Formulación de la pregunta de revisión y desarrollo de criterios para incluir los estudios. La pregunta de la revisión debe seguir, en lo posible, un formato del siguiente tipo: -Evaluar los efectos de [intervención o comparación] para [problema de salud] en [tipos de personas, enfermedad o problema y lugar, si se ha especificado](Centro Cochrane Iberoamericano, 2012, p. 106). Al respecto de los criterios, se requiere definir el tipo de participantes, los tipos de intervención y desenlace y los tipos de diseño de estudio que se admitirán.

- Búsqueda de estudios. En el caso de la Colaboración Cochrane, este paso es asumido por la organización misma, a través de un coordinador de búsqueda de ensayos dedicado a dar este servicio. Se buscan los estudios publicados en las tres bases de datos más grandes del mundo: Central, MedLine y Embase.

- Selección de estudios y obtención de datos. Este punto es especialmente delicado por cuanto requiere identificar los diferentes informes correspondientes al mismo estudio y no considerarlos como diferentes estudios. Por lo general, en este paso se examinan títulos y resúmenes, se recupera el texto completo y se vinculan y reúnen los diferentes informes de los mismos estudios, para tomar decisiones definitivas sobre la inclusión de los estudios.

- Evaluación del riesgo de sesgo en los estudios incluidos. En este paso se hace una evaluación sistemática de la validez interna de los estudios incluidos en el paso anterior. Entre los sesgos más comunes que presentan los estudios clínicos están el sesgo de selección (de muestra y grupos), el sesgo de realización y de detección (controlables por cegamiento), el sesgo de desgaste (presente en estudios inconclusos) y el sesgo de notificación (es más probable notificar estudios con diferencias significativas que estudios sin ellas), entre otros. Existen herramientas que pueden hacer una evaluación sistemática del riesgo de sesgo.

- Análisis de datos y realización de meta-análisis. Mientras que en los estudios primarios los investigadores seleccionan y obtienen datos de muestras de individuos, en las revisiones sistemáticas los investigadores seleccionan y obtienen datos de los estudios primarios, combinándolos de diferentes formas. Los análisis pueden ser narrativos, como un resumen estructurado o una discusión de hallazgos, o pueden ser cuantitativos, e incluir análisis estadísticos. El meta-análisis, entendido como la combinación estadística de los resultados de dos o más estudios individuales, es la técnica más utilizada.

- Análisis del sesgo de informe. Estos surgen cuando la diseminación de los hallazgos de las investigaciones está influenciada por la naturaleza y por la dirección de los resultados (Higgins y Green, 2011). Este sesgo, que puede resultar crítico en una revisión sistemática, puede ser disminuido con la selección de buenos criterios de elegibilidad de los estudios y con la inclusión de ensayos no publicados (literatura gris). En este paso es importante detectar la presencia de este tipo de sesgos, para lo cual se dispone de diferentes herramientas estadísticas.

- Presentación de los resultados y las tablas resumen de los resultados. Interpretación de los resultados y obtención de las conclusiones. Se recomienda la presentación de los resultados haciendo uso de algunas técnicas desarrolladas, como los diagramas de flujo (modelos Prisma), los diagramas de bosque, gráficos de embudo y otros. En general, se enfatiza la elaboración de conclusiones claras, con implicaciones para la práctica y para la investigación.

Siguiendo este esquema para revisiones sistemáticas a octubre del 2013, Cochrane tenía publicadas 5.737 revisiones sistemáticas y registrados 2.351 protocolos2.

Desarrollo del enfoque

Con el fin de examinar la dinámica del tema de la educación basada en la evidencia, se hizo una pequeña revisión de las publicaciones presentes en las bases de datos de artículos científicos. Como se entiende, esta revisión es más un pequeño estudio bibliométrico que una revisión sistemática, en tanto pretendemos describir el desarrollo de las publicaciones científicas sobre el tema de la educación basada en la evidencia, más que responder a una pregunta de investigación.

Se tomaron la totalidad de las publicaciones incluidas en la base de datos ProQuest, a enero de 2014. A fin de buscar las publicaciones, se utilizó, en primer lugar, como criterio de búsqueda, cualquier publicación, incluida en cualquiera de las diez bases de datos agrupadas en ProQuest, que respondiera al criterio de búsqueda evidence-based-education OR evidence-basedpedagogy en cualquier parte del texto, sea este el cuerpo del artículo, el título, el resumen o las palabras claves3. Esta primera búsqueda arrojó un total de 1015 publicaciones, la primera de las cuales aparece fechada en el año 1995 y la última en 2014.

Unas líneas son necesarias para justificar la clave de búsqueda. La expresión evidence-based es ya una expresión acuñada, que tiene identidad semántica propia y presencia identificable en las publicaciones, y muy especialmente aquellas del área de la salud. Cuando esta expresión se yuxtapone, en orden estrictamente secuencial, con las expresiones education o pedagogy podemos estar bastante seguros de que en la publicación identificada se trató explícitamente el tema que nos convoca, y que no se han incluido los artículos específicos sobre la medicina basada en la evidencia que no traten el tema en la educación.

La inclusión diferenciada de una disyunción de dos términos, el primero que toma la educación basada en la evidencia y el segundo que toma la pedagogía basada en la evidencia intentaba cobijar las expresiones más comunes e incluir diferentes énfasis teóricos. El resultado muestra que la enorme mayoría de las 1015 publicaciones referenciadas optaron por el uso del término evidence-basededucation: 979 (96,5%); solo 37 publicaciones (3,5%) optaron por el uso del término evidence-basedpedagogy y solo una (1) publicación usa las dos acepciones.

La figura 1 presenta el número de publicaciones encontradas en esta primera revisión por año de publicación. Tal y como se observa, es notorio un incremento continuo y persistente del número de publicaciones desde 1995 hasta el año 2014, en el que se encontraron 11 publicaciones. Sin duda, es notorio el incremento vertiginoso, especialmente en los últimos años, del interés académico sobre el tema de la educación basada en la evidencia.

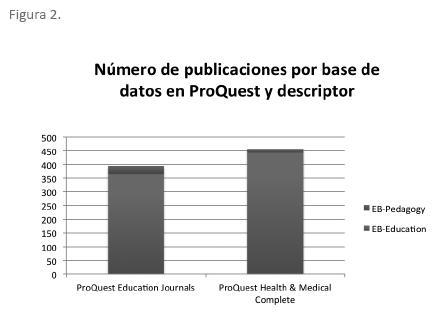

A partir de este universo de 1015 publicaciones es posible reducir el espectro de búsqueda de diferentes formas. En primer lugar, puede ser interesante examinar la pertenencia de estas publicaciones a las diferentes bases de datos agrupadas en ProQuest. En efecto, si restringimos las publicaciones a las contenidas en las bases de datos de educación (ProQuest Education Journals) y medicina (ProQuest Health y Medical Complete), el universo inicial de 1015 publicaciones se reduce apenas a 735 publicaciones, lo que representa 72.4% del total.

Es interesante notar que, si se hacen búsquedas independientes en las bases de educación y medicina, la mayor proporción de artículos sobre el tema aparece en las bases de medicina, y no en las de educación. En efecto, se encuentran 394 publicaciones contenidas en las bases de educación y 443 en las de medicina. Es evidente en estos datos la importancia del tema de la educación basada en la evidencia para publicaciones del área de la medicina. Algunas publicaciones son categorizadas en las dos bases de datos lo que explica que la suma de las publicaciones de las dos bases supere el total inicial (figura 2).

De cualquier forma que se mire, tenemos razonable seguridad de que las 1015 publicaciones que constituyen nuestro universo inicial, independientemente del área que representan, tratan, efectivamente, el tema de la educación basada en la evidencia. Como ya se ha dicho, y en este caso se vuelve a hacer patente, es verdaderamente notoria la contribución de las publicaciones del área de la medicina al tema educativo (Hederich,2013).

Además de lo ya anotado, de la gráfica 2 es interesante observar que la expresión evidence-based-pedagogy está mucho más presente, tanto en téminos absolutos como relativos, en las publicaciones propiamente educativas. Esto hace pensar que el tema propiamente pedagógico resulta más cómodamente abordado en las publicaciones educativas, mientras que las del área de la medicina y la salud mantienen la reflexión sobre aspectos más generales del orden político, que quedan mejor descritos por el término educación que por el de pedagogía, que se refiere a relaciones más cercanas e identificables.

Continuando ahora con el universo reducido de 394 publicaciones de las bases de datos educativas, es interesante centrarla mirada en aquellas que utilizan nuestra disyunción de descriptores en el resumen o incluso, en el título del trabajo. Al respecto, son 38 los trabajos que mencionan la expresión en el resumen, y 19 en el título mismo del artículo. Estas últimas, con seguridad, tratan el tema de la educación (o la pedagogía) basada en la evidencia, como tema central del trabajo. Anexo al presente artículo se entregan las referencias de estas 19 publicaciones.

No es mucho más lo que se puede hacer para describir este pequeño segmento de publicaciones. Cinco de estas publicaciones son revistas inglesas y 14 son norteamericanas. No hay una publicación que agrupe más de un artículo con estos títulos. A pesar de haber restringido de forma tan tajante las bases de datos a aquellas específica-mente educativas, encontramos que 6 de las 19 publicaciones referenciadas tratan, específicamente, de temas de la educación en ciencias de la salud: Journal of Nursing Education, The Journal of Health Administration Education, The Gerontologist, The Journal of Continuing Education in Nursing, Medical Teacher y Advances in Physiology Education. Sigue haciendo una fuerte y positiva presencia la educación médica en la reflexión educativa.

Consideraciones para consolidar una EBE

Hasta este momento se han explorado los orígenes de los planteamientos de la educación basada en la evidencia, sus desarrollos y sus principales limitaciones. Este recorrido ha permitido identificar las relaciones, en términos de diferencias y similitudes, establecidas entre la medicina y la educación, como prácticas profesionales basadas en la evidencia. Gracias a esto, se tiene un panorama más claro de los avances hasta el momento hechos para construir una EBE y lo que haría falta para consolidarla. Con el propósito de ampliar dicho panorama parece importante, en primer lugar, valorar los aportes de la MBE, especialmente en lo que respecta a la evaluación de la mejor evidencia y a la síntesis y sistematización de la producción científica. En segundo lugar, sobre la base de las especificidades y particularidades de la educación y la investigación educativa, es preciso analizar algunos aspectos que, hasta el momento, no se han resuelto tan claramente, tales como la contribución de la investigación cualitativa a la evidencia, la definición de la mejor evidencia en educación, la necesidad de incrementar el número de revisiones sistemáticas y por ende, el número de revistas especializadas indexadas como pasos hacia la consolidación del vínculo entre la práctica profesional del maestro y la investigación educativa.

Al mirar las especificidades de la educación saltan a la vista las características propias de los estudios de investigación en educación. Son estudios multidimensionales que se desarrollan desde un enfoque cualitativo y que por ende son difícilmente replicables. Dicho esto, es claro que se requiere diseñar un sistema valorativo que determine la contribución de este tipo de estudios al acopio de evidencia disponible. En este orden de ideas, se requeriría que la evidencia proporcionada por la investigación cualitativa fuese sintetizada y sistematizada con el mismo rigor con el que se hace en el caso de estudios de corte empírico-analítico. Sin dudas, esto conlleva la urgencia de establecer un conjunto de criterios claros que posibiliten identificar como válida, fiable y relevante la evidencia obtenida de los estudios con enfoque cualitativo.

Con el propósito de identificar el rigor de los estudios cualitativos, diferentes a los pensados para los estudios de tipo empírico, Lincoln y Guba (1985) propusieron cinco criterios, sobre los cuales los estudios cualitativos pueden ser examinados: 1) fiabilidad , 2) credibilidad, 3) transferibilidad, 4) confirmabilidad y 5) confiabilidad.

- La fiabilidad se refiere a la confiabilidad general y a la validez de la investigación.

- La credibilidad alude a la idoneidad y la exactitud del origen de los datos y su interpretación. En ocasiones, los investigadores utilizan múltiples entrevistas con los mismos informantes con el propósito de mejorar la credibilidad de los datos.

- La transferibilidad se relaciona con la idea de la representatividad y está asociada a los límites contextuales de los resultados. Este criterio se presenta por el hecho de que la investigación cualitativa, más que priorizar la generalización de sus resultados, se propone responder preguntas contextual o localmente relevantes, en este sentido, se requiere que el investigador examine con atención las condiciones necesarias para que los resultados de un estudio puedan ser transferibles.

- La confirmabilidad, por su parte, es similar a la idea de replicabilidad, aunque la primera se logra, en el contexto de la investigación cualitativa, gracias al rigor con el que el investigador presente el desarrollo metodológico y los resultados de su estudio, de tal suerte que estos puedan ser analizados en detalle por otros investigadores.

- La confiabilidad se refiere a la veracidad de los procedimientos de codificación establecidos por el investigador. Por lo general, se establecen procesos semejantes a las auditorías, para hacer revisiones permanentes de estos aspectos.

El problema de la evaluación de la evidencia aportada por la investigación cualitativa también ha sido abordado por otras organizaciones que han orientado sus esfuerzos a sintetizar y sistematizar los resultados de este tipo de estudios. La primera de estas es la Colaboración Campbell que ha venido adelantando un juicioso trabajo en la elaboración de revisiones sistemáticas sobre los efectos de las intervenciones sociales y educativas. También se encuentra la propuesta de la Subcomisión de Investigación Cualitativa Interdisciplinar (IQRS) del Grupo de Trabajo de Intervenciones Basadas en la Evidencia en Psicología Educativa (financiados por la Sociedad de Estudios en Psicología Educativa y la División de Psicología Educativa de la APA), que ha venido aportando en la determinación de criterios para codificar los métodos de investigación cualitativa (Nastasi y Schensul, 2005). Ambas organizaciones deben considerarse como un gran avance hacia la posibilidad de determinar el verdadero impacto de la evidencia proporcionada por este tipo de estudios.

En este punto, insistir entonces, en la polarización establecida entre la investigación cualitativa y la cuantitativa parece inapropiado en la medida en que se entiende que ambas aportan para la construcción de evidencia de alta calidad. Al respecto, es claro que los datos proporcionados por los estudios de corte empírico, si bien pueden demostrar la efectividad de una intervención educativa determinada, no siempre garantizan que se den los mismos resultados al intentar replicar el estudio en otro contexto y con una muestra diferente. El aporte de la investigación cualitativa acá es realmente importante, en la medida en que esta podría responder a cuestiones asociadas con la validez social y ecológica del estudio y con sus implicaciones culturales.

Aun así, se quiere llamar la atención sobre tres aspectos fundamentales para considerar los aportes de los estudios cualitativos a la EBE: El rigor metodológico, el carácter acumulativo del conocimiento y la contrastación de los resultados. En relación con el rigor metodológico, se requiere que se formulen estudios bien definidos, que cumplan con los criterios de validez esperados. Así, se espera que los diseños expresen a cabalidad las características propias de su paradigma. En segundo lugar, el conocimiento que se produzca en cada estudio debería servir como base para formular otros estudios y ampliar una línea de conocimiento, en este sentido, se defiende la posibilidad de que el conocimiento producido por los estudios cualitativos sea en alguna medida acumulativo. En tercer lugar, en cuanto a la contrastación de los estudios, se pretende que a partir de réplicas se ponga a prueba la evidencia producida por los diferentes estudios. Visto de esta manera, la réplica está dirigida a la validación de los estudios, en la medida en que aporta, da matices, muestra diferencias y aspectos relevantes a considerar. Además, permite que los estudios sean contrastables e introduce variaciones significativas en el conocimiento producido.

En lo que concierne a la síntesis y sistematización de la producción científica educativa parece importante impulsar la realización de un mayor número de estudios de revisión sistemática que permitan hacer un balance preciso sobre el conocimiento científico existente y las necesidades reales de investigación educativa, esto con el propósito de generar los recursos adecuados para direccionar la toma de decisiones en educación. Resulta entonces necesario fortalecer la participación de los grupos de investigación en educación en redes colaborativas tipo "Campbell" o The What Works Clearinghouse4 que promuevan y difundan la elaboración de revisiones sistemáticas en investigación educativa.

Por otra parte, establecer una cultura de práctica educativa basada en la evidencia a través de la elaboración de estudios juiciosos de revisión sistemática, representa una oportunidad para que una mayor cantidad de profesionales en educación tengan conocimiento sobre la producción científica en educación por medio de estrategias masivas de acceso y divulgación. En esa dirección, se reconoce la importancia y la necesidad de que los profesores accedan con mayor facilidad a la información de la mejor evidencia sobre la eficacia de intervenciones, prácticas o programas desarrollados en el contexto de la investigación. Sin embargo, no se puede ignorar la dificultad que esto pueda representar en la medida en que resulta abrumador acceder a todos los estudios existentes frente algún tópico en especial, sin tener una certeza de qué tan efectiva pueda ser la intervención. De ahí que se defienda la idea de promover la elaboración y difusión de revisiones sistemáticas como un recurso esencial para evaluar la calidad de las investigaciones, para sintetizar y sistematizar los estudios y para difundir los resultados de manera ordenada y resumida, con el fin de proveer la mejor evidencia sobre lo que funciona o no en educación.

Además de la idea de promover el incremento de las revisiones sistemáticas de la investigación educativa, surge la necesidad de incrementar el número de publicaciones especializadas relacionadas con la producción científica en el campo de la educación. Esto representa un reto para la profesión, pues en comparación con los logros de la medicina, el número de publicaciones científicas en educación, en revistas indexadas, es bastante menor.

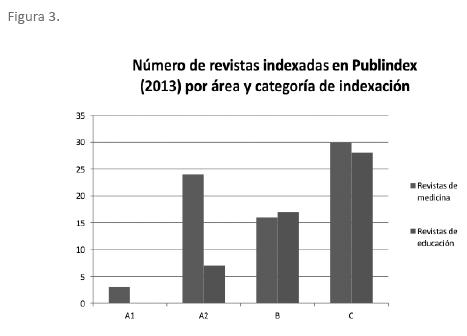

Para ilustrar este punto, en el caso específico colombiano, de las revistas indexadas en Publindex por Colciencias en el año 2013, se encontró un total de 73 revistas indexadas en medicina, y solo 52 en educación.

Los niveles de indexación son claramente diferentes en las dos disciplinas: mientras que en medicina, en los niveles superiores (A1 y A2) aparecen 27 revistas médicas, en educación estas son apenas 7, todas en A2 (Figura 3).

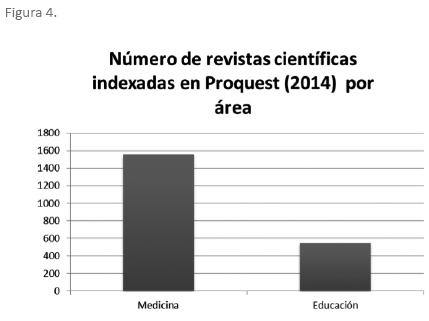

En un contexto más amplio, al relacionar el número de publicaciones científicas en las bases de datos internacionales se encuentra también una gran diferencia entre las revistas relacionadas con medicina y con educación. Un ejemplo de esto se evidencia en la base de datos ProQuest que cuenta en el año 2014 con un total de 7101 revistas científicas indexadas de las cuales 1560 (21,96%) corresponden al área de la salud y solo 548 (7,71 %) corresponden a temas relacionados con educación (Figura 4).

Por otro lado, un aspecto que ya se mencionó pero en el cual se quiere hacer énfasis es el vínculo entre la práctica profesional y la investigación científica que, tal y como lo presentaba Hargreaves (1997), en la educación aún es bastante débil. Se sabe que a pesar de que los profesores tienen un amplio conocimiento práctico, su conocimiento científico es escaso y tiene un impacto pobre en la toma de decisiones. En ese sentido, parece necesario y urgente pensar e implementar la evidencia científica en educación como un complemento que enriquezca la toma de decisiones y el actuar del profesional, esto sin la intención de desvirtuar la experiencia personal o los intereses y necesidades de los estudiantes y sus comunidades. Sin duda, se requiere entonces de una participación más activa de toda la comunidad educativa como productores o consumidores de evidencia científica.

Si bien, al manifestar la necesidad de fortalecer los vínculos entre práctica e investigación no se está defendiendo la idea de que lo único que deba considerarse válido y deba ser tenido en cuenta para la toma de decisiones en la práctica sea la evidencia científica, la intención sí es reivindicar su rol en este contexto. En otras palabras, lo que se espera es que los resultados de la producción científica en educación sean ampliamente difundidos entre la comunidad y en consecuencia, tengan un impacto significativo en la toma de decisiones en las prácticas educativas. Esto significaría un cambio importante en la generación y evaluación de prácticas, programas y desarrollos educativos, en la medida en que estos se pensarían a partir de la integración de tres fuentes de conocimiento para la toma de decisiones educativas: la experiencia de los profesores, la evidencia científica y los intereses y necesidades de los estudiantes.

La propuesta actual es usar la mejor evidencia disponible para tomar decisiones en educación sin desconocer la experiencia del profesor y las características individuales y contextuales de los estudiantes. Pero, ¿cómo hacer esto? En primer lugar, se debe caracterizar de la forma más precisa posible las poblaciones, sus problemas y los aspectos socioculturales involucrados. En segundo lugar, consultar y jerarquizar la información disponible en las bases de datos que ofrezcan la mejor evidencia respecto al problema en cuestión y, finalmente, combinar estos dos aspectos con la experiencia que el educador tiene en este tipo de circunstancias. Es importante aclarar que ninguno de los tres componentes del modelo es más importante que otro y que todos son indispensables. Como lo muestra la figura 5, se requiere una interacción recíproca y equilibrada de los tres componentes al momento de tomar una decisión.

Con esto queda plasmada la intención de alejarse de la eventual deshumanización de la práctica profesional en educación. Se quiere hacer énfasis en que no tiene sentido enfrentar la experiencia y la evidencia en la medida en que son complementos que pueden enriquecerse mutuamente, aunque sí se recomienda dejar de forma explícita cómo se está integrando la evidencia a la toma de decisiones. Es justamente ahí donde la experiencia entra en juego, ya que permite orientar el buen criterio a la hora de utilizar la evidencia y con esto evitar su uso acrítico.

Los intereses de los estudiantes deberían ser aspectos claves y muchas veces determinantes directos de las decisiones educativas en la medida que representan los aspectos afectivos y motivacionales relacionados con el proceso de aprendizaje. Entre estos se cuentan, sin ser los únicos, el valor que el estudiante le otorga a la tarea de aprendizaje, la utilidad que esta representa para su progreso y sus sentimientos de autoeficacia y confianza frente a la meta, determinantes todos de la regulación del esfuerzo y la capacidad de automotivación. Se sabe que los estudiantes auto-motivados o con motivación intrínseca tienen mejores logros académicos (Pintrich, DeGroot y García, 1992).

Sobre las necesidades de los estudiantes, en general estas se determinan por su contexto social, en este sentido se resalta la visión del aprendizaje como resultado de un proceso de enculturación que le permite a los individuos dar respuesta a las expectativas implícitas y explícitas de la comunidad a la que pertenecen. En este sentido se resalta que solo a partir de la interacción dialógica entre el estudiante y su círculo social (profesor incluido) es posible lograr la apropiación de prácticas y la construcción conjunta de los saberes que realmente se necesitan (Díaz, 2003).

Síntesis y conclusiones

El planteamiento de una educación basada en la evidencia surge como una transferencia de la experiencia desarrollada en la medicina, y muestra buenas posibilidades de realización debido a las similitudes evidentes entre los dos campos. Entre estas se destacan: 1) en sus orígenes, las dos profesiones fueron consideradas como oficios, más cercanos al arte que a la ciencia, que requerían vocaciones y dones especiales para los iniciados que las dispensaban; 2) los practicantes en ambos campos son profesionales aplicados haciendo intervenciones con implicaciones trascendentes en las vidas de otros; y 3) la práctica profesional de ambos está centrada en la toma de decisiones elaboradas en el momento sobre la base de información compleja, más que en el seguimiento de reglas claras y simples.

Existen, sin embargo, diferencias importantes entre los dos campos relacionadas con 1) la naturaleza de la investigación hecha en el campo de la educación, que difiere de la hecha en el ámbito de la medicina; 2) las relaciones entre el conocimiento científico y la práctica profesional; 3) la cantidad de trabajos de investigación que aporten evidencia científica; y, como consecuencia del anterior, 4) el número y tipo de órganos de publicación y difusión de la investigación. Estas diferencias ameritan el planteamiento de criterios nuevos y diferentes para valorar la calidad de la evidencia aportada por la investigación educativa, que considere sus particularidades distintivas.

La transferencia de la experiencia de la medicina basada en la evidencia a la educación ha conllevado la institucionalización del proceso de elaboración de revisiones sistemáticas en redes colaborativas, tales como la Colaboración Campbell -réplica cercana de la Colaboración Cochrane en la medicina-. La conformación de este tipo de redes ha representado un impulso claro a la sistematización y organización de la, aún incipiente, producción científica en el campo educativo y al fortalecimiento de la posibilidad de que el profesional de la educación empiece a considerar el conocimiento científico en la toma de decisiones. Se espera que el impacto de esto sobre la calidad de la educación sea semejante al logrado en el ámbito de la medicina sobre el bienestar de los pacientes.

Aunque queda claro el rol de la evidencia en la toma de decisiones particulares, su alcance va aún más allá, en la medida en que puede afectar de manera muy positiva las decisiones institucionales y gubernamentales y, en general, la política educativa. Este tema no fue específicamente abordado en el presente artículo, pero debe anotarse que existen diferentes organizaciones dedicadas a dar una base empírica a la toma de decisiones en estos niveles. Precisamente ésta era la perspectiva original de D. Campbell: la consideración de que la política debía ser vista como ámbito de experimentación social y, por tanto, debía estar sujeta a las reglas que rigen la evidencia científica. Este proyecto, al parecer, continúa vigente. Esperemos que trabajos como el presente contribuyan a mantenerlo en la memoria para su desarrollo.

Pie de página

1The Teacher Training Agency (TTA) fue la institución responsable de la formación inicial de profesores en Inglaterra hasta el 2005, año en que se convirtió en la Training and Development Agency for Schools (TDA)

2Ver http://www.cochrane.org/cochrane-reviews/cochrane-database-systematic-reviews-numbers

3Las bases de datos agrupadas en la plataforma de PROQUEST son: ABI/Inform, Arts & Humanities Full Text, ProQuest Biology Journals, ProQuest Computing, ProQuest Health & Medical Complete, ProQuest Nurse & Allied Health Source, ProQuest Psychology Journals, ProQuest Research Library y ProQuest Science Journals.

4El What Works Clearinghouse (WWC) fue fundado en 2002 como una iniciativa del Instituto de Ciencias de la Educación del Departamento de Educación en los Estados Unidos. Este es administrado por el Centro Nacional de Evaluación Educativa y su objetivo central es servir como recurso para la toma de decisiones educativas en la nación. Para acceder a sus recursos consultar http://ies.ed.gov/ncee/wwc/.

Referencias bibliográficas

Centro Cochrane Iberoamericano (traductores) (2012). Manual Cochrane de Revisiones Sistemáticas de Intervenciones, versión 5.1.0 [actualizada en marzo de 2011] [Internet]. Barcelona: Centro Cochrane Iberoamericano. Recuperado de: http://www.cochrane.es/?q=es/node/269. [ Links ]

Cochrane Database of Systematic Reviews (s.f.). Total Cochrane Reviews and Protocols. Recuperado de: http://www.cochrane.org/cochrane-reviews/cochrane-database-systematicreviews-numbers. [ Links ]

Beltrán, O. (2005). Revisiones sistemáticas de la literatura. Revista Colombiana de Gastroenterología 20(1), 60-69. [ Links ]

Berg, R.C. y Denison, E. (2012). Interventions to reduce the prevalence of female genital mutilation/cutting in African countries. Campbell Systematic Reviews 2012:9. DOI: 10.4073/csr.2012.9. [ Links ]

Cook, T.D., Cooper, H., Cordray, D.S., Hartmann, H., Light, R.J., Louis, T.A. y Mosteller, F. (1992) Meta-Analysis for Explanation. Nueva York: Russell Sage Foundation. [ Links ]

Davies, Ph. (2000). The Relevance of Systematic Reviews to Educational Policy and Practice. Oxford Review of Education 26(3 y 4), 365-378. DOI: 10.1080/3054980020001882. [ Links ]

Díaz B., F. (2003). Cognición situada y estrategias para el aprendizaje significativo. Revista Electrónica de Investigación Educativa 5(2). Recuperado el 30 de enero del 2014 de: http://redie.ens.uabc.mx/vol5no2/contenido-arceo.html. [ Links ]

Druss, B.G. (2005). Growth and decentralization of the medical literature: implications for evidence-based medicine. J Med Libr Assoc. 93(4), 499-501. [ Links ]

Farrington, D.P. y Ttofi, M.M. (2009). School-Based Programs to Reduce Bullying and Victimization. Campbell Systematic Reviews 2009:6. DOI: 10.4073/csr.2009.6. [ Links ]

Glass, G.V. (1976). Primary, secondary and meta-analysis of research. Educational Researcher 5, 3-8. [ Links ]

Gott, R.; Duggan, S. y Roberts, R. Concepts of Evidence. University of Durham Recuperado el 27 noviembre de 2013 de: http://www.dur.ac.uk/richard.gott/Evidence/cofev.html. [ Links ]

Guyatt, G. (ed.). (2008). Users' Guides To The Medical Literature A Manual For Evidence-Based Clinical Practice. 2a. ed. Ontario: The McGraw-Hill Companies. [ Links ]

Hammersley, M. (1997). Educational Research and Teaching: a response to David Hargreaves´TTA lecture. British Educational Research Journal 23(2), 141-161. [ Links ]

Hargreaves, D. H. (1996). Teaching as a research-based profession: possibilities end prospects. The Teacher Training Agency, Anual Lecture. [ Links ]

Hargreaves, D. H. (1997). In Defense of Research for evidence based Teaching: a rejoinder to Martin Hammersley. British Educational Research Journal 23(4), 405-419. [ Links ]

Hederich, C. (2013). Estilística educativa. Revista Colombiana de Educación, 64, 21-56. [ Links ]

Higgins, J.P.T. y Green, S. (eds.) (2011). Cochrane Handbook for Systematic Reviews of Interventions Version 5.1.0 [actualizado en marzo de 2011]. The Cochrane Collaboration, 2011. Disponible en http://www.cochrane-handbook.org. [ Links ]

Letelier, L.M. y Moore, P. (2003). La medicina basada en evidencia. Visión después de una década. Rev. Méd. Chile; 131, 939-946. [ Links ]

Lewin, K. (1946/1948). Action research and minority problems. En: G.W. Lewin (ed.), Resolving social conflicts (pp. 201-216). Nueva York: Harper & Row. [ Links ]

Lincoln, Y.S. y Guba, E.G. (1985). Naturalistic Inquiry. Thousand Oaks, CA: Sage. [ Links ]

Marín, F.; Sánchez, J.; Huedo, T. y Fernández, I. (2007). Metaanálisis: ¿Dónde estamos y hacia dónde vamos? En: A. Borges y P. Prieto (eds.), Psicología y ciencias afines en los albores del siglo XXI (pp. 87-101). La Laguna, Tenerife: Grupo Editorial Universitario. [ Links ]

Manterola, C. y Zavando, D. (2009). Cómo interpretar los "Niveles de Evidencia" en los diferentes escenarios clínicos. Revista Chilena de Cirugía 61( 6), 582-595 [ Links ]

Nastasi, B.K. y Schensul, S. (2005). Contributions of qualitative research to the validity of intervention research. Journal of School Psychology, 43, 177-195. [ Links ]

Nye, C.; Schwartz, J. y Turner, H. (2006). Approaches to Parent Involvement for Improving the Academic Performance of Elementary School Age Children. Campbell Systematic Reviews 2006:4. DOI: 10.4073/csr.2006.4. [ Links ]

Petrosino, A.; Guckenburg, S. y Fronius, T. (2013). Policing Schools Strategies to Reduce Crime, Increase Perceptions of Safety, and Improve Learning Outcomes in Primary and Secondary Schools. Campbell Systematic Reviews 2013. [ Links ]

Pintrich, P.R.; DeGroot, E. y García, T. (1992). Student Motivation and Self-Regulated Learning in Different Classroom Context. Paper presented at the International Congress of Psychology. Bruselas. [ Links ]