I. Introducción

De acuerdo con la Organización Mundial de la Salud, en el 2016 se presentaron 1.35 millones de muertes relacionadas con accidentes de tráfico [1], esto evidencia que la accidentalidad vehicular es un problema de interés mundial; de tal modo que evitar accidentes, disminuir la congestión vial y mejorar la experiencia de usuario en la conducción son temas de interés internacional [2]. En años recientes se ha incrementado la inclusión de diversos tipos de sensores en los vehículos, buscando monitorizar el ambiente alrededor y proporcionando al conductor información que ayude a mejorar la experiencia de conducción y la seguridad de los ocupantes. Investigaciones preliminares han propuesto diversos métodos y técnicas para ayudar en las tareas que debería realizar un asistente vehicular para garantizar una conducción segura [2, 3, 4, 5, 6, 7, 8, 9].

Dichas propuestas se basan en el uso de tecnologías de adquisición de imágenes mediante radar, las cuales se obtienen con sensores de alta resolución o sensores con diseños especiales para las tareas requeridas, así como, la utilización de complejos algoritmos computacionales como las redes neuronales profundas [4, 10, 11]. Sin embargo, en países en vías de desarrollo, la adquisición de vehículos con este tipo de sistemas es baja, debido a los altos costos de producción y adquisición que ello implica. Adicionalmente, algunos de estos vehículos al llegar a estos países no cuentan con el soporte requerido debido a la incompatibilidad de su sistema con las condiciones y entornos ambientales del país.

Por otra parte, es bien conocido en el mundo de las redes neuronales profundas, que aunque tiene precisiones altas en sus tareas, también la optimización de su entrenamiento se ha convertido en un tema clave para la comunidad científica, algoritmos basados en neuro-evolución, que modifican los pesos de la red, su arquitectura o parámetros [12, 13] e implementaciones de nuevos optimizadores del gradiente descendente [14] han sido llevados a cabo para mejorar las métricas de evaluación, lo que demuestra que se debe invertir un tiempo considerable para tener resultados adecuados.

La visión por computadora combina un amplio rango de tecnologías para proveer respuestas útiles, muchas veces a bajo costo computacional, a partir de la adquisición y el análisis de imágenes [15], puede ser usada para la localización, la clasificación y el seguimientos de objetos, mediante la extracción de características y su posterior análisis. En este campo, existe una variada colección de técnicas que posibilitan su uso con cualquier tipo de imagen que muestre de manera suficientemente clara el objeto o los patrones de interés.

Con esto en mente, nuestra investigación busca la implementación de un sistema de asistencia a la conducción capaz de detectar y reconocer señales de tránsito, objetos en la vía y detección de carril, mediante el uso de una cámara RGB de mediana resolución. De manera que el sistema sea asequible en países en desarrollo y adicionalmente, pueda ser adaptado a cualquier tipo de vehículo. Además, busca que su costo computacional, tanto en el entrenamiento como en su puesta en marcha, sea de bajo consumo.

El documento se integra de la siguiente manera: se describen los módulos que componen el sistema. Posteriormente, se presentan los resultados obtenidos y el análisis; finalmente, se refieren las conclusiones y la propuesta de trabajos a futuro.

II. Métodos

El sistema de asistencia puede ser visto como la unión de cinco módulos que, al funcionar cohesivamente, logran detectar y reconocer las señales de tránsito preventivas y reglamentarias, detectar el carril, la dirección de la curva y los obstáculos que sobresalen en el camino. Cada módulo se programa con el uso de técnicas de visión por computadora basadas en detecciones de características (Características Haar), detección de líneas, gradientes y operaciones morfológicas, permitiendo que el sistema tenga un costo computacional mucho menor que algoritmos complejos como las redes neuronales convolucionales profundas.

A. Detección de señales de tránsito: reglamentarias y preventivas

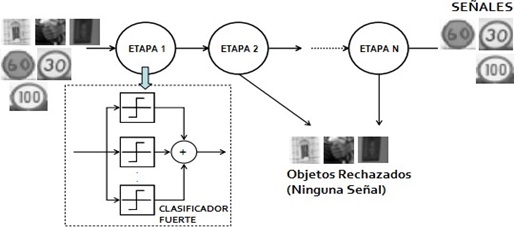

Este módulo se desarrolló teniendo en cuenta los clasificadores Haar [16], los cuales se basan en el uso de las Características Haar, es decir, núcleos de convolución que se aplican sobre las imágenes, obteniendo pesos en un sistema experto que permita la detección del objeto de interés. Las Características Haar fueron introducidas por Viola y Jones [17] y consisten en la unión de varios clasificadores fuertes en forma de cascada formados a partir de clasificadores débiles. Se ha hecho uso de este tipo de clasificadores en distintos ambientes, obteniendo buenos resultados [16, 18]. Una manera gráfica de representar el clasificador implementado por Viola y Jones se muestra en la Figura 1. Cada Etapa hace referencia a un clasificador fuerte, que es la unión de múltiples clasificadores débiles, la unión de estos clasificadores fuertes se conoce como clasificador en cascada.

Viola y Jones [17] proponen y usan en su clasificador las características tipo 1, 2 y 5 con orientaciones vertical y horizontal. Posteriormente, añaden a este sistema dos nuevos tipos de características: tipo 3 y 4 [19], además, remueven la característica tipo 5 y añaden dos nuevas orientaciones diagonales (45° y 135°), mejorando enormemente el método discriminatorio Adaboost y aumentando su robustez. Las Características Haar funcionan bajo el principio de la transformada de wavelet, esta permite la observación y medición en el plano Tiempo-Escala de la señal debido a que la escala tiene una relación inversamente proporcional a la frecuencia [20].

El clasificador mostrado en la Figura 1 utiliza una serie de imágenes digitales con una forma geométrica definida para realizar las comparaciones detectando los objetos de interés como señales de tránsito; tales características son capaces de acoplarse a las sub-ventanas obtenidas de la imagen, es decir, las características actúan como un cuadro limitador cuyo objetivo es descartar, mediante zonas, la presencia del objeto en toda la imagen adquirida por el sistema de captura. El clasificador se entrenó usando 4000 imágenes positivas de señales reglamentarias, 4000 imágenes positivas de señales preventivas y 8000 imágenes negativas.

B. Reconocimiento de señales de tránsito reglamentarias y preventivas

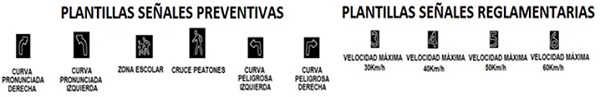

Actualmente, Colombia cuenta con 180 señales de tránsito, de las cuales 66 son preventivas, 51, reglamentarias y 63 pertenecen al grupo de señales de tránsito informativas. Esta investigación se enfocó en el reconocimiento de un solo tipo de señal reglamentaría conocida como señal de velocidad máxima permitida. Adicionalmente, el sistema reconoce seis tipos de señales preventivas (ver Figura 3.). No obstante, el sistema es capaz de detectar correctamente todas las señales reglamentarias que poseen forma circular y las señales preventivas con forma de rombo, para que el sistema sea capaz de reconocer todas las señales que poseen estas geometrías se deberán anexar las plantillas correspondientes a la base de datos del sistema. Para incluir otro tipo de señales de tránsito que no conserven las formas anteriormente expuestas debe ser entrenado un nuevo clasificador Haar.

Las imágenes detectadas por el clasificador entrenado fueron segmentadas [21], como se observa en la Figura 2, usando múltiples algoritmos de segmentación y extracción de bordes para asegurar los mejores resultados posibles. Para ello se usó la librería de visión por computadora OpenCV [22] que implementa un conjunto de funciones para llevar a cabo este proceso.

Como primer enfoque del sistema de asistencia, se escogieron las señales de tránsito presentadas en la Figura 3, debido a que se consideran las más comúnmente observadas en las vías colombianas.

Existen múltiples algoritmos de reconocimiento, implementados en la librería OpenCV: Métodos de reconocimiento mediante comparación de histogramas [23], Algoritmos EMD [24], Propagación de Fondo [25] y el método correspondencia de plantilla [26]. Este último fue escogido para el desarrollo de este módulo, teniendo en cuenta que el objetivo es desarrollar un sistema de bajo coste computacional. Cabe mencionar que el número de señales reconocidas por el sistema pueden ser incrementado usando la plantilla adecuada para cada nueva señal que se desee agregar. En la Figura 4 se muestran las plantillas utilizadas.

En la Figura 4 se usan pequeños recortes a los cuales se les han aplicado los procesos de segmentación, extracción y detección de bordes a partir del algoritmo de Canny [27], lo cual facilita la tarea de correspondencia. De igual manera, este mismo proceso se aplica a las regiones de las imágenes capturadas por el sistema donde nuestro clasificador ha detectado una señal de tránsito.

C. Detección de carril y dirección de curvas

El módulo de detección de Carril y Curvas fue trabajado utilizando regiones de interés (ROI, por sus siglas en inglés) a las cuales se les aplicó procesos de segmentación y detección de bordes.

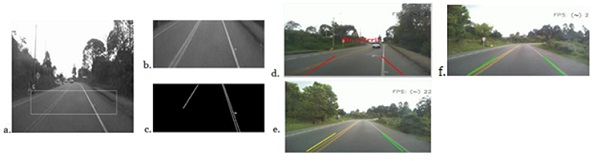

Fig. 5. a) Plano de la imagen base con la región de interés ajustada, b) ROI seleccionada, c) Bordes hallados en el ROI, d), e), f) funcionamiento final módulo detección de carril.

En la Figura 5 se observa el proceso de detección de carril. Como primer paso, se define la región de interés en una zona de la imagen, en tal región se tiene la mayor parte del tiempo información sobre la vía (rectángulo en la figura 5a). Una vez seleccionada está región, se procede a segmentar la imagen para luego realizar una extracción de bordes. Posteriormente, se aplica un proceso de filtrado de bordes que no corresponden a nuestro objeto de interés. El siguiente paso determina si se ha logrado extraer información suficiente para la localización de carril, por último, se estima la ubicación del vehículo dentro del carril.

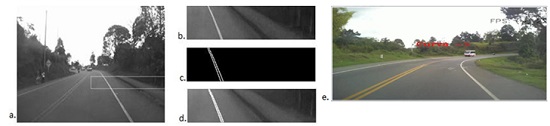

Fig. 6. a) Plano de la imagen base con la región de interés dibujada, b) ROI que se trabaja, c) Bordes hallados en el ROI, d) El contorno del borde, e) funcionamiento final módulo estimación de curva.

Para la detección de curvas, se define una región de interés en la imagen, luego se realizan los procesos de segmentación, extracción de bordes y filtrado. Posteriormente, se obtienen los bordes de la línea limitante del carril, como se observa en la Figura 6c. Para la estimación de la dirección de la curva, el ROI observado en la Figura 6a se divide en tres zonas iguales, se realiza una comparación de la ubicación espacial de los pixeles en las subregiones superior y media a través del cálculo de una diferencia de los pixeles. Teniendo en cuenta esta diferencia se estima la dirección de la curva más próxima: diferencias positivas significan curva a la izquierda, diferencias negativas están relacionadas con curvas a la derecha, diferencias muy cercanas a cero hacen referencia a la ausencia de curvas o curvas poco pronunciadas.

D. Detección de obstáculos

En la etapa de detección de obstáculos, la imagen capturada es sometida a un filtrado de bordes horizontales y verticales, las imágenes obtenidas se restan para eliminar errores en la obtención de los bordes. Una vez hecho este procedimiento, se inicia la búsqueda de obstáculos en la zona de interés (Región en el cuadro rojo, Figura 7). Se determina que la concentración de pixeles que conforman bordes horizontales y verticales sean superiores a un umbral predeterminado, de ser así, la región se divide en cuatro subzonas (Figura 7b) y se analiza nuevamente la concentración de pixeles, luego estas cuatro subzonas se dividen cada una en nueve subzonas (cuadros de color verde, Figura 7c).

Fig. 7. a) Resultado de la operación de bordes horizontales y verticales, b) Subdivisiones etapa 1, c) Subdivisiones etapa 2., d) funcionamiento final módulo detección de obstáculos.

Al llegar a las subdivisiones de la etapa 2, se analiza nuevamente la concentración de pixeles para determinar el tamaño del objeto y estimar la distancia a la que se encuentra el obstáculo del vehículo en movimiento. Cabe mencionar que la distancia solo se usa para realizar una estimación aproximada al objeto y señalizar al conductor su proximidad. Este módulo ha sido pensado para mantener una distancia óptima a otro vehículo en movimiento.

III. Resultados y análisis

El sistema de asistencia fue implementado sobre un vehículo y evaluado en una prueba en vivo, se realiza un recorrido ida y regreso por la vía Panamericana, comprendida entre la zona norte de la ciudad de Popayán e inicios del corregimiento del Cairo-Municipio de Cajibío, aproximadamente 43 Km (en adelante se nombrará Trayecto de prueba), el vehículo fue conducido a velocidades inferiores de 70 Km/h (velocidades permitidas sobre el trayecto). En este trayecto previamente fueron contadas las señales de tránsito reglamentarias y preventivas, con el fin de verificar métricas de evaluación. La cantidad de señales de tránsito en el trayecto de prueba (ida) fue de 213 y trayecto de prueba (regreso) 233, respectivamente.

Cabe aclarar que las muestras de entrenamiento del sistema fueron tomadas en diferentes partes de la ciudad de Popayán, inicios del municipio de Santander de Quilichao e inicios de la ciudad de Cali, por lo que el sistema no conocía muestras de señales de tránsito del trayecto de prueba. Para la evaluación del módulo de reconocimiento de señales, fueron contados los éxitos que el sistema iba colectando conforme transcurría el viaje, se sumaba al contador de éxitos un (1) cada vez que el sistema reconocía correctamente una señal preventiva o reglamentaria o cuando el sistema detectaba que era una señal de tránsito, pero que su plantilla no estaba en la base de datos del sistema. El código, imágenes de entrenamiento, los clasificadores Haar entrenados, videos para pruebas del sistema y videos demostrativos del funcionamiento serán compartidos en https://github.com/mojf87/SAC-Colombia-2020. La Tabla 1 resume los resultados obtenidos en el trayecto de prueba.

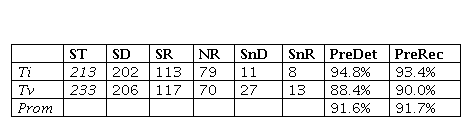

Tabla 1 Resultados de la detección y el reconocimiento de señales de tránsito (ST) del sistema de asistencia sobre el Trayecto de prueba: ida (Ti) y regreso (Tv)

*SD: Señales de tránsito detectadas SnD: Señales de tránsito no detectadas SR Señales de tránsito reconocidas SnRSeñales de tránsito no reconocidas NR: Negativos Reales señales de tránsito que no deben ser reconocidas debido a la falta de plantilla PreDet: Precisión en el proceso de detección de las señales de tránsito PreRec: Precisión en el proceso de reconocimiento de las señales de tránsito

En la Tabla 1, se observa que el sistema de asistencia implementado tiene una precisión promedio en detección y reconocimiento de las señales de tránsito superior al 90%, por otra parte, el sistema debe reconocer en total 10 tipos diferentes de señales de tránsito, estos problemas de clasificación con un gran número de clases han sido resueltos con enfoques basados en algoritmos de aprendizaje máquina, los cuales tienen un alto coste computacional, los resultados obtenidos y presentados en la Tabla 1 demuestran como un método basado en visión por computadora, correspondencia de plantillas, obtiene resultados considerablemente altos con un menor costo computacional y sin necesidad de etapa de entrenamiento. El conjunto final de módulos trabajando cohesivamente para formar el sistema de asistencia a la conducción procesa a una tasa de 22FPS lo que para estas aplicaciones puede ser considerado tiempo real.

Al usuario se le muestra por pantalla los eventos detectados y se reafirma con un sintetizador de voz la alerta que debe tener presente: exceso de velocidad (derivación del proceso de reconocimiento de señales reglamentarias con módulo de GPS), salida de carril involuntaria y señales preventivas detectadas. La Figura 8 muestra la interfaz presentada al usuario.

Fig. 8. a) y b) Resultado de la detección de las señales de tránsito reglamentarias y preventivas (día y noche), c) y d) sistema de asistencia funcionando en un ambiente real.

Durante el trayecto de prueba fueron registradas 97 curvas y se presentaron 21 obstáculos en la vía comprendidos en vehículos de carga pesada, vehículos particulares, motorizados y ciclistas. Con respecto a las curvas, el sistema fue capaz de detectarlas completamente en todo el recorrido, este resultado se explica desde el punto de vista en que las líneas divisorias de la vía están presentes durante todo el trayecto de prueba, permitiéndole al sistema tomar decisiones sobre la dirección de las curvas. Los obstáculos en la vía tuvieron una menor precisión: 80.9%, aunque es una precisión aceptable, teniendo en cuenta que sólo se tiene una cámara de video y no es posible realizar visión estereoscópica, mejorar este resultado incorporando al sistema un nuevo dispositivo de captura de video para proveer una estimación tridimensional del ambiente es considerado un trabajo a futuro en la investigación.

IV. Conclusiones

Se construye el primer asistente a la conducción diseñado para Colombia, el sistema fue capaz de detectar y reconocer con una precisión superior al 90% señales de tránsito preventivas y reglamentarias utilizando clasificadores Haar, los cuales son puestos a disposición de la comunidad científica y académica con el fin de incentivar más desarrollos que beneficien a la seguridad vial del país. El sistema fue equipado con algoritmos de visión por computadora, de bajo costo computacional, que detectan y generan alertas de salidas involuntarias de carril, estimación de la dirección de la curva más próxima y detección de obstáculos que sobresalen en la carretera. El sistema de asistencia tiene una ventaja frente a algoritmos como las redes neuronales artificiales en el hecho de que son inmunes a rotaciones y escalas de las señales de tránsito. El sistema fue probado en un viaje por carreteras colombianas y sus videos de funcionamiento, al igual que los códigos, imágenes de entrenamiento y los archivos cascada de señales de tránsito quedan disponibles en la nube.

Esta investigación presenta los resultados obtenidos para la clasificación de 10 tipos de señales de tránsito preventivas y reglamentarias de Colombia, el proceso de clasificación es realizado con un enfoque basado en visión por computadora, lo que hace que el sistema de asistencia sea de bajo coste computacional. Además, se logra hacer un reconocimiento de carril, salida de carril, detección y estimación de distancia a obstáculos que sobresalen en la carretera y detección de la dirección de la curva más próxima, logrando una tasa de procesamiento de 22FPS, que al ser comparada con el tiempo de reacción promedio de un conductor, se puede considerar que el sistema de asistencia trabaja en tiempo real.

Como trabajos a futuro, se propone utilizar la visión estéreo para mejorar las estimaciones de proximidad a los obstáculos en carretera, además, utilizar los clasificadores entrenados para construir automáticamente un conjunto de datos más amplio de señales de tránsito colombianas disponibles en videos almacenados en la web. Los autores están de acuerdo con que los algoritmos de aprendizaje profundo, específicamente las redes neuronales convolucionales profundas en el caso de proyectos basados en imágenes, han producido medidas de precisión altas en tareas de clasificación; sin embargo, la complejidad de entrenar correctamente una red neuronal es más alta que el entrenamiento de los clasificadores Haar y mucho más que implementar algoritmos basados en visión por computadora, razón por la cual esta investigación motiva a que no se abandonen los enfoques basados únicamente en la visión de máquina.