1. Introducción

La iniciativa propuesta por Tim Berners Lee [1] asociados a la vinculación de datos mediante Linked Data promete resolver los problemas asociados con el análisis y la interoperabilidad de los datos vinculados a recursos relacionados. En la actualidad existen varios ejemplos que permiten el uso de datos vinculados en diferentes áreas de conocimiento tales como la medicina, la geografía, la bibliotecología, entre otras. Por ejemplo, en el campo de la educación, la vinculación de los recursos educativos de diferentes repositorios de conocimiento es útil en la Web, permite el intercambio, la búsqueda y la navegación de objetos de aprendizaje [2]. Varios proyectos como Europeana [3], LinkedUp [4], [5]:, y Linked Education [2], han adoptado el enfoque de Linked Data y su objetivo responde a vincular conjuntos de datos educativos.

Por su parte, el proyecto Linked Open Data (LOD, por sus siglas en inglés) es otra iniciativa orientada a aplicar los principios de la web semántica con el fin de conectar recursos. LOD utiliza tecnologías como Resource Description Framework (RDF, por sus siglas en inglés) [6] y Uniform Resource Identifier (URI, por sus siglas en inglés), junto con un conjunto de principios denominados "datos vinculados". Varias fuentes de datos, como Wikipedia, están ahora disponibles para los desarrolladores, que claramente se benefician de los conjuntos de datos vinculados con base en un modelo de datos común [3].

Datahub, sujeto de análisis en el presente artículo, es una plataforma para la gestión de datos, basada en CKAN - Comprehensive Knowledge Archive Network [17] - [18], que es una herramienta para la gestión y publicación de colecciones de datos (Datasets) en un ambiente web, utilizado por diferentes gobiernos, nacionales y locales, instituciones de investigación, entre otras (denominadas "organizaciones" en CKAN), que recogen una gran cantidad de datos. A través de sus servicios, los usuarios pueden buscar y encontrar los datos que necesitan.

La motivación de este trabajo es presentar, a través de un estudio de caso basado en Datahub, como a partir de la conexión y el consumo de datos que pueda ofrecer el Application Programming Interface (API, por sus siglas en inglés), en este caso CKAN [17], se pueden obtener variables para la realización de un análisis preliminar sobre la visión de la web de los datos. Dicho caso estudio busca propiciar herramientas, para la identificación de tendencias en el modelo de la web de los datos, tomando como base datos históricos presentes en Datahub.io, como plataforma de gestión de datos, en el marco del proyecto de investigación sobre vinculación de datos que se viene adelantando.

El resto del siguiente artículo se encuentra organizado de la siguiente manera: en la primera parte de se encuentra el estado del arte, donde se revisan los fundamentos de la temática explorada. Posteriormente, en la sección III se presenta el planteamiento metodológico utilizado para la exploración de los conjuntos de datos. En la sección IV, se presenta el desarrollo metodológico, junto con los hallazgos encontrados, en la sección V se presenta el análisis de resultados. Finalmente, en la sección VI se presentan las conclusiones y trabajo futuros.

2. Estado del arte

Gracias al modelo de web de los datos, varias fuentes de datos, como Wikipedia, están ahora disponibles para los desarrolladores, que claramente se benefician de los conjuntos de datos vinculados con base en un modelo de datos común [7]. Por su parte, el proyecto DBpedia [8] dispone de un conjunto de datos que actualmente se consideran como el eje central y más significativo entre los conjuntos de datos LOD [9]. En la web se encuentran iniciativas LOD tales como las plataformas de gestión de datos, entre ellas:

Datahub (https://datahub.io/), objeto de examen en este artículo, la cual permite buscar y publicar datos, crear y gestionar grupos de Dataset, entre otras funcionalidades (10) .

Junar (http://junar.com/), plataforma de datos abiertos en la nube que facilita la publicación de datos por parte de gobiernos, empresas u otras organizaciones (11) .

Socrata (https://www.socrata.com/), plataforma escalable de publicación de datos en la nube que facilita la creación de iniciativas de datos abiertos sostenibles, ofreciendo un amplio conjunto de funcionalidades (11) .

data.gov.uk To Go (http://guidance.data.gov.uk/), kit del gobierno de Reino Unido para poner a disposición del público en general, su plataforma de publicación de datos de forma que cualquiera pueda desplegar una plataforma similar, preocupándose únicamente de adaptar la apariencia externa final (11) .

Plataforma de Gobierno Abierto OGoov (http://www.ogoov.com/es/), ofrece una serie de funcionalidades combinables entre si según la orientación o iniciativas relacionadas con el gobierno abierto que se deseen priorizar: datos abiertos, transparencia y participación (11) .

Estas entre otras plataformas, han permitido una mayor visibilidad de datos compartidos y han facilitado la participación de iniciativas como LOD Cloud [9], para la visualización de las organizaciones y proveedores de contenidos que han liberado y enlazado sus datos.

Como parte de un proyecto de investigación de tesis doctoral en curso, orientado en el dominio de la vinculación de datos, se plantea recabar información preliminar sobre el contenido de la nube LOD a 2016. Con tal fin, y dado que en experiencias como [9] donde se trabajó con DBPedia, para el presente estudio se propone analizar la plataforma de gestión de datos libres Datahub.io, de la Open Knowledge Foundation [12] - OKFN. Esta fundación tiene como visión que el conocimiento crea poder para muchos, no para unos pocos, los datos nos libera para tomar decisiones informadas sobre la forma en que vivimos, lo que compramos y quien recibe nuestro voto; la información y el conocimiento son accesibles, aparentemente, a todo el mundo. Por otra parte, Datahub.io, como una de las plataformas de gestión de datos y repositorio internacional de datos abiertos reconocidas [25], es una de las que más Dataset aporta a la conformación del Linked Open Data Cloud Diagram [9].

CKAN maneja un backend construido en Python, y un frontend construido en JavaScript. También usa el framework web Pylons y SQLAlchemy como ORM, con PostgreSQL como motor de base de datos. Tiene una arquitectura modular que permite desarrollar extensiones para proporcionar características adicionales, tales como harvesting o carga de datos, visualización de múltiples vistas, diferentes extensiones, un JSON API para leer, escribir y hacer consultas a los Dataset, soportado en más de 40 lenguajes, entre otras funcionalidades [23] - [24].

Al ser de código abierto, licenciado bajo términos GPL v3.0 Affero GNU, los usuarios CKAN pueden adaptar sus servicios, como lo han hecho, entre otros [13]:

Africa's Largest Volunteer Driven Open Data Platform (https://africaopendata.org/).

data.amsterdam.nl (http://data.amsterdam.nl/).

Buenos Aires Data (http://data.buenosaires.gob.ar/).

Paraguay Digital (https://www.datos.gov.py/).

La plataforma cívica de datos abiertos de México (http://datamx.io/).

Registro de conjuntos de datos abiertos en Noruega (http://data.norge.no/ ).

Ahora bien, para los propósitos de CKAN, los datos se publican en unidades denominadas "Data- Set". Un Dataset es un paquete de datos -por ejemplo, podría ser las estadísticas de la delincuencia para una región, las cifras de gasto para un departamento gubernamental o las lecturas de temperatura de varias estaciones meteorológicas-. Cuando los usuarios buscan datos, los resultados de búsqueda que se obtiene son Dataset individuales. Un Dataset contiene dos componentes [13]:

Información o "metadatos"sobre los datos. Estos datos deben proveer la siguiente información:

Título, único a través de CKAN, de modo que sea breve pero específica. Por ejemplo: "densidad de población del Reino Unido según la región. Es mejor que "Las cifras de población"

Descripción, información que la gente necesita saber cuándo se utilizan los datos.

Etiquetas, etiquetas que ayuden a la gente a encontrar los datos y la vinculan con otros datos relacionados.

Licencia, información de la licencia para que se sepa cómo se pueden utilizar los datos.

Organización, elegir quién es el propietario del Dataset.

Un número de "recursos", que contienen los datos en sí. CKAN no le importa en qué formato están los datos (hoja de cálculo CSV (comma-separated values) o Excel, XML, PDF, archivo de imagen, RDF, entre otros). CKAN puede almacenar el recurso internamente o almacenar un enlace al recurso en sí, ubicado en otra parte en la web. Para los recursos se debe proveer la siguiente información:

Nombre, un nombre para el recurso.

Descripción, una breve descripción del recurso.

Formato, el formato de archivo del recurso, por ejemplo, CSV, XLS, JSON (JavaScript Object Notation), PDF, etc.

Visibilidad, un Dataset público puede ser visto por cualquier usuario del sitio. Un Da taset privado solo puede ser visto por los miembros de la organización propietaria del Dataset y no se mostrará en las búsquedas realizadas por otros usuarios.

Autor, el nombre de la persona u organización responsable de la producción de los datos.

Correo electrónico del autor.

Correo electrónico del responsable de mantenimiento.

Campos personalizados, si desea adicionar más datos.

Considerando lo anteriormente descrito, en Datahub.io, se registra 822 organizaciones (propietarios de los Dataset), creadas con previa autorización de un administrador, a través del envío de una solicitud. Estas organizaciones pueden crear, administrar y publicar colecciones de conjuntos de datos y pueden tener miembros tales como administradores (que añaden usuarios y gestionan la organización), y editores (que solo pueden añadir conjuntos de datos de la organización). Dicha distribución en organizaciones provee las siguientes características:

Se proporciona una estructura de permisos y autorizaciones mucho más rica (en torno a la organización), que ofrece a los usuarios un mayor control sobre quién puede o no, editar y añadir conjuntos de datos.

Proporciona una estructura orientada a la organización, para la presentación y la búsqueda de bases de datos.

Ayuda a controlar problemas de spam, proporcionando más control sobre quién añade conjuntos de datos.

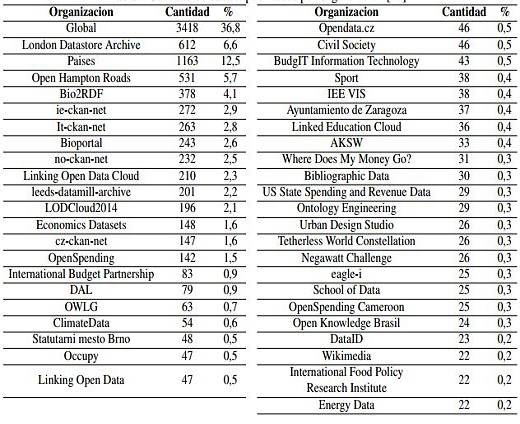

Dentro de las organizaciones incluidas en Datahub.io se encuentran las que se presentan en la Tabla I, junto con el total de Dataset publicados por cada una de ellas.

Como se observa en la Tabla I, la categoría "Global" es la que maneja la mayoría de Dataset publicados. Lo anterior se debe al proceso de migración realizado por la plataforma, dejando en esta categoría a aquellos Dataset que no eran parte de ninguna organización. Por otro lado, se observa que la siguiente categoría de mayor publicación es la correspondiente a "países". De igual forma, en Datahub.io se encuentran publicados 10.900 Dataset.

Es importante anotar que hay organizaciones que:

No tienen ningún Dataset publicado.

Tiene un archivo de prueba de carga, que no configurar ningún tipo de Dataset.

Tiene uno o más de un Dataset publicado, en diferentes formatos (que van desde CSV hasta PDF; XML, Sparql - SPARQL Protocol and RDF Query Language, etc.), y con diferentes tipos de licenciamiento.

Tiene publicados otros archivos diferentes a un Dataset.

Dentro de la literatura se encuentran algunos trabajos relacionados tales como [19], quienes describen el problema de los enlaces abiertos y la estrategia para resolver este problema. Por su parte, en [20] se muestra las cantidades de datos vinculados disponibles a partir de julio de 2009 y el número de enlaces entre conjuntos de datos RDF; y en [21] se presenta un estudio de estadísticas acerca de la estructura y contenido de la nube LOD.

Es así como a partir de este panorama, el siguiente documento tiene como propósito presentar un estudio de caso sobre la configuración, acceso y consumo de datos que pueda ofrecer el API CKAN [17], con el fin de poder consultar una muestra de los Dataset publicados en Datahub, seleccionados de forma aleatoria, con los cuales se podrá identificar y extrapolar, de manera preliminar , las tendencia del modelo de la web de los datos a partir de los datos históricos presentes en Datahub.io, como plataforma de gestión de datos. Análisis que se plantea en etapas posteriores del proyecto que enmarca esta investigación. El motivo de usar esta API se debe a que CKAN está escrito en Python y hace uso de una variedad de framework de código abierto, incluido Pylons, el cual es una combinación de varios framework de código abierto integrados que forman la base para aplicaciones de nivel empresarial basados en la web.

El almacenamiento y gestión de datos de CAKN incluye el almacenamiento de archivos, gestión de metadatos, y la gestión de datos estructurados. Además, ofrece un mecanismo de plug-in, que permite a los desarrolladores extender rápidamente la funcionalidad de CKAN. De igual forma, CKAN posee la capacidad de soportar características geográficas, así como la exposición de metadatos de acuerdo con el catálogo estándar Open Geospatial Consortium (OGC, por sus siglas en ingles) y Catalog Service for the Web (CSW, por sus siglas en inglés). Por último, CKAN implementa funciones de limpieza cruciales tales como el logueo y gestión de usuarios [22] .

3. Planteamiento metodológico

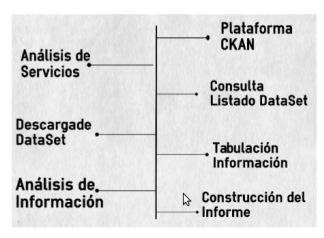

Para llevar a cabo el proceso de conexión y descarga de los Dataset publicados en Datahub.io, se realizaron una serie de actividades tal como se describe en la Figura 1.

Tal como se presenta en la Figura 1 las actividades más relevantes son:

Se revisó la plataforma CKAN, con el fin de establecer los servicios que ésta provee, al igual que la forma de acceder a ellos. Para esta labor se hizo uso del CKAN's API guide [14] - [15].

Posteriormente se estudió la forma de conectarse a los servicios prestados por CKAN, con el fin de descargar los Dataset publicados en Datahub.io [14] - [15].

Haciendo uso de los servicios de CKAN, se consultó el listado de los nombres de los Dataset publicados.

Dada la cantidad de Dataset publicados, Datahub usa la estrategia de publicar grupos de Dataset (en sus respectivos formatos) por páginas, para un total de 545 páginas. Teniendo en cuento la distribución anterior, se descargaron archivos JSON, formato de archivo que se descarga localmente, los cuales contienen los Dataset publicados por página en la plataforma de gestión de datos.

Por último, con el fin de revisar la integridad de la descarga, se llevó a cabo un análisis comparativo de la información, haciendo uso de herramientas que permitieran visualizar la data descargada, con la revisión manual de algunos Dataset publicados.

Construcción del presente artículo, de acuerdo a los resultados obtenidos.

4. Materiales y métodos

Dado que el presente documento se basa en la descripción de un caso de estudio acerca de la conexión y consumo de los servicios ofrecidos por CKAN y, con el fin de que el procedimiento seguido pueda ser replicado aposteriori, a continuación se describen el proceso desarrollado con el fin de poder consumir los servicios del API, y por ende consultar los Dataset, dispuestos en páginas, para posteriormente ser descargados en archivos JSON, los cuales permitirán llevar a cabo un análisis preliminar de las tendencias del modelo de la web de los datos. El proceso seguido, junto con los recursos necesarios para la conexión y consumo se describe a continuación.

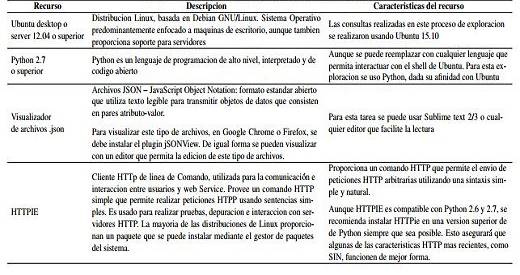

4.1. Recursos para la conexión a Datahub.io - CKAN API:

Datahub.io, como sitio desarrollado usando la API de CKAN, permite hacer uso de las funcionalidades que provee la API como consultar los metadatos (información acerca del dato alojado), descargar la lista de los Dataset alojados, información de organizaciones, etiquetas que identifican determinado Dataset, entre otras funciones.

El proceso para realizar consultas sobre la API plantea el uso de los siguientes recursos ( Tabla II).

La Figura 2 se muestra la interacción de los recursos necesarios para conectarse a los servicios de CKAN.

4.2. Proceso de instalación y consulta al API:

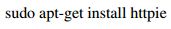

Instalación HTTPie: una vez ubicado en el entorno Ubuntu, se procede a abrir una terminal y ejecutar el comando:

La Figura 3 muestra los resultados de la ejecución del citado comando

Una vez ha terminado el proceso de instalación, ya se pueden realizar peticiones a servidores http, en este caso CKAN. La documentación de HTTpie se puede encontrar en el repositorio https://github.com/jkbrzt/httpie.

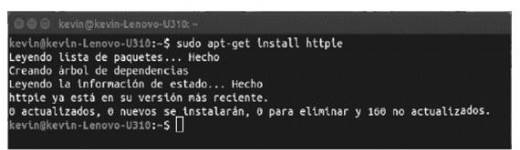

Ahora bien, la estructura básica para una consulta HTTPie se formula de la siguiente manera:

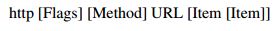

Consulta de los DataSet: CKAN provee métodos para consultar los repositorios del sitio que ha sido desarrollado con su API. Para hacer uso de dichos métodos basta con agregar al sitio principal (que haga uso de CKAN) la sintaxis:

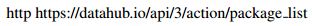

Con el fin de aclarar lo descrito anteriormente, se hará una consulta a Datahub.io de todos los nombres de los Dataset que tiene y, por defecto, el servidor devolverá el resultado en una lista con estructura tipo JSON. Para realizar este proceso se abre una terminal y se digita:

La Figura 4 muestra los resultados de la ejecución del citado comando.

Seguido a esta ejecución, se desplegará dentro de la misma consola los nombres de todos los Dataset de Datahub.io. Si adicionalmente se quiere descargar la información consultada y volcarla a un archivo, se debe agregar las banderas --downloady -o, incluidas en HTTpie. La bandera --downloadpermite descargar el archivo; y la bandera o permite nombrar y ubicar el archivo descargado. Por ejemplo, para descargar la lista anterior se realiza el proceso descrito en la Figura 5 .

Como resultado de esta ejecución se descarga el archivo con el nombre "lista_Datasets.json", en el folder "Ejemplo", previamente creado.

Por otro lado, para descargar todos los Dataset de Datahub.io, se puede hacer uso del método current package list with resources. Sin embargo, este método solo descarga de a diez Dataset si no se le especifica algún tipo de parámetro. Adicionalmente, su capacidad máxima de descarga de Dataset es de 1000, es decir que el archivo de descarga tendrá como máximo 1000 Dataset. Por ende, para descargar los Dataset publicados en la plataforma se escribe un script en Python, que haga uso de un ciclofor, que permita descargar los Dataset completos de cada página hasta completar 535 páginas. En la Figura 6 se muestra el script y el resultado de su ejecución.

Para ejecutar el script desde la terminal, se debe ubicar en el directorio donde se va a guardar el archivo y se ejecuta el comando Python [Nombre del archivo], que para este caso corresponde: Python script.py

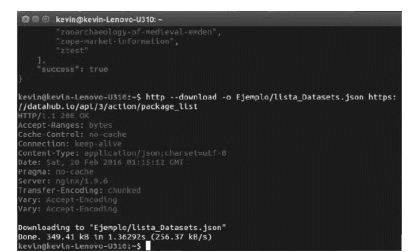

El resultado de la iteración es la generación de un archivo por página (535 archivos), como se muestra en la Figura 7.

5. Resultados y discusión

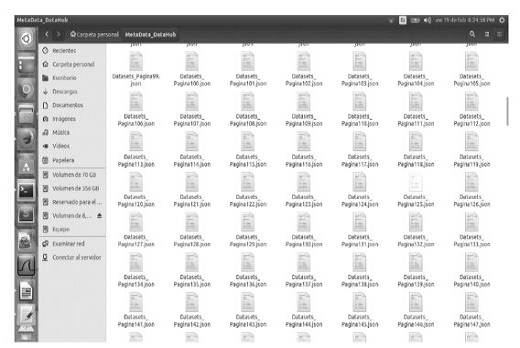

Como primer resultado obtenido en el proceso de conexión, se descargó el listado de Dataset publicados en la plataforma. La Figura 8 muestra, al costado derecho el archivo JSON resultante de la consulta y al costado izquierdo el árbol de consulta resultante, donde cada valor de arreglo "result" corresponde a un nombre de Dataset consultado.

En total se obtuvieron 10694 entradas a la variable "result", que representa la misma cantidad de nombres de Dataset consultados.

Posterior a esta consulta, se procedió a la descarga del listado de Dataset, como se especificó en la sección de Métodos y Materiales, generando 545 archivos correspondientes al mismo número de páginas existentes en la plataforma. Con este producto obtenido, se procedió a comparar y verificar la información resultante del proceso de descarga.

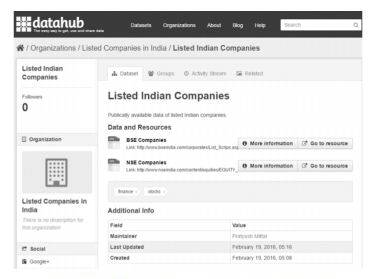

DataSet consultado en la plataforma de Datahub.io: para revisar manualmente el proceso se tomó como ejemplo y punto de referencia la Organización "Listed Indian Companies", la cual tiene un Dataset publicado en dos formatos, como se observa en la Figura 9.

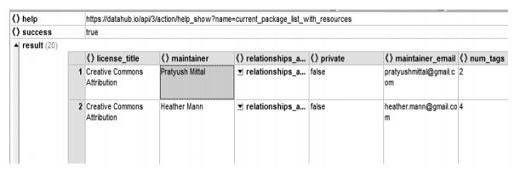

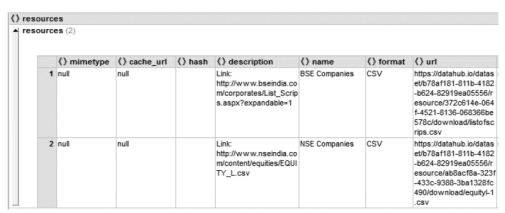

En la Figura 10 se observa el segmento del archivo JSON, que contiene la información de esta organización.

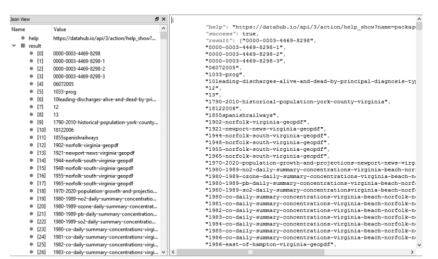

Haciendo uso de herramientas visualizadores de archivos JSON, se puede revisar la información contenida en el segmento JSON, tal como los muestran las Figuras 11 y12.

De igual forma, con este tipo de herramientas se pueden revisar parámetros de evaluación, tales como tipo de licenciamiento, última fecha de actualización, tipo de formatos publicados, entre otros que pueden brindar información relevante al momento de evaluar el estado de la web de los datos. La Figura 13 permiten evidenciar la información brindada por este tipo de herramientas. Como se observa en la Figura 13 , el Dataset consultado como ejemplo de verificación, tiene dos recursos publicados: BSE Companies y NSE Companies, ambos en formato CSV, bajo licencia cc-by, con fecha de última actualización el 19 de febrero de 2016.

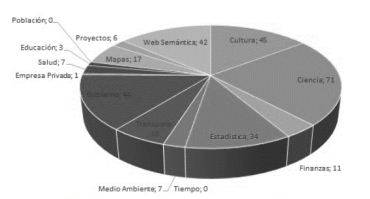

Para la realización de un análisis preliminar de la información descargada, se seleccionó, de forma aleatoria, una muestra de 54 organizaciones y se procedió a revisar los Dataset publicados, 311 en total, con el fin de levantar la información acerca de dominios, formatos licenciamiento y última fecha de publicación de los Dataset.

Como resultado de este proceso se obtuvo la siguiente información:

Dominio de Datos:En los 311 Dataset revisados, en la Figura 14 se categorizan los dominios de la siguiente manera:

En la revisión de dominio de publicación se encuentra que los dominios de tipos de datos abiertos con mayor publicación son:

Ciencia, con un 23 %, en la cual los mayores subdominios son arqueología, química y bioinformática.

Cultura, gobierno y web semántica, con un 14 %.

Estadística, con un 11 %.

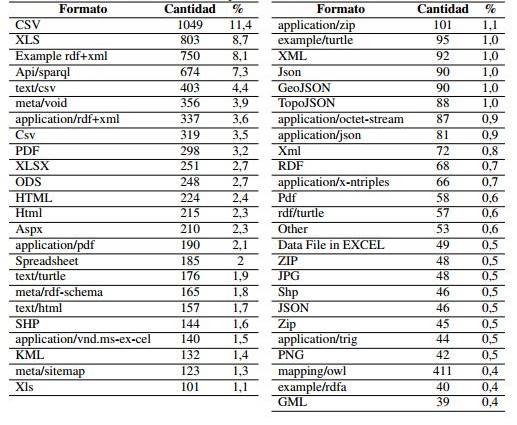

Formatos de publicación:como se observa en la revisión preliminar realizada en Datahub.io ( Tabla III ), los DataSet están cargados en la plataforma en diferentes formatos (algunos de las organizaciones cargan más de un tipo de formato).

En la revisión de estos formatos, se puede observar que la plataforma no maneja un estándar unificado en cuanto a los formatos subidos, lo anterior añadido a que los formatos que se cargan no presentan una estandarización, lo que se puede observar al encontrarse como XLS, XLSX, Hoja de Cálculo, Excel, SpreedShet, MS Excel.

De igual forma, se identifica que hay publicaciones de Dataset realizadas en formatos no estructurados como PDF, PNG. Como se observa en la tabla III, en Datahub.io se pueden cargar diferentes formatos de un Dataset, encontrando por ejemplo que hay 1389 publicaciones que tiene formato de hojas de cálculo en sus formatos de publicación, lo que representa que un 13 % de los Dataset publicados y, como formatos propietarios, requieren herramientas que no son públicas.

También se identifica que varias organizaciones le han apostado a depurar sus publicaciones, escalando en el modelo propuesto por Berners-Lee [1], ofreciendo datos en formatos estructurados, abiertos al público y que permiten llevar a cabo el proceso de vinculación. Sin embargo, en este proceso también se observa en Datahub, situaciones como la disparidad de formatos de publicación , algunos de los cuales no permiten la interoperabilidad semántica, limitándose a la descripción sintáctica de la información o, por el contrario, publicando formatos que dificultan el procesamiento por las máquinas.

Fecha de última actualización:en cuanto a la fecha de última actualización, teniendo en cuenta que bajo los Principios de Open Data [16], estos datos deben ser "Actualizados", con el fin de que no pierdan su valor y sean precisos, como resultado de la exploración muestral realizada, se identifica que el 1 % de los mismos alcanzaría un grado de actualización frecuente, un 7,7 % un grado de actualización media, mientras que un 60 % presenta un grado de actualización deficiente.

En este aspecto es importante resaltar que varios de los dominios corresponden a datos estadísticos generados de periodos anteriores, los cuales no requerirían de una actualización permanente, sin embargo, esta disparidad en el proceso de actualización permite reflexionar acerca del grado de actualización de los Dataset publicados.

6. Conclusiones y trabajos futuros

CKAN es una herramienta potente para gestionar catálogos de datos, permitiendo manejar una descripción de los datos y otras informaciones relevantes, tanto para las organizaciones que publican como para las personas que consultan dicha información, tales como categorías de organizaciones, formatos en que se encuentra disponible los datos, propietario de los datos, el tipo de licenciamiento de las publicaciones, enlaces a otros datos.

Por otro lado, CKAN es una herramienta usada en muchos catálogos de datos abiertos, disponibles en la Web . Las organizaciones que hacen uso de CKAN, tanto privadas como públicas, publican sus datos haciendo uso de algún nivel de las recomendaciones de buenas prácticas de Open Data y las propuestas por Berners-Lee.

En cuanto a los servicios ofrecidos por CKAN, para la consulta y descarga de la data, son servicios consistentes, que ofrecen peticiones y respuestas en formato JSON, sin restricciones al público. Existen herramientas tales como Python, Java, Java, Ruby, PHP, que pueden interactuar con el API REST de CKAN, permitiendo obtener la información solicitada, la cual puede ser visualizada en diferentes formatos, haciendo uso de herramientas visualizadoras, que permiten hacer las consultas respectivas de formas más ágil.

Como lo plantea [24], es complejo seleccionar una plataforma sin realizar un estudio cuidados de las necesidades de los interesados. En el estudio citado, se plantea que CKAN se está convirtiendo en uno de los referentes en cuanto a la gestión de catálogos de fuentes de datos, pero que a su vez presenta desventajas como el mantenimiento de una plataforma tecnológica diferente al CMS usado para gestionar los datos, falta de soporte nativo de RDF para el enriquecimiento semántico de los datos, y el despliegue de una aplicación web diferente al portal CMS usado [26].

Por su parte, Datahub.io, como plataforma de gestión de datos, permite una publicación de datos ágil, y con pocas restricciones al usuario final, a través de una interfaz web sencilla. Por otro lado, si como desarrollador o investigador, se requiere a Datahub.io, para consultar o descargar sus Dataset, ofrece una como apoyo el CKAN API, interface que interactúa con diferentes herramientas, ofrece una variedad de servicios, para llevar a los procesos requeridos.

Ahora bien, dentro de las situaciones que se observan en las publicaciones realizadas en Datahub.io, corresponde a la interpretación que algunas organizaciones en Datahub le han dado al concepto de Datos Abiertos, tomando a la plataforma como una estrategia para publicar o promocionar escritos, artículos, eventos, etc., que no poseen ningún tipo de vinculación ni de contexto ampliado a los datos expuestos. Tal es el caso de la organización 'Mente Clara', donde sus 13 publicaciones son imágenes y PDF (artículos) acerca del budismo tántrico tibetano.

Otro aspecto identificado es el acceso a ciertos recursos de los Dataset tomados como muestra, dado que las URI no accedían, generando inconvenientes para el proceso de vinculación. Este tipo de problemas podría ser causado a la falta de actualización de los datos publicados en la plataforma, entre otras situaciones. Independiente del origen de dicho problema, uno de los factores claves de la web de los datos es el proceso de identificación y vinculación de datos que aporten contexto al dato publicado, y la falta de enlaces resolubles afecta el desarrollo de esta tecnología.

De otro lado, en el caso de los gobiernos, por ejemplo, se identifican publicaciones que responden a los principios de transparencia y apertura de información, pero que bajo los principios de Datos Abiertos y de Linked Data, no aportan contexto a la información expuesta, limitándose a publicar listados de cuadros en hojas de cálculo, algunos de los cuales no se actualizan de forma periódica. Un ejemplo de ello es por ejemplo la organización 'Bolivia' que registra seis Datasets, en los cuales todos tiene como última fecha de actualización hace en promedio dos años, y la información contenida en ellos corresponden a tablas de hojas de cálculo de informes de indicadores sociales, que no se complementan o añaden contexto a la información, con otros enlaces o datos de interés.

Como trabajos futuros del proceso de investigación, y dados los hallazgos identificados, se plantea: 1) llevar a cabo un análisis más detallado del estado de la Web de los datos, a través de herramientas de analítica visual, 2) realizar un análisis del estado de la Web de los datos en el área de recursos digitales abiertos mediante propuestas de accesos seguros a plataformas LCMS [27], objeto de estudio de la investigación, y por último, 3) el planteamiento de una propuesta metodológica para procesos de vinculación de datos de cara a los recursos digitales abiertos, analizando los hallazgos encontrados para su aplicación en entornos educativos.