Services on Demand

Journal

Article

Indicators

-

Cited by SciELO

Cited by SciELO -

Access statistics

Access statistics

Related links

-

Cited by Google

Cited by Google -

Similars in

SciELO

Similars in

SciELO -

Similars in Google

Similars in Google

Share

Revista Ingenierías Universidad de Medellín

Print version ISSN 1692-3324On-line version ISSN 2248-4094

Rev. ing. univ. Medellin vol.5 no.9 Medellín July/Dec. 2006

Riesgo operacional: reto actual de las entidades financieras

Juan Camilo Arbeláez*; Luis Ceferino Franco*; César Betancur*; Juan Guillermo Murillo*; Paula Andrea Gallego**; Viviana María Henao**; Johana Andrea Londoño**; Claudia Marcela Mejía**; Diana Marcela Palacio**; Elizabeth Salazar**; Luisa Fernanda Salazar*; Natalia Valderrama*; Diana Carolina Varela*

* Docentes investigadores. Programa de Ingeniería Financiara. Universidad de Medellín. E-mail: lfranco@udem.edu.co

** Estudiantes, programa de Ingeniería Financiera. Universidad de Medellín

RESUMEN

El presente artículo es uno de los resultados de un proyecto de investigación sobre gestión integral del riesgo operacional, promovido por la Vicerrectoría de Investigaciones de la Universidad de Medellín.

El objetivo es presentar, sin ambiciones de exhaustividad, una descripción de los modelos que se consideran más relevantes en la amplia gama de posibilidades para la cuantificación del riesgo operacional.

El artículo está estructurado en la siguiente forma: primero se hace una breve contextualización del riesgo operacional en el marco de los riesgos financieros en general, y en el ámbito de la normativa vigente a escala mundial. En la siguiente sección se describen los modelos básicos (Método del indicador básico, Método estándar y Método estándar alternativo) propuestos para la cuantificación del riesgo operacional. Luego se relacionan los mínimos requerimientos generales, cualitativos y cuantitativos que, a luz del Nuevo Acuerdo de Basilea, deben cumplir los modelos de medición avanzada que las entidades financieras pretendan someter a aprobación de los entes reguladores. Posteriormente, se presentan algunos estudios específicos recientes en los ámbitos mundial y local; y finalmente se obtienen algunas conclusiones.

Palabras clave: riesgo operacional, método del indicador básico, método del indicador estándar, métodos de medición avanzada, teoría de valores extremos, picos sobre el umbral.

ABSTRACT

Its main objective is to succinctly present a description of the models considered the most relevant in the wide range of possibilities for the quantification of operational risk.

The article is structured in the following form: first it briefly contextualizes operational risk in the frame of financial risks in general, and in the frame of the current regulations world-wide. In the following section the basic models (Basic Indicator Approach, Indicator Standard Approach and Alternative Standard Approach) proposed for the quantification of the operational risk are described. Then it describes the minimum general, qualitative and quantitative requirements, in the light of the New Basilea Agreement, that should be met by the advanced measurement approach that financial organizations try to submit to approval of the regulating institutions. Later, it shows some recent specific local and world-wide studies and finally some conclusions are obtained.

Key words: operational risk, basic indicator approach, indicator standard approach, advanced measurement approach, extreme value theory, peaks over threshold.

INTRODUCCIÓN

La cuantificación del riesgo se ha convertido en una de las preocupaciones centrales de los investigadores y operadores en finanzas, no sólo por la necesidad cada vez más creciente de responder a la normativa emanada de las entidades reguladoras nacionales e internacionales, como es el caso de la Superintendencia Financiera Colombiana y el Banco de Pagos Internacionales (Bank for Internacional Settlements-BIS) del Comité de Basilea, sino también, y primordialmente, para mejorar continuamente los procesos de toma de decisiones y generación de valor.

En el contexto de las finanzas, cuando hablamos de riesgo, nos estamos refiriendo a la posibilidad de pérdidas causadas por variaciones de los factores que afectan el valor de un activo. Por esa razón, es importante que se identifiquen, se midan, se controlen, y se haga un monitoreo continuo de los diversos tipos de riesgo a los que están expuestas las entidades en el devenir cotidiano de sus actividades.

No obstante la gran cantidad de riesgos conocidos en finanzas, desde la perspectiva básica de los acuerdos de Basilea, todo riesgo financiero puede clasificarse en una de tres categorías: riesgo de mercado, riesgo crediticio o riesgo operacional.

Según el Comité de Supervisión Bancaria de Basilea, en sus documentos sobre Convergencia Internacional de Medidas y Normas de Capital, ' El riesgo operacional se define como el riesgo de pérdida debido a la inadecuación o a fallos de los procesos, el personal y los sistemas internos o bien a causa de acontecimientos externos'.

En términos generales, para la clasificación del riesgo operacional, se consideran ocho líneas de negocio (finanzas corporativas, negociación y ventas, banca minorista, banca comercial, liquidación y pagos, servicios de agencia, administración de activos e intermediación minorista) y siete categorías de riesgo operacional que potencialmente impactan negativamente a cada una de esas líneas (fraude interno, fraude externo, daños en activos físicos, prácticas de los empleados, prácticas del negocio, interrupción del negocio, gestión del proceso).

Cada entidad debe hacer una adaptación del anterior esquema general, acorde con sus actividades específicas.

En los últimos años, pero fundamentalmente desde el surgimiento del Nuevo Acuerdo de Basilea (2004), también conocido como Basilea II, que incorporó el riesgo operacional para el cálculo de los requerimientos de capital, los procesos de identificación de ese riesgo, su medición y gestión, se han convertido en un desafío no sólo para los operadores de las finanzas, sino también para los académicos e investigadores, que han propuesto múltiples modelos para su cuantificación.

Los modelos propuestos varían en requerimientos de datos, complejidad, completez, exactitud, y en satisfacción de los estándares generales, cualitativos y cuantitativos planteados por ese acuerdo.

En las siguientes secciones se describen brevemente los modelos del indicador básico (Basic Indicator Approach-BIA) y el método estándar (Indicator Standar Approach-ISA) propuestos por el Nuevo Acuerdo de Basilea (NAB); se plantean los requerimientos cualitativos y cuantitativos que según ese mismo documento debe satisfacer cualquier modelo de medición avanzada (Advanced Measurement Approach-AMA); y se presentan algunos estudios específicos.

MODELOS BÁSICOS PARA RIESGO OPERACIONAL

MÉTODO DEL INDICADOR BÁSICO

Los bancos que utilicen el método del indicador básico deberán cubrir el riesgo operativo con un capital equivalente al promedio de los tres últimos años de un porcentaje fijo (denotado como alfa) de sus ingresos brutos anuales positivos. Al calcular este promedio, se excluirán tanto del numerador como del denominador los datos de cualquier año en el que el ingreso bruto anual haya sido negativo o igual a cero. La exigencia de capital puede expresarse del siguiente modo:

Donde:

KBIA = la exigencia de capital en el método del indicador básico

GI = ingresos brutos anuales medios, cuando sean positivos, de los tres últimos años

n = número de años (entre los tres últimos) en los que los ingresos brutos fueron positivos

= 15%, parámetro establecido por el Comité, que relaciona el capital exigido al conjunto del sector con el nivel del indicador en el conjunto del sector.

MÉTODO ESTÁNDAR

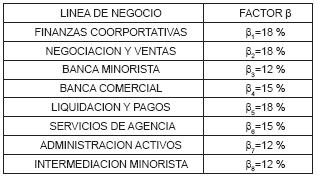

En el método estándar, las actividades de los bancos se dividen en ocho líneas de negocio: finanzas corporativas, negociación y ventas, banca minorista, banca comercial, pagos y liquidación, servicios de agencia, administración de activos e intermediación minorista.

El ingreso bruto de cada línea de negocio es un indicador amplio que permite aproximar el volumen de operaciones del banco y, con ello, el nivel del riesgo operativo que es probable que asuma el banco en estas líneas de negocio. El requerimiento de capital de cada línea de negocio se calcula multiplicando el ingreso bruto por un factor (denominado beta) que se asigna a cada una de las líneas. Beta se utiliza como una aproximación a la relación que existe en el conjunto del sector bancario entre el historial de pérdidas debido al riesgo operativo de cada línea de negocio y el nivel agregado de ingresos brutos generados por esa misma línea de negocio. Cabe mencionar que, en el método estándar, se calcula el ingreso bruto de cada línea de negocio y no el obtenido por la institución en su conjunto. Así, por ejemplo, en finanzas corporativas, el indicador es el ingreso bruto generado por la línea de negocio de finanzas corporativas.

La exigencia total de capital se calcula como la media de tres años de la suma simple de las exigencias de capital regulador en cada una de las líneas de negocio cada año. Para un año dado, los requerimientos de capital negativos (resultantes de ingresos brutos negativos) en cualquiera de las líneas de negocio podrán compensar los requerimientos positivos en otras líneas de negocio sin límite alguno. No obstante, cuando el requerimiento de capital agregado para todas las líneas de negocio dentro de un año en concreto sea negativo, el argumento del numerador para ese año será cero. El requerimiento total de capital puede expresarse como:

Donde:

KTSA = la exigencia de capital en el método estándar

= los ingresos brutos anuales de un año dado, como se define en el método del indicador básico, para cada una de las ocho líneas de negocio.

= un porcentaje fijo, establecido por el Comité, que relaciona la cantidad de capital requerido con el ingreso bruto de cada una de las ocho líneas de negocio. Los valores de los factores beta se enumeran a continuación (tabla 1)

Tabla 1. Valores de los factores beta

Como método estándar alternativo, y en virtud de la discrecionalidad supervisora nacional, la autoridad supervisora podrá permitir a un banco la utilización del método estándar alternativo (Alternativ Standard Approach-ASA), siempre que el banco sea capaz de demostrar a su supervisor que este método alternativo conlleva mejoras en, por ejemplo, la eliminación de la doble contabilización de los riesgos. Una vez que un banco haya sido autorizado a utilizar el ASA, no podrá volver al método estándar a menos que cuente con el permiso de su supervisor. No se prevé que los grandes bancos diversificados en los principales mercados vayan a utilizar el ASA.

En el modelo ASA, el requerimiento de capital/metodología para el riesgo operativo es igual que en el método estándar, salvo en dos líneas de negocio: banca minorista (al detalle) y banca comercial. En el caso de estas líneas de negocio, los préstamos y los anticipos, multiplicados por un factor fijo 'm', sustituyen a los ingresos brutos como indicador de riesgo. Los factores beta de la banca minorista y de la banca comercial son los mismos que en el método estándar. El requerimiento de capital en el modelo ASA por riesgo operativo en el caso de la banca minorista (la misma fórmula básica es aplicable a la banca comercial) puede expresarse como:

Donde:

KRB es el requerimiento de capital de la línea de negocio de banca minorista

es el factor beta de la línea de negocio de banca minorista

LARB es el importe total pendiente de los préstamos y anticipos (no ponderados por riesgo y brutos de provisiones), promediado durante los tres últimos años.

MODELOS DE MEDICIÓN AVANZADA

ESTÁNDARES REQUERIDOS PARA LOS MODELOS DE MEDICIÓN AVANZADA (Advanced Measurement Approach-AMA)

Como se planteó anteriormente, para poder utilizar métodos de medición avanzada, es necesario satisfacer unos criterios generales y otros cualitativos y cuantitativos, que presentamos a continuación, tomándolos directamente del documento de Basilea.

CRITERIOS GENERALES

Para poder utilizar los modelos AMA, el banco deberá demostrar a su supervisor que, como mínimo:

• Su consejo de administración y su alta dirección, según corresponda, participan activamente en la vigilancia del marco de gestión del riesgo operativo.

• Posee un sistema de gestión del riesgo operativo conceptualmente sólido que aplica en su totalidad.

• Cuenta con recursos suficientes para utilizar la metodología en las principales líneas de negocio, así como en los ámbitos de control y auditoría.

El modelo AMA utilizado por un banco estará sometido a un período de seguimiento inicial por parte del supervisor antes de que pueda utilizarse a efectos de capital regulador. Este periodo permitirá al supervisor determinar si el método es creíble y adecuado. Conforme se analiza más adelante, el sistema de medición interna de un banco deberá estimar de forma razonable las pérdidas esperadas, combinando datos relevantes de pérdidas tanto internos como externos, análisis de escenarios, así como el entorno del negocio y los factores de control interno que son específicos al banco. El sistema de medición del banco también deberá poder llevar a cabo la asignación de capital económico por riesgo operativo entre las distintas líneas de negocio de un modo que genere incentivos para la mejora de la gestión del riesgo operativo en esas líneas.

CRITERIOS CUALITATIVOS

Los bancos deberán satisfacer los siguientes criterios cualitativos antes de poder ser autorizados a emplear un modelo AMA a efectos de capital por riesgo operativo:

• El banco deberá contar con una unidad de gestión del riesgo operativo que se encargue del diseño y aplicación del marco de gestión del riesgo operativo de la entidad. Esta unidad será la encargada de compilar las políticas y procedimientos de la entidad en su conjunto relativos a la gestión y control del riesgo operativo; de diseñar y aplicar la metodología de medición del riesgo operativo en la institución; de diseñar y aplicar un sistema de información sobre el riesgo operativo; y de desarrollar estrategias encaminadas a identificar, estimar, observar y controlar / reducir el riesgo operativo.

• El sistema de medición interna del riesgo operativo con que cuente la entidad deberá estar perfectamente integrado dentro de los procesos habituales de gestión del riesgo del banco.

Los resultados que arroje dicho sistema deberán utilizarse activamente en el proceso de seguimiento y control del perfil de riesgo operativo del banco. Por ejemplo, esta información debe ser parte importante de la presentación de informes sobre el riesgo y su gestión, así como de la distribución interna del capital y del análisis del riesgo. El banco deberá contar con técnicas que distribuyan el capital por riesgo operativo entre las principales líneas de negocio y que generen incentivos para mejorar la gestión del riesgo operativo en toda la entidad.

• Deberá informarse periódicamente a la dirección de las unidades de negocio, a la alta dirección y al consejo de administración acerca de las exposiciones al riesgo operativo y del historial de pérdidas debidas a este riesgo. El banco deberá contar con procedimientos que permitan adoptar las acciones necesarias a tenor de la información contenida en estos informes de gestión.

• El sistema de gestión del riesgo operativo del banco deberá estar bien documentado. El banco deberá contar con un mecanismo que permita garantizar regularmente el cumplimiento de un conjunto documentado de políticas, controles y procedimientos internos relativos al sistema de gestión del riesgo operativo, que deberá incluir políticas para el tratamiento de los aspectos que se incumplen.

• Los auditores externos y/o internos deberán llevar a cabo exámenes periódicos de los procesos de gestión y sistemas de medición del riesgo operativo. Estos exámenes deberán incluir tanto las operaciones de las unidades de negocio como las actividades de la unidad independiente de gestión del riesgo operativo.

• La validación del sistema de medición del riesgo operativo que lleven a cabo los auditores externos y/o las autoridades supervisoras deberá incluir los siguientes aspectos: (1) Comprobación del buen funcionamiento de los procesos de validación interna; y (2) Comprobación de la transparencia y accesibilidad del flujo de datos asociados al sistema de medición del riesgo, y de su procesamiento. En particular, es preciso que los auditores y las autoridades supervisoras puedan acceder fácilmente a las especificaciones y a los parámetros del sistema, siempre que lo estimen necesario y en el marco de los procedimientos oportunos.

CRITERIOS CUANTITATIVOS

CRITERIO DE SOLIDEZ DE LOS MODELOS AMA

Dada la continua evolución de los métodos analíticos de tratamiento del riesgo operativo, el Comité de Basilea no desea especificar qué método o qué supuestos sobre distribuciones de probabilidad se deben utilizar para estimar el riesgo operativo a efectos de capital regulador. Sin embargo, el banco deberá ser capaz de demostrar que su método identifica eventos situados en las 'colas' de la distribución de probabilidad, generadores de pérdidas graves. Con independencia del método utilizado, el banco deberá demostrar que su estimación del riesgo operativo satisface un criterio de solidez comparable al exigido en el método de tratamiento del riesgo de crédito basado en calificaciones internas (es decir, comparable a un periodo de mantenimiento de un año y con un intervalo de confianza del 99,9 por ciento).

El Comité de Basilea reconoce que el criterio de solidez de los modelos AMA ofrece a los bancos una flexibilidad sustancial para desarrollar su sistema de estimación y gestión del riesgo operativo. Sin embargo, al desarrollar esos sistemas, los bancos deberán implantar y mantener procedimientos rigurosos en la elaboración de modelos para el riesgo operativo y la validación independiente de tales modelos.

Antes de la fecha de entrada en vigor, el Comité reexaminará la evolución de las prácticas en el sector con respecto al uso de estimaciones sobre pérdidas operativas potenciales de forma creíble y consistente. Asimismo, reexaminará los datos acumulados y el nivel de los requerimientos de capital estimados mediante los modelos AMA y podrá refinar sus propuestas si así lo estima oportuno.

CRITERIOS DETALLADOS

En esta sección se describe una serie de criterios cuantitativos de aplicación a las medidas de riesgo operativos generadas internamente, a efectos del cálculo de los requerimientos mínimos de capital regulador.

• Todo sistema interno para el cálculo del riesgo operativo deberá ser acorde con la definición del riesgo operativo establecida por el Comité de Basilea, y con los tipos de eventos de pérdida definidos por el mismo.

• Los supervisores exigirán al banco que calcule su requerimiento de capital regulador como la suma de la pérdida esperada (Expected Loss - EL) y de la pérdida inesperada (Unexpected Loss-UL), a menos que el banco pueda demostrar que ya contempla adecuadamente la EL en sus prácticas internas de negocio. Es decir, al objeto de que el requerimiento mínimo de capital regulador dependa exclusivamente de UL, el banco deberá poder demostrar a su supervisor nacional que ya ha calculado su exposición a EL y la ha tenido en cuenta.

• El sistema de medición del riesgo del banco deberá estar suficientemente desglosado para identificar los principales factores de riesgo operativo que influyen en la forma de las colas de la distribución de las estimaciones de pérdida.

• Deberán añadirse las distintas estimaciones de riesgo operativo a efectos de calcular la exigencia de capital mínimo regulador. Sin embargo, el banco podrá estar autorizado a utilizar estimaciones internas sobre las correlaciones de pérdidas por riesgo operativo que existen entre las distintas estimaciones del riesgo operativo, siempre que pueda demostrar al supervisor nacional que sus sistemas para determinar las correlaciones resultan adecuados, se aplican en su totalidad y tienen en cuenta la incertidumbre que rodea a dichas estimaciones de correlación (especialmente en periodos de tensión). El banco deberá validar sus supuestos de correlación utilizando técnicas cuantitativas y cualitativas más adecuadas.

• Todo sistema de cálculo del riesgo deberá poseer ciertos elementos básicos que satisfagan el criterio de adecuación supervisora enunciado en este apartado. Estos elementos deberán incluir la utilización de datos internos, datos externos relevantes, análisis de escenarios y factores que reflejen el entorno del negocio y los sistemas de control interno.

• El banco deberá contar con un proceso creíble, transparente, bien documentado y comprobable para ponderar estos elementos fundamentales dentro de su sistema general de medición del riesgo operativo. Por ejemplo, en algunos casos, las estimaciones del intervalo de confianza del 99,9 por ciento basadas principalmente en datos internos y externos sobre eventos de pérdida no serán fiables para líneas de negocio con una distribución de pérdida con colas muy pronunciadas y con un reducido número de pérdidas observadas. En tales casos, la utilización de análisis de escenarios y factores que reflejen el entorno del negocio y el control de la actividad puede ser más relevante a la hora de calcular el riesgo. Por el contrario, los datos sobre eventos de pérdidas operativas pueden ser más pertinentes para el sistema de medición del riesgo en aquellas líneas de negocio en las que se consideren fiables las estimaciones del intervalo de confianza del 99,9 por ciento basadas principalmente en estos datos. En cualquier caso, el método que utilice el banco para ponderar estos cuatro elementos fundamentales deberá guardar coherencia interna y evitar la doble contabilización de las evaluaciones cuantitativas o las coberturas del riesgo que ya sean reconocidas en otros elementos del marco.

MODELOS GENERALES DE MEDICIÓN AVANZADA

Aunque diversos modelos han sido usados para cuantificar el riesgo operacional, aún no ha surgido el que se pueda considerar 'el mejor'.

La investigación en riesgo operacional ha llevado a muchas entidades a usar modelos 'prestados' de las técnicas generales de estimación en seguros (los llamados ' Métodos actuariales' o también referidos como 'Métodos estadísticos'). Todos los métodos estadísticos se basan en bases de datos de eventos de pérdidas para estimar el riesgo operacional. La principal dificultad con estos métodos es la escasez de datos de buena calidad que reflejen las operaciones reales de la compañía, teniendo en cuenta que, según el acuerdo, las estimaciones de riesgo operativo generadas internamente y utilizadas para efectos de capital regulatorio deberán basarse en un período de observación de por lo menos cinco años, excepto cuando el banco utilice por primera vez el modelo AMA, caso en el cual se aceptará un período de observación de tres años.

La mayoría de esos modelos actuariales estiman una función de probabilidad para el riesgo operacional y, a partir de ella, deducen una medida de capital. Estos métodos varían en complejidad como se ilustra enseguida:

• Una curva es ajustada para agregar las pérdidas experimentadas y esa curva es usada para estimar percentiles extremos.

• La frecuencia y severidad de los eventos de pérdidas son ajustadas a distribuciones de probabilidad separadas, que luego son modeladas estocásticamente para producir una función de probabilidad combinada que se usa para deducir medidas de capital. Este es un procedimiento estándar aplicado en el campo actuarial.

• Usando Teoría de Valores Extremos (TVE), una curva separada se ajusta a eventos de pérdida de baja frecuencia y alta severidad, y luego se combina con las distribuciones separadas de otros eventos. Es bien conocido que las técnicas de TVE producen estimativos con sesgos positivos en muestras pequeñas. Huisman, Koedijk, Kool y la Palm (2001) han propuesto una técnica de TVE basada en regresión que corrige el sesgo de muestra pequeña en el parámetro de cola estimado.

• Con análisis de regresión, se ajusta una ecuación de regresión a los inductores más probables de riesgo operacional.

En general, estos métodos de cuantificación, que son ampliamente aplicados por la industria actuarial, utilizan las distribuciones de pérdida deducidas históricamente. Las distribuciones de pérdida son derivadas combinando la distribución de frecuencia de pérdida, que describe la frecuencia de las pérdidas sobre un intervalo de tiempo dado, con la distribución de la severidad de la pérdida. La distribución de la pérdida se puede entonces utilizar para cuantificar la pérdida operacional esperada a un cuantil conveniente o requerido, que puede ser utilizado para estimar un VaR (Value at Risk) operacional. Las técnicas como la simulación de Monte Carlo se pueden utilizar para llenar los vacíos que pueden ocurrir en la distribución de la pérdida debido a la carencia de datos. Además, los avances en Teoría de Valores Extremos ayudan a desarrollar valoraciones más exactas de las distribuciones de la cola.

Según estudios recientes (Rachev et al. 2005), hay cuatro componentes cruciales de un modelo actuarial confiable para la pérdida operacional: (1) Proceso no-homogéneo de Poisson para el proceso de ocurrencia de la pérdida, (2) Distribuciones flexibles de la severidad de la pérdida, (3) que tenga en cuenta datos incompletos, y (4) análisis de la robustez del modelo.

Aunque los métodos estadísticos son los más dependientes de la calidad de los datos, son los que probablemente producen mejores resultados si se dispone de datos suficientemente confiables. Una segunda familia de métodos, que se estructuran tendiendo en cuenta esa debilidad, se enfoca sobre la comprensión de los procesos operacionales subyacentes. Estos son los llamados métodos causales, e incluyen redes Bayesianas, Lógica difusa y Sistemas dinámicos.

Las redes Bayesianas son uno de los métodos causales más comunes usados para cuantificar riesgo operacional. En este método, los flujogramas de los procesos son mapeados en un árbol de probabilidades en el cual cada nodo representa un evento o un indicador de pérdida y tiene una probabilidad asociada. El proceso de mapeo crea una serie de sistemas dinámicos o mapas causales que intenta explicar cómo ocurren los eventos de riesgo operacional en la entidad. Después de que todos los nodos iniciales del árbol tienen asignada una probabilidad, las probabilidades de todos los nodos subsecuentes pueden ser calculadas y la red Bayesiana quedará completa. Simulaciones de Monte Carlo se pueden correr sobre la red iniciando con las variables iniciales hasta llegar a las requeridas distribuciones de pérdida. Esto constituye un proceso de aprendizaje en el cual a medida que nuevos datos reales son obtenidos, éstos pueden retroalimentar el modelo, y producir mejores estimativos a través del tiempo. Ese análisis puede permitir la alta granularidad de algunos eventos e indicadores de riesgo, que sean específicos a un proceso.

Los diagramas de influencia son una extensión de las redes Bayesianas, que incluyen funciones de utilidad (para cuantificar el costo o beneficio), y funciones de decisión (que permiten la modelación de alternativas de acción).

Otro método de medición del riesgo con mapas causales es la lógica difusa. Ésta proporciona una relación escalada entre cada par de nodos, en lugar de manejar una relación binaria. La lógica difusa puede ser utilizada para combinar opiniones expertas con datos reales para obtener un mejor estimativo de riesgo.

Una tercera familia de métodos se concentra sobre opiniones de expertos y cubre los Métodos Delphi, análisis de escenarios y pruebas de estré. Estos métodos tienen la ventaja de no confiarse ciegamente en datos detallados.

Con respecto al análisis de escenarios, el Acuerdo plantea que: 'El banco deberá utilizar análisis de escenarios basados en opiniones periciales junto con datos externos, al objeto de evaluar su exposición a eventos generadores de pérdidas muy graves'.

Este método se sirve del conocimiento de directivos experimentados y de expertos en gestión de riesgos para obtener evaluaciones razonadas de las pérdidas graves que plausiblemente podría sufrir la entidad. Por ejemplo, las evaluaciones de estos expertos podrían expresarse en forma de parámetros de una distribución estadística supuesta de las pérdidas. Además, el análisis de escenarios deberá utilizarse para valorar el efecto de las desviaciones que se produzcan con respecto a los supuestos de correlación incorporados en el marco de medición del riesgo operativo del banco, a fin de evaluar, en concreto, las pérdidas procedentes de múltiples eventos simultáneos de pérdida por riesgo operativo. Para garantizar su carácter razonable, estos resultados tendrán que validarse y reevaluarse a lo largo del tiempo mediante su comparación con el historial de pérdidas efectivas.

Las pruebas de estrés difieren del análisis de escenarios en que ellas generalmente consideran el impacto de cambiar únicamente un factor de riesgo a la vez.

ALGUNOS ESTUDIOS ESPECÍFICOS

BANCO DE ITALIA: En julio de 2004, Marco Moscadelli, del Banco de Italia, publica una investigación titulada: The Modelling of Operational Risk: Experience with the Analysis of the Data Collected by the Basel Committee.

En esa investigación se plantea que, en la práctica, la principal dificultad para la cuantificación del riesgo operacional surge por el período de tiempo relativamente corto sobre el cual las entidades tienen registros sobre eventos de pérdidas, y específicamente por la escasez de información relativa a pérdidas severas pero infrecuentes, que, además, son las de mayor contribución a la carga de capital. La necesidad de evaluar la exposición a eventos de cola potencialmente severos es una de las razones por las cuales el nuevo acuerdo requiere que los bancos complementen sus datos internos con fuentes adicionales (datos externos, análisis de escenarios) para la cuantificación del riesgo operacional.

En el año 2002 Basilea recopiló información relativa a 89 bancos, y los datos fueron mapeados en la matriz estándar BL/ET (Business Line/Event Type).

Moscadelli utiliza esa información para ilustrar las metodologías y los resultados del análisis inferencial sobre pérdidas por riesgo operacional. En la exploración de los datos, inicialmente se agrupan las pérdidas de los bancos por líneas de negocio, y se analizan mediante herramientas empíricas y estadísticas.

El primer propósito es comparar la sensibilidad de las distribuciones actuariales convencionales y modelos provenientes de la Teoría de Valores Extremos (TVE) al representar los percentiles extremos de los datos (más grandes pérdidas). Luego se obtienen medidas de severidad y frecuencia en cada conjunto de datos y se calcula la carga de capital por riesgo operacional. Finalmente, para cada línea de negocio, y para las ocho líneas de negocio como un todo, se evalúan las contribuciones de las pérdidas esperadas a la carga de capital, y las relaciones entre las cargas de capital y los correspondientes niveles promediosde ingresos brutos, y se comparan con los coeficientes regulartorios actuales.

Los resultados indican un bajo desempeño de los modelos convencionales actuariales de severidad para describir características globales de los datos, presentando muy altos niveles de sesgo positivo y kurtosis. De hecho, cualquier distribución tradicional aplicada a todos los datos en cada línea de negocio tiende a ajustarse a observaciones centrales, sin considerar adecuadamente las grandes pérdidas.

Por otro lado, se demuestra que el Modelo de Valores Extremos en su representación de severidad (Picos sobre umbral y distribución generalizada de pareto – Peaks over Threshold- Generalizad Pareto Distribution POT-GPD), proporciona un estimativo más exacto de las colas reales de las líneas de negocio en percentiles del 95% o superiores, lo cual es verificado con tres pruebas de bondad de ajuste y un análisis de desempeño sobre la severidad del VaR.

Debido a la supremacía para estimar la distribución de la severidad de las pérdidas en las colas, el Modelo de Valores Extremos, en este caso, en su representación de Picos Sobre Umbral-Proceso de Puntos (Peaks over Threshold –Points Process- POT-PP) es también utilizado parta estimar la distribución de frecuencias de pérdidas en la cola, es decir, para estimar la probabilidad de ocurrencia de grandes pérdidas en cada línea de negocio. Los resultados muestran una variabilidad significativa por banco del número de ocurrencias de grandes pérdidas en cada línea de negocio. Esto puede ser explicado por el diferente nivel de comprensión en la colección de datos de pérdida entre los bancos participantes en la encuesta y por el corto horizonte de tiempo considerado (datos de un año).

En general, en el estudio citado, se considera lo siguiente:

• Descripción de las principales características de los datos usados en el trabajo. Se exploran los datos de cada línea de negocio, mediante un análisis empírico basado en un procedimiento bootstrapping y una representación gráfica de la función de densidad de las líneas de negocio.

• Principales resultados de la inferencia convencional sobre la severidad de las pérdidas.

• Descripción del bagaje teórico de la Teoría de Valores Extremos.

• Estimación, pruebas y mediciones de la severidad de las colas en las ocho líneas de negocio, mediante el modelo citado POTGPD.

• Cálculo de las probabilidades de ocurrencia de las colas de las líneas de negocio mediante la componente de frecuencia del enfoque POT (POT-PP).

• Cálculo de la carga de capital de las líneas de negocio contra las pérdidas esperadas más las no esperadas, y comparación con la contribución referente sólo a las pérdidas esperadas.

• Relación entre cargas de capital por líneas de negocio y los ingresos brutos.

MÉTODOS ROBUSTOS

Chernobai y Rachev (2006), de la Universidad de California, publican un estudio sobre la aplicación de métodos robustos para la modelación del riesgo operacional. Inicialmente plantean que el modelo cuantitativo requerido debe tener la capacidad de adaptarse a peculiaridades específicas de la distribución de pérdidas: alta curtosis, sesgo positivo severo y excesiva 'pesadez' de la cola. Además, que algunos críticos del marco de Basilea II argumentan que los estándares requeridos para el cálculo de capital regulatorio son tan exigentes que podrían exceder el capital económico, disminuyendo la disponibilidad de fondos, y que esto podría ocurrir por error de especificación del modelo. Como la noción de ' robustez' tiene varias interpretaciones, aclaran que un modelo estadístico resistente a outliers o distribucionalmente robusto pretende construir procedimientos estadísticos que sean estables, aunque el modelo subyacente no sea perfectamente satisfecho por los datos, y que se enfocan sobre las propiedades estadísticas del conjunto de datos sin ser distraídos por la presencia de outliers,que podrían oscurecer y debilitar la potencia explicatoria y predictiva con relación a la porción genérica de los datos. La ejecución de los datos mediante un análisis robusto o mediante uno clásico implica una compensación entre seguridad y eficacia: aplicando una metodología robusta, aunque una cierta información puede ser perdida mientras que desecha o disminuye la contribución de los acontecimientos periféricos, se pueden mejorar significativamente los pronósticos y producir estimaciones más confiables. En este contexto, los autores discuten y ejemplifican los modelos que proponen para la cuantificación 'robusta' del riesgo operacional, que proponen como punto de inicio para investigaciones adicionales en este sentido.

ESCALAMIENTO DE DATOS

Miranda, et al. (2005), de la Universidad Erasmus de Rótterdam, publicaron un estudio sobre escalamiento de datos para la modelación del riesgo operacional. Para resolver el problema de escasez de datos, proponen un mecanismo de escalamiento que permita a la organización agregar los datos originados por varias unidades de negocio, cada una con sus características específicas, tales como tamaño y grado de exposición al riesgo operacional. El mismo mecanismo de escalamiento puede utilizarse para incorporar datos externos provenientes de otras instituciones, con sus propias exposiciones al riesgo. Demuestran que hay una fuerte relación entre las pérdidas incurridas en una unidad de negocio o institución, y un indicador específico de tamaño, en este caso, los ingresos brutos. Se estudia una ley de potencia del escalamiento como mecanismo para explicar esa relación. Además, muestran que después de tener adecuadamente escalados los datos de diferentes unidades de negocio, el conjunto de datos agregados resultante puede ser utilizado para calcular el VaR-Operacional(operacional Value at Risk).

MODELO DE NGUYEN Y OTTMAN

Nguyen y Ottmann (2006), de dos entidades financieras alemanas, sugieren un modelo LDA (Loss Distribution Approach), mediante el cual se usan datos internos y datos externos para modelar la distribución de pérdidas mediante técnicas de ajuste de cuervas multi-estado y Teoría de Valores Extremos, y sugieren métodos para implementar en el modelo los elementos cualitativos clave, tales como análisis de escenarios, factores de control interno y entorno del negocio. Todos los elementos básicos de los requerimientos regulatorios de Basilea II son incorporados al modelo de medición.

ESTUDIOS RELEVANTES EN COLOMBIA

Entre los avances académicos desarrollados en Colombia sobre riesgo operacional, consideramos relevantes tres estudios realizados recientemente, por investigadores de la Universidad de los Andes.

Uno de ellos es Impacto de las metodologías propuestas por el Comité de Basilea para el cálculo de requerimientos de capital por riesgo operativo en el sector bancario colombiano, desarrollado por Ricardo (2004). En este trabajo se aplican las metodologías básicas sugeridas por Basilea II (Enfoque Básico y Enfoque Estándar), a 28 bancos colombianos, y se concluye que, si se adoptaran esos métodos básicos de cuantificación del riesgo operativo al sector bancario colombiano, la relación de solvencia sufriría una reducción y muchos de ellos no superarían el 9% actualmente exigido. Por lo tanto, se requiere que adopten medidas para evitar que la inclusión del riesgo operacional, que será obligatoria en los próximos años, afecte negativamente su relación de solvencia.

Otro estudio es el titulado Diseño de una metodología para la identificación y la medición del riesgo operativo en instituciones financieras, de Mendoza y Castillo (2004), de cuya introducción tomamos literalmente lo siguiente: 'Teniendo en cuenta la escasez de información histórica sobre los eventos de pérdida debidas al riesgo operativo que se presenta en la mayoría de las entidades financieras colombianas, este trabajo desarrolla una metodología que permite, no sólo identificar las principales fuentes de riesgo operativo, sino también cuantificar la exposición al mismo y calcular las provisiones que debe realizar la entidad para cubrir cualquier evento de pérdida que se pueda presentar.

' La metodología consta de nueve pasos en los cuales se definen categorías para los posibles eventos de pérdida y se identifican indicadores de riesgo y las relaciones entre ellos para construir una Red Bayesiana que estima la distribución de probabilidad para cada una de las categorías de eventos de pérdida. Finalmente, utilizando simulación de Montecarlo se obtiene la distribución de las pérdidas totales para la línea de negocio seleccionada en el banco durante el horizonte de tiempo definido para el análisis y se calcula la provisión que debe hacer la entidad financiera para cubrir los posibles eventos de pérdida debidos al riesgo operativo'.

Un estudio más reciente es el de Montenegro (2005) que presenta un diseño de un modelo de sistema de administración del riesgo operacional para la línea de negocio compra-venta de divisas de la tesorería de un banco; diseño que podría ser utilizado como base para implementar el sistema general para la totalidad de las líneas de negocio de una entidad financiera. Esa propuesta para administración del riesgo operacional en una línea de negocio específica está soportada en tres metodologías básicas: Metodología de King, Metodología KPMG y la Metodología de Fithratings Financial Institutions. Según King (2001), la administración del resigo operacional está fundamentada en tres aspectos básicos: implementación de lineamientos de gobierno corporativo, definición de controles operacionales y medición del riesgo operacional. Por otro lado, la firma de consultoría y auditoría KPMG, como resultado de su vasta experiencia con múltiples entidades financieras, desarrolló un esquema detallado para la administración del riesgo operacional que incluye los siguientes componentes: estrategia de riesgo, estructura organizacional, reportes, lenguaje común con respecto a pérdidas, causas y efectos; datos de pérdidas, valoración del riesgo, indicadores clave de riesgo, estrategias de mitigación, modelación del capital requerido e información tecnológica. Finalmente, la calificadora Fithratings, a partir de la experiencia obtenida al investigar los sistemas de administración del riesgo operacional implementados por más de 42 grandes bancos activos internacionalmente, propone una metodología que incluye lo siguiente: definiciones básicas, identificación, estructura y cultura organizacional, recolección de datos, medición y administración.

CONCLUSIONES

• La gestión integral del riesgo financiero, y en particular del riesgo operacional, se ha convertido en los últimos años en un gran reto para los operadores e investigadores en finanzas, ante los conocidos grandes desastres financieros de muchas entidades, mucha parte de ellos atribuidos causas operacionales.

• La Superintendencia Financiera de Colombia, como ente regulador en el ámbito nacional, en los últimos años ha concentrado sus esfuerzos en la implementación de los sistemas de administración de riesgo de crédito y riesgo de mercado; pero empieza a incursionar en la normativa relativa a riesgo operacional, como ya lo ha hecho en algunos aspectos de riesgo operacional en las entidades aseguradoras.

• No sólo la emergente regulación internacional, y la inminente normativa nacional, sino también, y fundamentalmente, el propósito de mejorar continuamente los procesos de toma de decisiones en las instituciones, han motivado en los últimos años el interés por la investigación en el campo del riesgo financiero y, específicamente, en identificación, valoración y gestión del riesgo operacional.

• Uno de los problemas cruciales para la cuantificación del riesgo operacional ha sido, indudablemente, la escasez de datos confiables. Pero ante la convicción creciente de la necesidad de cuantificar ese riesgo, las entidades han iniciado serios procesos de recolección de datos, y se considera que con el transcurrir del tiempo será un problema superado, y los modelos de medición avanzada tomarán plena vigencia y aplicación.

• Entretanto, sigue siendo un gran reto la formulación de un modelo con una complejidad manejable y con las características de completez, exactitud, y satisfacción de los estándares generales, cualitativos y cuantitativos planteados por el Nuevo Acuerdo de Basilea. Eso puede explicar el porqué, incluso hasta el año 2005, grandes entidades financieras en el ámbito internacional, estaban manejando el Método Estándar de Basilea II, para cuantificar su riesgo operacional.

BIBLIOGRAFÍA

1. CHAVEZ-DEMOULIN, V. & EMBRECHTS, P. 2004. Advanced extremal models for operational risk. Technical report, ETH Zurich. [ Links ]

2. CHERNOBAI, A. & RACHEVT, S. 2006. Applying robust methods to operational risk modeling. En: The Journal of Operational Risk. Vol.1. Number 1. [ Links ]

3. COMITÉ DE SUPERVISIÓN BANCARIA DE BASILEA. 2004. Convergencia internacional de medidas y normas de capital. [ Links ]

4. DE FONTNOUVELLE, P., ROSENGREN, E. & JORDAN, J. 2005. Implications of alternative operational risk modelling techniques. Technical report, Federal Reserve Bank of Boston and FitchRisk. [ Links ]

5. FITHRATINGS FINANCIAL INSTITUTIONS. 2004. Special Report. 'The oldest tale but the newest story: operational risk and the evolution of its measurement under Basel II'. [ Links ]

6. HUISMAN, R., KOEDIJK, K., KOOL, C. & PALM, F. 2001. Fat tails in small samples. Journal of Business and Economic Statistics. [ Links ]

7. KING, J. L. 2001. Operational Risk. Editorial John Wiley & Sons Ltda. [ Links ]

8. KPMG. FINANCIAL SERVICES. 2005. 'Basel II- A closer look: managing operational risk'. [ Links ]

9. MENDOZA, A. & CASTILLO, M. 2004. Diseño de una metodología para la identificación y la medición del riesgo operativo en instituciones financieras. Tesis para optar al título de Ingeniería Industrial de la Universidad de los Andes. [ Links ]

10. MENN, C., RACHEV, S. & TRUCK, S. 2005. Estimation of operational value-at-risk in the presence of minimum collection thresholds. Universidad de California. [ Links ]

11. MIRANDA, L.; BERG, J. & LEIPOLDT, M. 2005. Data scaling for operational risk modelling. Erasmus Research Institute of Management (ERIM). Erasmus Universiteit Rotterdam. [ Links ]

12. MONTENEGRO, L. 2005. Modelo de implementación de un sistema de administración de riesgo operacional para una línea de negocio de un banco. [ Links ]

13. MOSCADELLI, M. 2004. The modelling of operational risk: experience with the analysis of the data collected by the Basel Committee. Technical report, Banca d' Italia. [ Links ]

14. NGUYEN, M. & OTTMANN, M. 2006 The fat tail. En: Journal Oprisk & Compliance. Vol. 7. Number 3. [ Links ]

15. Rachev , S., Men, C. & Fabozzi , F. 2005. FatTailed and skewed asset return distributions. Wiley: New Jersey. [ Links ]

16. RICARDO, M. C. 2004. Impacto de las metodologías propuestas por el Comité de Basilea para el cálculo de requerimientos de capital por riesgo operativo en el sector bancario colombiano. Tesis para optar al título de Ingeniera Industrial de la Universidad de los Andes. [ Links ]

Recibido: 04/07/2006

Aceptado: 28/08/2006