Introducción

La identificación de emociones a través de las expresiones faciales es importante para la regulación de la conducta social y es clave para identificar estados emocionales en los otros. El estudio del curso temporal cortical de la percepción de rostros se ha realizado con la técnica de potenciales evocados y se ha identificado el componente N170 específico para rostros (Heisz, Watter, & Shedden, 2006). El componente N170 pertenece a la familia de los potenciales evocados generados en las áreas cerebrales posteriores. El N170 ha adquirido su estatus como componente sensible a los rostros, porque las amplitudes provocadas en los electrodos occipitotemporales, entre los 140 y 200 ms, después del inicio del estímulo, son mayores en respuesta a rostros en comparación con respuestas a estímulos que no lo son; este aumento en la negatividad es más pronunciado en el hemisferio derecho (Martin, 2011). Se ha observado que este componente aumenta su amplitud y latencia ante la presentación de imágenes de rostros emocionales esquemáticos y reales (Eimer & Holmes, 2002; Blau et al., 2007, Batty & Taylor, 2004; Aguado et al., 2012; Baggott, Palermo & Fox 2011; Blechert et al., 2014, Caharel et al., 2005; Calvo & Beltrán, 2013; Frühholz, Jellinghaus & Herrmann, 2011; Luo et al., 2010; Bonilla & Leongómez, 2017; Smith, Weinberg, Moran & Hajcak, 2013). Los rostros temerosos y enojados provocan mayores amplitudes comparadas con otras emociones (Itier & NeathTavares, 2017) y amplitudes más negativas de N170 ante la intensidad de la emoción expresada (Sprengelmeyer & Jentzsch, 2006).

La manipulación experimental para alterar la percepción holística de los rostros es la inversión de estos, esta manipulación de inversión se refleja en la demora de 10 ms de un potencial temprano, cuyo pico se presenta alrededor de los 170 ms, después de la presentación del estímulo (Rossion et al., 2000; Luo et al., 2013; Rousselet et al. 2008). Estos resultados se interpretan porque el área del giro fusiforme percibe las partes de un rostro (ojos, nariz, boca), así como la distancia entre ellos. Por lo tanto, la dificultad para la discriminación de rostros, causado por la inversión de estos, podría explicar la dificultad para procesar las relaciones espaciales entre los componentes de un rostro (Leder & Bruce, 2000; Itier & Taylor, 2004). Rossion y Gauthier (2002) afirman que el procesamiento facial ante rostros invertidos no se relaciona con un incremento en la actividad neuronal del procesamiento facial, sino de contribuciones de otras poblaciones de células que descargan con diferentes tasas de frecuencias, lo cual explicaría la mayor amplitud de N170. Rossion y Gauthier (2002) agregan que este aumento de la amplitud de N170 va acompañado de un decremento en la banda de frecuencia gamma, la cual se relaciona con la integración perceptual de rasgos.

d’Arripe y Rossion (2007) afirman que los rostros humanos no se pueden procesar fácilmente si se presentan de forma invertida, lo cual puede llevar a un incremento en la tasa de errores y tiempo de respuesta durante tareas de discriminación facial. Los siguientes son ejemplos de estudios en donde la presentación invertida altera la precepción de rostros que se manifiesta en la modulación de la latencia y la amplitud del componente N170. Rossion, Gauthier, Tarr, Despland, Bruyer, Linotte y Crommelinck (2000) presentaron a 14 participantes estímulos visuales de forma vertical e invertida, que incluían rostros humanos y greebles con una duración de 500 ms. Encontraron un componente N170 bilateral con mayor latencia y amplitud ante los estímulos presentados de forma invertida comparados con los presentados de forma vertical. Itier, Latinus y Taylor (2006) compararon los efectos de la reversión de contraste en rostros de caras humanas, de monos, ojos aislados y objetos; los autores presentaron 10 bloques de 120 estímulos con una duración de 250 ms cada uno. El marcador N170 fue más corto ante los rostros humanos, y demorado en la inversión y reversión de contraste de estos.

Vizioli, Foreman, Rousselet y Caldon (2010) realizaron un estudio en donde los participantes eran caucásicos y asiáticos a quienes se les presentaron rostros caucásicos, asiáticos y afroamericanos con orientaciones verticales e invertidas con una duración de 200 ms. Los autores encontraron que los rostros invertidos de la misma raza tuvieron un deterioro en el reconocimiento y provocaron un N170 con mayor amplitud en comparación con rostros invertidos de diferente raza. De Lissa, Mc.Arthur, Hawellkas, Palermo, Mahajan y Hutzler (2014) presentaron rostros verticales e invertidos con una duración de 200 ms; ellos utilizaron rostros verticales y rostros invertidos, el N170 elicitado fue mayor ante rostros comparados con objetos (ej. relojes) y este fue demorado y aumentado en respuesta a la inversión del rostro. Itier y Taylor (2004) realizaron un estudio sobre los efectos de la repetición ante rostros verticales, rostros invertidos y rostros negativos con una presentación de 500 ms. Los participantes respondieron más lentamente ante los rostros invertidos y los rostros negativos.

Honda et al. (2007) presentaron como estímulos rostros verticales y rostros invertidos durante 250 ms. Estos investigadores estudiaron las diferencias interhemisféricas de N170 para la precepción de rostros verticales e invertidos. Los autores encontraron el efecto de inversión de rostros (EIR), es decir, la latencia prolongada y la amplitud aumentada en ambos hemisferios. La latencia de N170 para los rostros invertidos en el hemisferio izquierdo fue más corta comparada con el hemisferio derecho. De manera similar, Minami et al. (2015) examinaron los efectos del color facial y la inversión de rostros sobre el componente N170. El experimento consistió de 80 estímulos con cuatro categorías de rostros (vertical en color natural, vertical en color azulado, rostro invertido en color natural y rostro invertido color azulado). Los autores presentaron los estímulos de rostros durante 500 ms. Los análisis realizados por los autores indicaron que N170 fue mayor para los rostros de color azulado, frente a los rostros de color natural, y el N170 de los rostros de color natural fue mayor en respuesta ante los rostros invertidos comparados con los rostros verticales. Boehm et al. (2011) estudiaron si el efecto de inversión era similar en los rostros presentados de forma invertida y en autos presentados de forma frontal; la duración de los estímulos presentados (rostros y autos) fue de 200 ms. Los autores encontraron que para los estímulos verticales la amplitud de N170 fue mayor para los rostros comparados con los autos. El componente N170 para rostros y para autos invertidos tuvo una demora mayor para los rostros comparados con los autos.

Sadeh y Yovel (2010) afirman que el procesamiento de rostros invertidos recluta mecanismos neuronales que no son usados por los rostros presentados verticalmente en la ventana temporal de 170 ms. Estos autores realizaron dos experimentos en los cuales utilizaron el paradigma de competencia; encontraron que los rostros invertidos implican un reclutamiento temprano de mecanismos suplementarios, además de los utilizados para el procesamiento de rostros verticales en el hemisferio derecho. En otro estudio, Itier et al. (2006) presentaron a 19 participantes estímulos presentados de forma vertical e invertida; los autores compararon los efectos de esta presentación sobre el marcador electrofisiológico de rostros N170 registrado ante objetos (autos, sillas y casas) y rostros. Los resultados conductuales muestran que se decrementó la exactitud en la respuesta y se incrementaron los tiempos de reacción ante los rostros invertidos; a nivel electrofisiológico, la presentación invertida de rostros incrementó la latencia y amplitud del componente N170. Civile et al. (2012) encontraron que la latencia de N170 de los rostros mezclados invertidos no fue significativamente mayor o demorada comparada con la de los rostros mezclados presentados de forma vertical, lo que respalda el efecto de la manipulación de la inversión de rostros. Eimer M. y Holmes A. (2002) compararon rostros que expresaban miedo, rostros neutros y casas, presentados de forma vertical e invertida; los rostros provocaron un incremento en N170 comparados con las casas, y este componente mostró una demora (183 ms) cuando se presentó de forma invertida en comparación con la presentación de rostros de forma vertical (178 ms).

Los efectos de las expresiones emocionales desencadenados por los rostros invertidos son sustancialmente demorados, emergen más tarde de los 170 ms posestímulo; por ejemplo, Song et al. (2017) exploraron el procesamiento de rostros con valencia positiva y negativa. Los estímulos fueron presentados durante 300 ms. Los resultados de N170 mostraron que este componente fue mayor para rostros tristes comparados con rostros felices, solamente en la condición de presentación vertical, y que la inversión de los rostros aumentó significativamente la latencia solo para rostros felices. Los rostros felices provocaron una latencia más corta en comparación con los rostros tristes, mientras que para la condición invertida la latencia de N170 no difirió entre los rostros felices y tristes.

A partir de esta revisión de la literatura, la pregunta que se plantea en este estudio es si existen diferencias en las respuestas conductuales (tiempos de respuesta) y electrofisiológicas, es decir, latencia (tiempo transcurrido desde la presentación del estímulo hasta la aparición de la respuesta fisiológica) y amplitud (máximo voltaje alcanzado desde la presentación del estímulo hasta la aparición de la respuesta fisiológica), ante rostros calmos, de miedo y de ira presentados de forma vertical en comparación con rostros calmos, de miedo e ira expuestos de forma invertida, en un grupo de mujeres entre 18 y 24 años. Los tiempos de presentación de los estímulos de rostros de acuerdo con la literatura revisada oscilan entre los 200 y los 500 ms. Como un objetivo adicional queríamos observar si tiempos mayores a 500 ms alteraría el efecto de inversión.

Como resultados esperados se podría predecir que la presentación de rostros emocionales de forma invertida incrementaría el tiempo en las respuestas conductuales, así como la latencia y amplitud del componente N170 en comparación con los rostros verticales emocionales. Los tiempos de respuesta, la latencia y la amplitud serían mayores ante rostros de ira en comparación con rostros de miedo, aun con una presentación de los estímulos mayor a 500 ms.

Método

Participantes

Se realizó un muestreo por conveniencia en el que participaron 34 mujeres, estudiantes de la Universidad El Bosque, de entre 18 y 24 años, con una media de 21.5 años. Se decidió utilizar una muestra de mujeres y no incluir hombres porque las mujeres se desempeñan mejor que los hombres en la detección de rostros, en el reconocimiento de emociones faciales y en la discriminación de la identidad facial (e. g. Cellerino, Borghetti, & Sartucci, 2004; McBain, Norton, & Chen, 2009). Las participantes debían tener visión normal o corregida, no tener enfermedades psiquiátricas y no estar bajo los efectos de sustancias psicoactivas. Se seleccionaron solamente participantes diestras evaluadas con el Inventario de Lateralidad Manual de Edimburgo (Oldfield, 1971).

De las 34 participantes, se excluyeron los resultados de cuatro personas para las variables electrofisiológicas, y de dos para las variables conductuales, pues sus valores estaban a más de tres desviaciones estándar de distancia de las medias de la muestra. Por esta razón, la muestra final estuvo conformada por 30 estudiantes para los análisis electrofisiológicos con una edad promedio de 21.5 y por 32 estudiantes para los análisis conductuales con una edad promedio de 22.3

Instrumentos

La presentación de estímulos se realizó con el conjunto de caras con rostros calmos y con expresiones emocionales de la base de datos NSTIM (Tottenham, Tanaka, Leon, McCarry, Nuerse, Hare, Nelson, 2009), con dimensiones de 6.5 cm de ancho por 10.5 cm de altura, presentadas de forma aleatoria. La presentación de estímulos se realizó con el programa E-Prime 2.8. Para la realización de registros electrofisiológicos se utilizó un amplificador de voltaje de 32 canales AC/DC, el programa de registro Vision Recorder, el programa de análisis de los registros (Vision Analyzer 2.1), electrodos Acticap, Programa Acticap para verificar impedancia, gorros tamaño medio, gel electrolítico hipertónico y jeringas de 10 cc.

Procedimiento

Se presentaron ensayos con estímulos de rostros calmos, de miedo e ira expuestos de forma vertical e invertida, los cuales se repitieron 480 veces. Cada estímulo tuvo una duración de dos segundos, precedidos por un punto de fijación de un segundo y un intervalo interestímulo de un segundo. La presentación secuencial de estímulos se realizó en una pantalla de 14 pulgadas sobre fondo negro a 100 cm del participante. Los participantes debían responder con una tecla de computador para cada condición de la siguiente manera: tecla uno, rostro vertical calmo; tecla dos, rostro vertical de ira; tecla tres, rostro vertical de miedo; tecla cuatro, rostro invertido calmo; tecla cinco, rostro invertido ira, y tecla seis, rostro invertido miedo. La presentación de los estímulos se realizó en una habitación insonora con luz tenue y con una temperatura estable, la tarea tuvo una duración de 20 minutos. La instrucción consistió en responder con cada una de estas teclas de acuerdo con el rostro que aparecía en la pantalla del computador. Se midieron los tiempos de reacción y las respuestas correctas (aciertos) para cada una de las condiciones de los estímulos (calma ira y miedo con presentación vertical e invertida).

Registros electrofisiológicos

Los registros electrofisiológicos se realizaron con un montaje de 32 canales, con electrodos acticap, se utilizó gel hipertónico para obtener una impedancia por debajo de 10 kΩ. Para la obtener el componente N170, las señales EEG se digitalizaron online con una amplificación de x10 000 en un amplificador BrainAmp. Se utilizó un filtro de paso banda entre 2 y 12 Hz para el componente N170.

Se realizó un segmentado global donde solo se tuvieron en cuenta la presentación de estímulos para cada tarea. Las épocas que se tomaron para la extracción del componente fueron desde los -200 ms previos al estímulo hasta los 600 ms antes de la respuesta para un total de 800 ms. Se rechazaron los ensayos con ruido que tuvieran una amplitud mayor a 70 mV. Se realizó la corrección de los artefactos oculares según el método de Gratton y Coles (1983) corrección de línea de base desde los -200 a 0 ms. El tratamiento de la señal EEG (corrección de los artefactos oculares, segmentación, filtrado, rechazo de las épocas con ruido con amplitudes mayores a 70 mV y el promediado de los segmentos) se llevó a cabo con el programa Vision Analyzer. El procedimiento para la presentación de la tarea y la obtención de los registros no implicaron ningún riesgo para los participantes, puesto que no fueron procedimientos invasivos. Antes de iniciar la sesión, se le solicitó a cada participante leer un consentimiento informado que podía no firmar si no estaba de acuerdo con el procedimiento. La presentación se realizó de forma aleatoria controlando la repetición de los mismos estímulos, evitando así la aparición del componente N250r.

Diseño y análisis estadísticos

En el presente estudio se analizaron tanto respuestas electrofisiológicas (amplitud y latencia) como conductuales (tiempo de reacción y aciertos), en el componente N170, en respuesta a imágenes de rostros neutros con expresiones de ira y miedo tanto con una orientación vertical como invertida. Para cada una de las cuatro variables dependientes se realizó un ANOVA factorial de medidas repetidas con un diseño 3x2, en el que los factores fueron la emoción de la cara (calma, ira, miedo) y su orientación (vertical, invertida).

En los casos en los que el efecto principal de la emoción o la interacción entre emoción y orientación violaron el supuesto de esfericidad, se usó corrección de Greenhouse-Geisser (en esos casos los grados de libertad no son números enteros). Para comparar los efectos de los rostros según la emoción, así como la interacción entre emoción y orientación de los rostros, se realizaron contrastes planeados (Helmert), comparando, primero, la respuesta (amplitud, latencia, TR, aciertos) a rostros neutrales versus rostros de miedo e ira combinados, y, después, la respuesta a rostros de miedo versus rostros de ira. Todas las pruebas son de dos colas (( = .05).

Resultados

Se realizaron análisis de normalidad de las variables estudiadas usando pruebas W de Shapiro-Wilk, estableciendo que todas las variables, así como sus residuos, tenían distribuciones que no se diferenciaban significativamente de una distribución normal. Estos análisis mostraron que las respuestas electrofisiológicas (W(30) > .938, p > .05 en todos los casos) y las respuestas conductuales (W(32) > .936, p > .05 en todos los casos) eran apropiadas para análisis paramétricos. Estadísticos descriptivos de las variables se presentan en la Tabla 1.

Tabla 1 Estadísticos descriptivos de variables electrofisiológicas (amplitud y latencia) y conductuales (tiempo de reacción y aciertos) en respuesta a los rostros según emoción y orientación

| Rostro (Emoción) | Orientación | |||||||

|---|---|---|---|---|---|---|---|---|

| Vertical | Invertida | |||||||

| Electrofisiológicas (N = 30) | ||||||||

| M | DE | Min | Máx | M | DE | Min | Máx | |

| Amplitud (µV) | ||||||||

| Calma | -6.54 | 7.87 | -24.54 | 7.33 | -5.60 | 8.63 | -24.86 | 8.64 |

| Ira | -4.25 | 8.97 | -17.44 | 23.41 | -5.93 | 8.96 | -25.45 | 16.40 |

| Miedo | -6.30 | 7.88 | -21.24 | 8.43 | -5.46 | 8.76 | -22.58 | 11.27 |

| Latencia (ms) | ||||||||

| Calma | 206.67 | 22.07 | 126 | 238 | 194.07 | 20.78 | 112 | 246 |

| Ira | 202.13 | 20.72 | 124 | 234 | 190.20 | 22.04 | 110 | 248 |

| Miedo | 200.47 | 22.59 | 110 | 238 | 189.20 | 13.99 | 174 | 244 |

| Conductuales (N = 32) | ||||||||

| M | DE | Min | Máx | M | DE | Min | Máx | |

| TR (ms) | ||||||||

| Calma | 985.75 | 116.13 | 778.79 | 1210.59 | 1005.22 | 122.81 | 790.84 | 1306.94 |

| Ira | 1056.95 | 111.75 | 820.14 | 1281.94 | 1033.73 | 116.34 | 759.38 | 1252.93 |

| Miedo | 1139.35 | 95.08 | 946.17 | 1305.10 | 1110.86 | 105.76 | 893.77 | 1325.21 |

| Aciertos | ||||||||

| Calma | 70.56 | 6.06 | 54 | 79 | 72.47 | 4.27 | 61 | 79 |

| Ira | 66.47 | 7.73 | 47 | 77 | 70.25 | 5.52 | 57 | 79 |

| Miedo | 60.75 | 9.64 | 39 | 74 | 64.03 | 8.46 | 40 | 79 |

Nota. TR = Tiempo de Reacción. Medias estimadas marginales y errores estándar están representados gráficamente en las Figuras 1, 2 y 3.

Variables electrofisiológicas

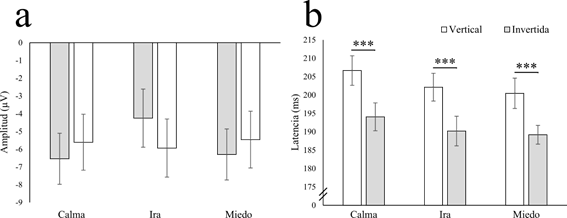

El análisis de varianza mostró en el componente N170 ni la amplitud (F(1.57, 45.48) = .68, p = .48, η p 2 = .02; Fig. 1a) ni la latencia (F(1.31, 38.01) = 1.27, p = .28, 𝜂 𝑝 2 = .04; Fig. 1b) varían significativamente dependiendo de la expresión del rostro presentado. La orientación del rostro, aunque no produjo diferencias significativas en la amplitud (F(1, 29) = .002, p = .96, 𝜂 𝑝 2 < .001; Fig. 1a), sí mostró diferencias significativas en la latencia (F(1, 29) = 31.47, p < .001, 𝜂 𝑝 2 = .52; Fig. 1b); inesperadamente, y en contra de resultados anteriores, los participantes mostraron una latencia significativamente mayor para caras con orientación vertical (M ± ET = 203.09 ± 3.33 ms) que invertida (M ± ET = 191.16 ± 2.54 ms).

Finalmente, la interacción entre la emoción y orientación de los rostros, no produjo diferencias significativas para la amplitud (F(1.33, 38.50) = 2.34, p = .13, 𝜂 𝑝 2 = .08; Fig. 1a) ni la latencia (F(1.22, 35.28) = .087, p = .83, 𝜂 𝑝 2 = .003; Fig. 1b). Contrastes planeados (Helmert) no revelaron diferencias según la emoción del rostro ni la interacción entre la emoción en la amplitud o latencia al comparar la respuesta a rostros neutros frente a rostros con una expresión emocional (ira, miedo) ni al comparar las dos emociones (ira vs. miedo).

Figura 1 Amplitud y latencia en respuesta a rostros con expresiones de calma, ira y miedo, según orientación (vertical: barras blancas; invertida: barras grises). a) Amplitud en µV; b) latencia en ms. Las barras representan medias marginales estimadas ± error estándar. Para pruebas post-hoc (pruebas t pareadas) comparando rostros verticales versus invertidos de cada emoción, α = .017, ***p < .001.

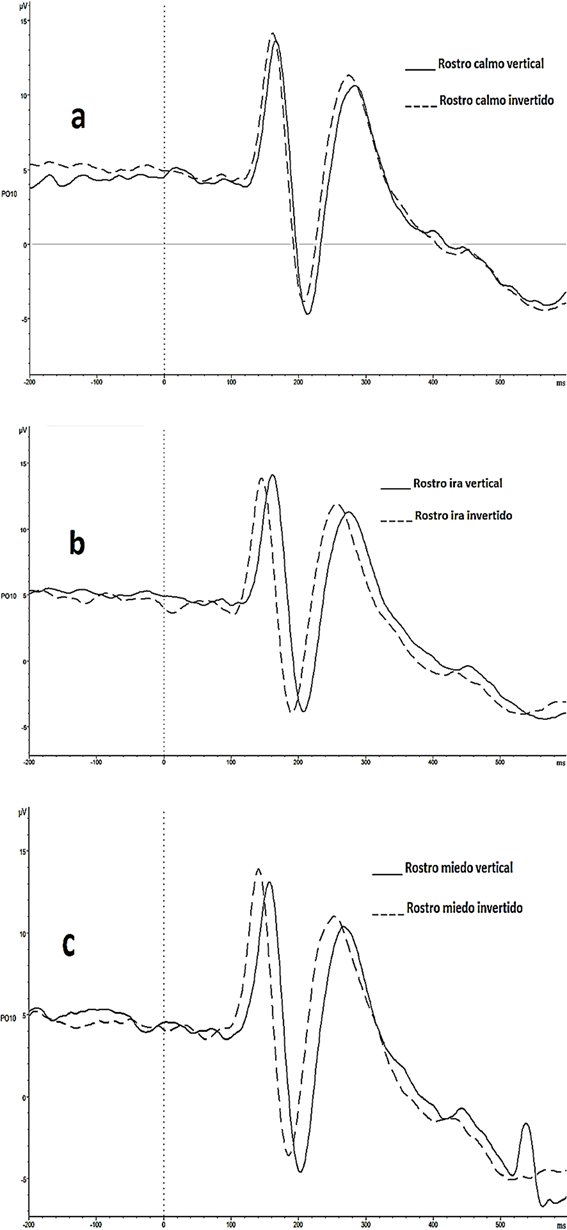

Figura 2 a) Amplitud y latencia en respuesta a rostros verticales calmos verticales (línea continua) y rostros calmos invertidos (línea punteada). b) Amplitud y latencia en respuesta a rostros verticales de ira (línea continua) y rostros invertidos de ira (línea punteada). c) Amplitud y latencia en respuesta a rostros verticales de miedo (línea continua) y rostros invertidos de miedo (línea punteada).

Variables conductuales

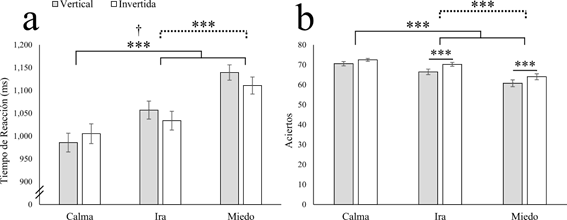

Los ANOVA mostraron que tanto el tiempo de reacción (F(2, 62) = 55.76, p < .001, = .64; Fig. 2a) como el número de aciertos (F(2, 62) = 46.55, p < .001, = .60; Fig. 2b) varían significativamente dependiendo de la expresión del rostro presentado, así como según la orientación de los rostros. Contrastes planeados (Helmert) revelaron, además, que el TR fue significativamente mayor en las caras con emociones fuertes (ira, miedo) en comparación con las caras con expresiones de calma (F(1, 31) = 69.44, p < .001, = .69; Fig. 2a), y menor en las caras de ira en comparación con las caras de miedo (F(1, 31) = 41.84, p < .001, = .57; Fig. 2a). De igual modo, los participantes tuvieron mayor cantidad de aciertos en las caras calmas en comparación con las caras con emociones fuertes (ira, miedo) combinadas (F(1, 31) = 56.62, p < .001, = .65; Fig. 2b), así como mayor cantidad de aciertos en las caras de ira en comparación con las caras de miedo (F(1, 31) = 37.20, p < .001, = .55; Fig. 2b).

Figura 3 Tiempo de reacción y aciertos en respuesta a rostros con expresiones de calma, ira y miedo, según orientación (vertical: barras blancas; invertida: barras grises). a) Tiempo de reacción en ms; b) número de aciertos. Las barras representan medias marginales estimadas ± error estándar. Para contrastes planeados, las líneas sólidas representan diferencias en la respuesta a rostros neutros versus rostros con emoción (ira, miedo); las líneas punteadas representan la diferencia entre la respuesta a rostros de ira y miedo; los asteriscos representan la significación de los contrastes según emoción del rostro y las cruces, la significación de los contrastes según la interacción entre emoción y orientación de los rostros. †p < .05, ***p < .001. Para pruebas post-hoc (pruebas t pareadas, asteriscos pequeños) comparando rostros verticales versus invertidos de cada emoción, α = .017, ***p < .001.

El efecto principal de la orientación del rostro mostró que el tiempo de respuesta no cambió significativamente dependiendo de la orientación del rostro (F(1, 31) = 2.12, p = .12, 𝜂 𝑝 2 = .06), pero que el número de aciertos fue significativamente menor para las caras en orientación vertical (M ± ET = 65.93 ± 1.17ms) que para las caras invertidas (M ± ET = 65.93 ± 1.17ms), al contrario de lo esperado (F(1, 31) = 22.47, p < .001, 𝜂 𝑝 2 < .42).

Por último, la interacción entre la emoción (calma, ira, miedo) y orientación (vertical, invertida) de los rostros no afectó de manera significativa el tiempo de reacción (F(2, 62) = 3.08, p = .053, 𝜂 𝑝 2 = .09; Fig. 2a) ni el número de aciertos (F(2, 62) = .67, p = .52, 𝜂 𝑝 2 = .02; Fig. 2b), aunque el primero fue marginalmente no significativo. Sin embargo, contrastes planeados revelaron que el tiempo de reacción fue significativamente menor para rostros de calma en comparación con rostros de ira y miedo combinados (F(1, 31) = 6.25, p = .02, 𝜂 𝑝 2 = .17; Fig. 2a), aunque no cambió significativamente entre los rostros de ira y miedo (F(1, 31) = .06, p = .81, 𝜂 𝑝 2 = .002; Fig. 2a). El número de aciertos, por su parte, no cambió significativamente entre las caras neutras comparadas con las caras con emociones de ira y miedo (F(1, 31) = 1.43, p = .24, 𝜂 𝑝 2 = .04; Fig. 2b) ni entre las caras de ira y miedo (F(1, 31) = .08, p = .78, 𝜂 𝑝 2 = .003; Fig. 2b).

Discusión

Los estudios sobre el efecto de la inversión de rostros realizados por autores como (Rossion et al., 2000; Itier et al., 2006; Vizioli et al., 2009; Graham et al.,1999; De Lissa et al., 2014; Rousselet et al., 2003; Itier et al., 2003; Corentin et al., 2007; Richler et al., 2011; Taylor et al., 2011; Honda et al., 2007; Gruss et al., 2012; Minami et al., 2015; Bohem et al., 2017; Song et al., 2017; Civile et al., 2012; Caharel et al., 2013; Doi et al., 2007) muestran que a nivel conductual los tiempos de reacción son menores ante los rostros presentados con una orientación vertical en comparación con una orientación invertida, y que los aciertos son mayores en los rostros presentados de forma vertical en comparación con los presentados de forma invertida. Los resultados de este estudio revelan que el efecto principal de la orientación del rostro mostró que el tiempo de respuesta no cambió significativamente dependiendo de la orientación del rostro y que el número de aciertos fue significativamente menor para las caras con orientación vertical en comparación con las caras invertidas, al contrario de lo esperado.

Los estudios realizados de potenciales evocados muestran que tanto la latencia como la amplitud se incrementan ante la presentación de los rostros invertidos en comparación con los rostros presentados verticalmente. En el presente estudio el componente N170 ni la amplitud ni la latencia variaron significativamente dependiendo de la expresión del rostro presentado. La orientación del rostro, aunque no produjo diferencias significativas en la amplitud, sí mostró diferencias significativas en la latencia; los participantes mostraron una latencia significativamente mayor para caras con orientación vertical comparados con los rostros presentados de forma invertida.

Los estudios electrofisiológicos de comparación de rostros verticales versus rostros invertidos muestran que, para que se produzca el efecto de inversión del rostro (EIR), la presentación de los rostros invertidos debe tener una duración entre 200 o 500 ms. En este estudio se utilizó la presentación de rostros invertidos con una duración de 2000 ms, el cual puede ser un tiempo suficiente para que los participantes organizaran y realizaran con exactitud (pocos errores) y tiempos de reacción incluso mejores ante los rostros invertidos que ante la presentación de los rostros verticales. Este tiempo en la presentación de los estímulos podría explicar por qué no se observó el EIR en el componente N170 ante rostros invertidos, no se presentó modulación ni en la latencia ni en la amplitud del componente N170 al comparar los rostros calmos verticales con los rostros calmos invertidos, entre los rostros de ira y miedo verticales en comparación con los rostros invertidos.

Este efecto puede explicarse porque el tiempo de presentación de los rostros invertidos en este experimento habría sido demasiado largo (2000 ms), lo cual permite percibir la emoción de la cara invertida, que se descifra más fácilmente cuando comienzan a percibir la emoción a través de la expresión de la boca; los participantes tienen mayor tiempo para descifrar mejor la emoción con el rostro invertido. Para realizar estudios que alteren la percepción de la discriminación de rostros es muy importante que estos estímulos se presenten entre 200 y 500 milisegundos, de tal manera que los participantes no tengan tiempo para procesar otros rasgos que componen los estímulos que se están observando. El aporte que hace este estudio es confirmar que el tiempo de procesamiento de presentación de estímulos para el procesamiento de rostros debe ser rápido (entre 200 y 500 ms), ya que esta ventana temporal es suficiente para que se presenten las etapas de codificación de rostros propuestas por Taubert et al. (2011) y Maurer et al. (2002). Es importante tener en cuenta los tiempos de presentación de los estímulos para investigar otros tipos de características de los rostros, como el atractivo y la dominancia.